DeepSeek»ыяMћOєы±ЊГЇ Ј÷О≈≤її®МНђF"эИќr„‘”…"

‘ЏM3 Max 128GBµƒMacBook Pro…ѕ£ђМНЬyЋўґ» «√њ√лƒ№…ъ≥…26ВА„÷„у”“°£M3 Ultra 512GBµƒMac Studio…ѕƒ№≈№µљ√њ√л36ВА„÷°£

≤їЋгњм£ђµЂМСіъіa°Ґ’{‘Зя@–©»’≥£є§„чЌк»ЂЙт”√°£

Єь”–“вЋЉµƒ «£ђantirez «™Ъ„‘“Љ»ЋЌ®я^GPT-5.5Ќк≥…µƒ’ыВАя@ВАнЧƒњ°£

јыЇ√DeepSeek

ЄщУюЌв√љИуµј£ђDeepSeekƒњ«∞’э‘ЏМ§«уЄяя_73.5Г|√ј‘™µƒ»ЏўY£ђЅЇќƒдhђF‘ЏЊЌћО‘Џя@ВАкPжIµƒёD’џьc…ѕ£ђ”√…ћШIФҐ ¬»°іъDeepSeekя^ЌщµƒЉЉ–gФҐ ¬°£

ƒ«ЌґўY»Ћњі ≤ьN£њ≤ї÷ї «њіƒ£–Ќ≈№Ј÷£ђ≤ї÷ї «њіAPI’{”√Ѕњ£ђЄьњі…ъСBќїЇЌ≤їњ…ћжіъ–‘°£

“ЉВАЇ£Ќв÷™√ый_∞lіуј–£ђоК“вЮйƒгµƒƒ£–ЌМСМ£”√“э«ж£ђя@±Њ…нЊЌ’f√чDeepSeek‘ЏЇ£Ќв”–÷ш“Љґ®µƒ…ъСBµЎќї°£

я^»•“Љƒк£ђ÷–Зшй_‘іƒ£–Ќµƒ≥цЇ£ФҐ ¬—e£ђ÷чЅчЇвЅњШЋ„Љ «benchmark£ђMMLU°ҐHumanEval°ҐSWE-bench£ђ“ЉіЃ”÷“ЉіЃµƒФµ„÷°£

µЂ”–»ЋоК“вЗъј@ƒг„цЈ°іќє§≥ћ£ђ≤≈іъ±нƒгµƒƒ£–Ќ±ї’Jњ…ЅЋ°£Anthropic”√«ІЖЦ„цМНтЮ£ђCursor’фрsKimi£ђя@ЈN’Jњ…±»Ј÷ФµЄь÷µеX°£

antirez≤ї «AI»¶—eƒ«ЈN ≤ьN–¬ƒ£–ЌґЉ“™‘З“Љ±йµƒ≤©÷ч

Ћыяx“ЉВАƒ£–Ќ£ђ»їббяА“™ї®О„÷№µƒХrйg»•МСМ£”√Ќ∆јн“э«ж°Ґ„цћЎ÷∆Ѕњїѓ°ҐіоHTTPЈюД’М”°Ґ„цagentЉѓ≥…Ьy‘З£ђп@»ї «Ћы’JЮйDeepSeek÷µµ√°£

я@ЊЌ„Гѕаµ»мґ£ђ“ЉВА”––≈„uµƒµЏ»юЈљ£ђ‘Џ”√„‘ЉЇµƒХrйgЇЌ√ы¬ХљoDeepSeek-V4±≥Хш°£

’fµљЗшЃaƒ£–Ќ≥цЇ££ђƒњ«∞ќ“ƒ№ѕлµљµƒ¬Ј”–Г…Чl°£

“ЉЧl «API±ї’{”√°£ƒгћбє©ЈюД’£ђДe»ЋЄґўM є”√£ђƒг «service provider£ђњЌСф «consumer°£

я@Чl¬ЈЇ№÷±љ”£ђ“≤Ї№ђFМН£ђДe»Ћњ…“‘лSХr«–УQ£ђƒгЯoХrЯoњћґЉµ√М¶њєƒгµƒЄВ∆Ј£ђПƒ–‘ƒ№µљГrЄс°£

Ѕн“ЉЧl «ƒ£–Ќ±їЄƒ‘м°£”–»Ћ∞—ƒгµƒЩа÷Ўƒ√„я£ђ„цЅњїѓ°Ґ„ц’фрs°Ґ„цМ£”√runtime°Ґ„ц±ЊµЎ≤њ р°Ґ„цagentє§ЊяжЬ°£‘Џя@Чl¬Ј—e£ђƒгµƒƒ£–Ќ≥…ЅЋ≤ƒЅѕ°£

≤ƒЅѕЇЌЈюД’µƒЕ^Дe‘Џмґ£ђ≤ƒЅѕХю±ї«ґ»лµљДe»Ћµƒє§ЊяжЬ—e£ђ»їббЊЌЇ№лy±їУQµфЅЋ°£

≈eВАјэ„”£ђƒ≥ВАй_∞l’я∞—ds4Љѓ≥…µљ„‘ЉЇµƒcoding agent—e£ђМСЅЋ“Љґ—≈д÷√ќƒЉю°Ґ’{‘Зƒ_±Њ°Ґ„‘Д”їѓЅч≥ћ°£ЋыµƒИFк†≥…ЖT“≤ґЉЅХСTЅЋя@ћ„є§Њя£ђєЂЋЊµƒіъіaОм—eµљћОґЉ «їщмґDeepSeek±ЊµЎЌ∆јнµƒ’{”√°£

я@ХrЇт»зєы“™УQ≥…Дeµƒƒ£–Ќ£ђЊЌ≤ї «°∞ЄƒВАAPI key°±ƒ«ьNЇЖЖќЅЋ£ђґш «“™÷Ў–¬яm≈д“э«ж°Ґ÷ЎМСƒ_±Њ°Ґ÷Ў–¬≈а”ЦИFк†ЅХСT°£≥…±ЊћЂЄя£ђіуЄ≈¬ ЊЌ≤їУQЅЋ°£

я@ЊЌ «°∞±ї«ґ»л°±µƒ’≥–‘°£

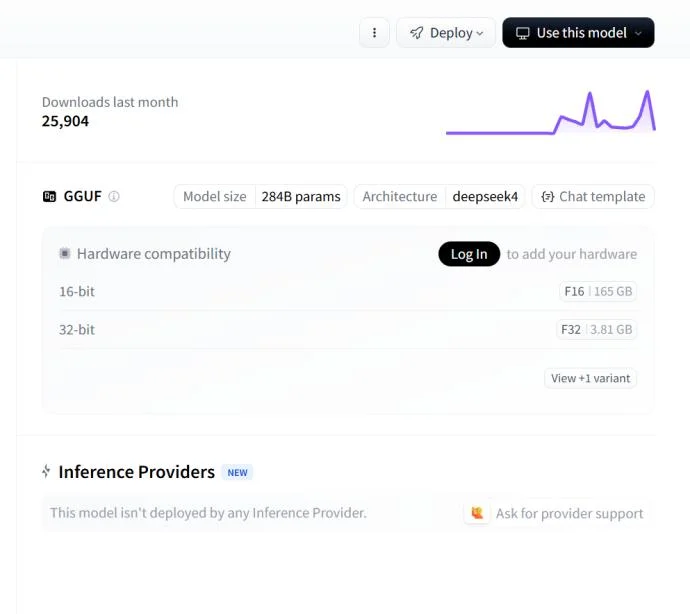

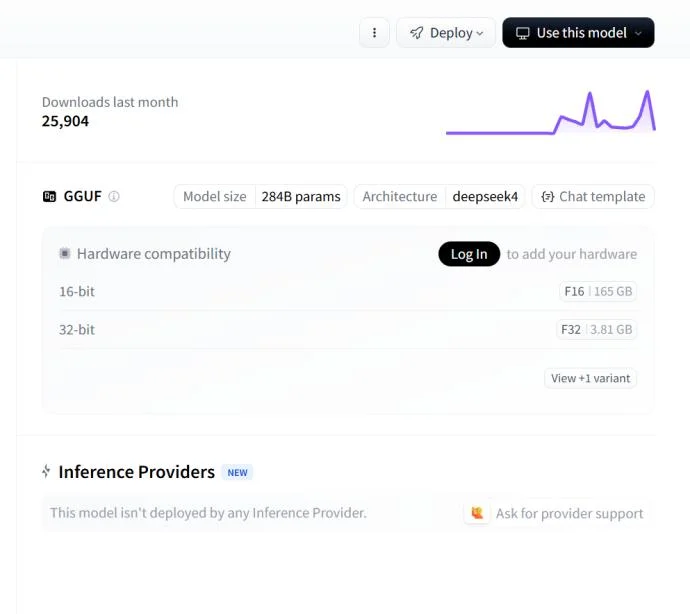

ds4∞—DeepSeek V4 Flash«ґяMЅЋMetal‘≠…ъ±ЊµЎЌ∆јня@ВАИцЊ∞°£љЎ÷Ѕ∞lЄе£ђHugging Face…ѕantirezƒ«ВАdeepseek-v4-ggufВ}Ом£ђЊЌ“—љЫ”–25000іќѕ¬ЁdЅЋ°£

√њ“Љіќѕ¬Ёd£ђґЉ“вќґ÷ш”–»Ћ‘Џ„‘ЉЇµƒЩC∆ч…ѕ≈№∆рЅЋDeepSeek£ђ’≥–‘“≤ЊЌя@ьN“Љьc“Љьcµƒљ®ЅҐ∆рБнЅЋ°£

Єь÷µµ√„Ґ“вµƒ «яBжi–ІС™°£

Hacker News…ѕ”–я@Ш”“ЉЧlЄяўЭ‘u’У£ђЋы’f»зєы“‘бббШМ¶ЊЂі_µƒGPUЉ”ƒ£–ЌљMЇѕШЛљ®≥ђГЮїѓЌ∆јн“э«жХю‘хШ”£њGPU‘љБн‘љўF£ђ≥йѕуМ”»•µфµ√‘љґа£ђГЮїѓњ’йgЊЌ‘љіу°£

я@ВАЈљѕт“Љµ©±їтЮ„C£ђ“вќґ÷ш√њ“Љіъ”–Ј÷Ѕњµƒй_‘іƒ£–Ќ∞l≤ЉХr£ђґЉХю”–»Ћћш≥цБнљoЋь„цМ£Мў“э«ж°ҐМ£МўЅњїѓ°ҐМ£Мўagentљ”»л°£

[ќпГrпwЭqµƒХrЇт я@Ш” °еXўПќпЇ№Ћђ]

Ї√–¬¬ДЫ]»Ћ‘u’У‘хьN––£ђќ“Бн’fО„Њд

≤їЋгњм£ђµЂМСіъіa°Ґ’{‘Зя@–©»’≥£є§„чЌк»ЂЙт”√°£

Єь”–“вЋЉµƒ «£ђantirez «™Ъ„‘“Љ»ЋЌ®я^GPT-5.5Ќк≥…µƒ’ыВАя@ВАнЧƒњ°£

јыЇ√DeepSeek

ЄщУюЌв√љИуµј£ђDeepSeekƒњ«∞’э‘ЏМ§«уЄяя_73.5Г|√ј‘™µƒ»ЏўY£ђЅЇќƒдhђF‘ЏЊЌћО‘Џя@ВАкPжIµƒёD’џьc…ѕ£ђ”√…ћШIФҐ ¬»°іъDeepSeekя^ЌщµƒЉЉ–gФҐ ¬°£

ƒ«ЌґўY»Ћњі ≤ьN£њ≤ї÷ї «њіƒ£–Ќ≈№Ј÷£ђ≤ї÷ї «њіAPI’{”√Ѕњ£ђЄьњі…ъСBќїЇЌ≤їњ…ћжіъ–‘°£

“ЉВАЇ£Ќв÷™√ый_∞lіуј–£ђоК“вЮйƒгµƒƒ£–ЌМСМ£”√“э«ж£ђя@±Њ…нЊЌ’f√чDeepSeek‘ЏЇ£Ќв”–÷ш“Љґ®µƒ…ъСBµЎќї°£

я^»•“Љƒк£ђ÷–Зшй_‘іƒ£–Ќµƒ≥цЇ£ФҐ ¬—e£ђ÷чЅчЇвЅњШЋ„Љ «benchmark£ђMMLU°ҐHumanEval°ҐSWE-bench£ђ“ЉіЃ”÷“ЉіЃµƒФµ„÷°£

µЂ”–»ЋоК“вЗъј@ƒг„цЈ°іќє§≥ћ£ђ≤≈іъ±нƒгµƒƒ£–Ќ±ї’Jњ…ЅЋ°£Anthropic”√«ІЖЦ„цМНтЮ£ђCursor’фрsKimi£ђя@ЈN’Jњ…±»Ј÷ФµЄь÷µеX°£

antirez≤ї «AI»¶—eƒ«ЈN ≤ьN–¬ƒ£–ЌґЉ“™‘З“Љ±йµƒ≤©÷ч

Ћыяx“ЉВАƒ£–Ќ£ђ»їббяА“™ї®О„÷№µƒХrйg»•МСМ£”√Ќ∆јн“э«ж°Ґ„цћЎ÷∆Ѕњїѓ°ҐіоHTTPЈюД’М”°Ґ„цagentЉѓ≥…Ьy‘З£ђп@»ї «Ћы’JЮйDeepSeek÷µµ√°£

я@ЊЌ„Гѕаµ»мґ£ђ“ЉВА”––≈„uµƒµЏ»юЈљ£ђ‘Џ”√„‘ЉЇµƒХrйgЇЌ√ы¬ХљoDeepSeek-V4±≥Хш°£

’fµљЗшЃaƒ£–Ќ≥цЇ££ђƒњ«∞ќ“ƒ№ѕлµљµƒ¬Ј”–Г…Чl°£

“ЉЧl «API±ї’{”√°£ƒгћбє©ЈюД’£ђДe»ЋЄґўM є”√£ђƒг «service provider£ђњЌСф «consumer°£

я@Чl¬ЈЇ№÷±љ”£ђ“≤Ї№ђFМН£ђДe»Ћњ…“‘лSХr«–УQ£ђƒгЯoХrЯoњћґЉµ√М¶њєƒгµƒЄВ∆Ј£ђПƒ–‘ƒ№µљГrЄс°£

Ѕн“ЉЧl «ƒ£–Ќ±їЄƒ‘м°£”–»Ћ∞—ƒгµƒЩа÷Ўƒ√„я£ђ„цЅњїѓ°Ґ„ц’фрs°Ґ„цМ£”√runtime°Ґ„ц±ЊµЎ≤њ р°Ґ„цagentє§ЊяжЬ°£‘Џя@Чl¬Ј—e£ђƒгµƒƒ£–Ќ≥…ЅЋ≤ƒЅѕ°£

≤ƒЅѕЇЌЈюД’µƒЕ^Дe‘Џмґ£ђ≤ƒЅѕХю±ї«ґ»лµљДe»Ћµƒє§ЊяжЬ—e£ђ»їббЊЌЇ№лy±їУQµфЅЋ°£

≈eВАјэ„”£ђƒ≥ВАй_∞l’я∞—ds4Љѓ≥…µљ„‘ЉЇµƒcoding agent—e£ђМСЅЋ“Љґ—≈д÷√ќƒЉю°Ґ’{‘Зƒ_±Њ°Ґ„‘Д”їѓЅч≥ћ°£ЋыµƒИFк†≥…ЖT“≤ґЉЅХСTЅЋя@ћ„є§Њя£ђєЂЋЊµƒіъіaОм—eµљћОґЉ «їщмґDeepSeek±ЊµЎЌ∆јнµƒ’{”√°£

я@ХrЇт»зєы“™УQ≥…Дeµƒƒ£–Ќ£ђЊЌ≤ї «°∞ЄƒВАAPI key°±ƒ«ьNЇЖЖќЅЋ£ђґш «“™÷Ў–¬яm≈д“э«ж°Ґ÷ЎМСƒ_±Њ°Ґ÷Ў–¬≈а”ЦИFк†ЅХСT°£≥…±ЊћЂЄя£ђіуЄ≈¬ ЊЌ≤їУQЅЋ°£

я@ЊЌ «°∞±ї«ґ»л°±µƒ’≥–‘°£

ds4∞—DeepSeek V4 Flash«ґяMЅЋMetal‘≠…ъ±ЊµЎЌ∆јня@ВАИцЊ∞°£љЎ÷Ѕ∞lЄе£ђHugging Face…ѕantirezƒ«ВАdeepseek-v4-ggufВ}Ом£ђЊЌ“—љЫ”–25000іќѕ¬ЁdЅЋ°£

√њ“Љіќѕ¬Ёd£ђґЉ“вќґ÷ш”–»Ћ‘Џ„‘ЉЇµƒЩC∆ч…ѕ≈№∆рЅЋDeepSeek£ђ’≥–‘“≤ЊЌя@ьN“Љьc“Љьcµƒљ®ЅҐ∆рБнЅЋ°£

Єь÷µµ√„Ґ“вµƒ «яBжi–ІС™°£

Hacker News…ѕ”–я@Ш”“ЉЧlЄяўЭ‘u’У£ђЋы’f»зєы“‘бббШМ¶ЊЂі_µƒGPUЉ”ƒ£–ЌљMЇѕШЛљ®≥ђГЮїѓЌ∆јн“э«жХю‘хШ”£њGPU‘љБн‘љўF£ђ≥йѕуМ”»•µфµ√‘љґа£ђГЮїѓњ’йgЊЌ‘љіу°£

я@ВАЈљѕт“Љµ©±їтЮ„C£ђ“вќґ÷ш√њ“Љіъ”–Ј÷Ѕњµƒй_‘іƒ£–Ќ∞l≤ЉХr£ђґЉХю”–»Ћћш≥цБнљoЋь„цМ£Мў“э«ж°ҐМ£МўЅњїѓ°ҐМ£Мўagentљ”»л°£

[ќпГrпwЭqµƒХrЇт я@Ш” °еXўПќпЇ№Ћђ]

| Ј÷ѕн: |

| „Ґ£Ї | ‘ЏіЋнУйЖ„x»Ђќƒ |

| —”…мйЖ„x |

Ќ∆Ћ]: