DeepSeekШћНјЦЛЙћБОЖљ ЗжБвВЛЛЈЪЕЯж"СњЯКздгЩ"

дкM3 Max 128GBЕФMacBook ProЩЯЃЌЪЕВтЫйЖШЪЧУПУыФмЩњГЩ26ИізжзѓгвЁЃM3 Ultra 512GBЕФMac StudioЩЯФмХмЕНУПУы36ИізжЁЃ

ВЛЫуПьЃЌЕЋаДДњТыЁЂЕїЪдетаЉШеГЃЙЄзїЭъШЋЙЛгУЁЃ

ИќгавтЫМЕФЪЧЃЌantirezЪЧЖРздвЛШЫЭЈЙ§GPT-5.5ЭъГЩЕФећИіетИіЯюФПЁЃ

РћКУDeepSeek

ИљОнЭтУНБЈЕРЃЌDeepSeekФПЧАе§дкбАЧѓИпДя73.5вкУРдЊЕФШкзЪЃЌСКЮФЗцЯждкОЭДІдкетИіЙиМќЕФзЊелЕуЩЯЃЌгУЩЬвЕа№ЪТШЁДњDeepSeekЙ§ЭљЕФММЪѕа№ЪТЁЃ

ФЧЭЖзЪШЫПДЪВУДЃПВЛжЛЪЧПДФЃаЭХмЗжЃЌВЛжЛЪЧПДAPIЕїгУСПЃЌИќПДЩњЬЌЮЛКЭВЛПЩЬцДњадЁЃ

вЛИіКЃЭтжЊУћПЊЗЂДѓРаЃЌдИвтЮЊФуЕФФЃаЭаДзЈгУв§ЧцЃЌетБОЩэОЭЫЕУїDeepSeekдкКЃЭтгазХвЛЖЈЕФЩњЬЌЕиЮЛЁЃ

Й§ШЅвЛФъЃЌжаЙњПЊдДФЃаЭЕФГіКЃа№ЪТРяЃЌжїСїКтСПБъзМЪЧbenchmarkЃЌMMLUЁЂHumanEvalЁЂSWE-benchЃЌвЛДЎгжвЛДЎЕФЪ§зжЁЃ

ЕЋгаШЫдИвтЮЇШЦФузіЖўДЮЙЄГЬЃЌВХДњБэФуЕФФЃаЭБЛШЯПЩСЫЁЃAnthropicгУЧЇЮЪзіЪЕбщЃЌCursorеєСѓKimiЃЌетжжШЯПЩБШЗжЪ§ИќжЕЧЎЁЃ

antirezВЛЪЧAIШІРяФЧжжЪВУДаТФЃаЭЖМвЊЪдвЛБщЕФВЉжї

ЫћбЁвЛИіФЃаЭЃЌШЛКѓЛЙвЊЛЈМИжмЕФЪБМфШЅаДзЈгУЭЦРэв§ЧцЁЂзіЬижЦСПЛЏЁЂДюHTTPЗўЮёВуЁЂзіagentМЏГЩВтЪдЃЌЯдШЛЪЧЫћШЯЮЊDeepSeekжЕЕУЁЃ

етОЭБфЯрЕШгкЃЌвЛИігааХгўЕФЕкШ§ЗНЃЌдкгУздМКЕФЪБМфКЭУћЩљИјDeepSeek-V4БГЪщЁЃ

ЫЕЕНЙњВњФЃаЭГіКЃЃЌФПЧАЮвФмЯыЕНЕФТЗгаСНЬѕЁЃ

вЛЬѕЪЧAPIБЛЕїгУЁЃФуЬсЙЉЗўЮёЃЌБ№ШЫИЖЗбЪЙгУЃЌФуЪЧservice providerЃЌПЭЛЇЪЧconsumerЁЃ

етЬѕТЗКмжБНгЃЌвВКмЯжЪЕЃЌБ№ШЫПЩвдЫцЪБЧаЛЛЃЌФуЮоЪБЮоПЬЖМЕУЖдПЙФуЕФОКЦЗЃЌДгадФмЕНМлИёЁЃ

СэвЛЬѕЪЧФЃаЭБЛИФдьЁЃгаШЫАбФуЕФШЈжиФУзпЃЌзіСПЛЏЁЂзіеєСѓЁЂзізЈгУruntimeЁЂзіБОЕиВПЪ№ЁЂзіagentЙЄОпСДЁЃдкетЬѕТЗРяЃЌФуЕФФЃаЭГЩСЫВФСЯЁЃ

ВФСЯКЭЗўЮёЕФЧјБ№дкгкЃЌВФСЯЛсБЛЧЖШыЕНБ№ШЫЕФЙЄОпСДРяЃЌШЛКѓОЭКмФбБЛЛЛЕєСЫЁЃ

ОйИіР§згЃЌФГИіПЊЗЂепАбds4МЏГЩЕНздМКЕФcoding agentРяЃЌаДСЫвЛЖбХфжУЮФМўЁЂЕїЪдНХБОЁЂздЖЏЛЏСїГЬЁЃЫћЕФЭХЖгГЩдБвВЖМЯАЙпСЫетЬзЙЄОпЃЌЙЋЫОЕФДњТыПтРяЕНДІЖМЪЧЛљгкDeepSeekБОЕиЭЦРэЕФЕїгУЁЃ

етЪБКђШчЙћвЊЛЛГЩБ№ЕФФЃаЭЃЌОЭВЛЪЧЁАИФИіAPI keyЁБФЧУДМђЕЅСЫЃЌЖјЪЧвЊжиаТЪЪХфв§ЧцЁЂжиаДНХБОЁЂжиаТХрбЕЭХЖгЯАЙпЁЃГЩБОЬЋИпЃЌДѓИХТЪОЭВЛЛЛСЫЁЃ

етОЭЪЧЁАБЛЧЖШыЁБЕФеГадЁЃ

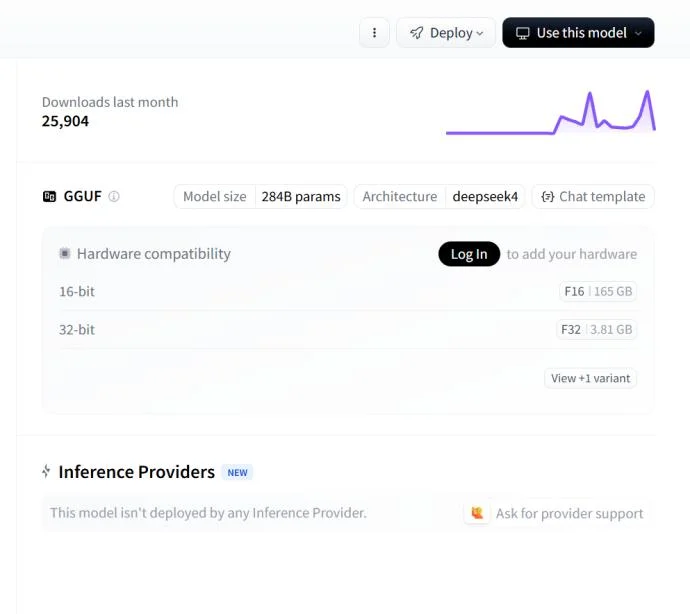

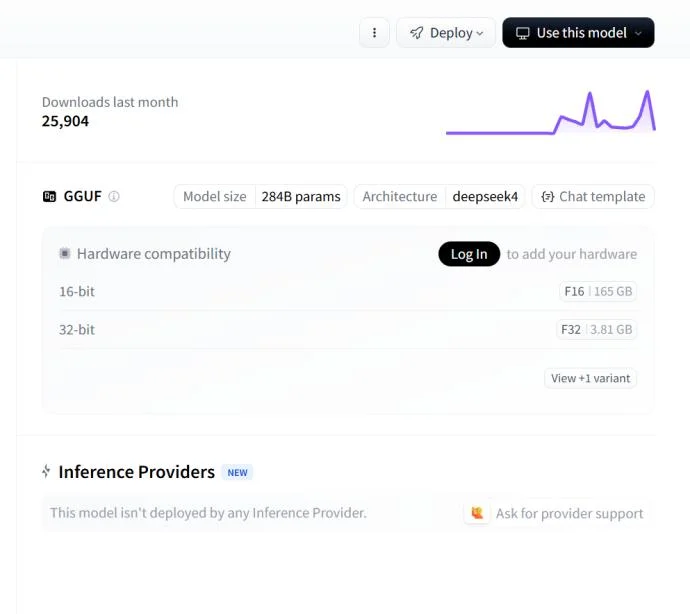

ds4АбDeepSeek V4 FlashЧЖНјСЫMetalдЩњБОЕиЭЦРэетИіГЁОАЁЃНижСЗЂИхЃЌHugging FaceЩЯantirezФЧИіdeepseek-v4-ggufВжПтЃЌОЭвбОга25000ДЮЯТдиСЫЁЃ

УПвЛДЮЯТдиЃЌЖМвтЮЖзХгаШЫдкздМКЕФЛњЦїЩЯХмЦ№СЫDeepSeekЃЌеГадвВОЭетУДвЛЕувЛЕуЕФНЈСЂЦ№РДСЫЁЃ

ИќжЕЕУзЂвтЕФЪЧСЌЫјаЇгІЁЃ

Hacker NewsЩЯгаетбљвЛЬѕИпдоЦРТлЃЌЫћЫЕШчЙћвдКѓеыЖдОЋШЗЕФGPUМгФЃаЭзщКЯЙЙНЈГЌгХЛЏЭЦРэв§ЧцЛсдѕбљЃПGPUдНРДдНЙѓЃЌГщЯѓВуШЅЕєЕУдНЖрЃЌгХЛЏПеМфОЭдНДѓЁЃ

етИіЗНЯђвЛЕЉБЛбщжЄЃЌвтЮЖзХУПвЛДњгаЗжСПЕФПЊдДФЃаЭЗЂВМЪБЃЌЖМЛсгаШЫЬјГіРДИјЫќзізЈЪєв§ЧцЁЂзЈЪєСПЛЏЁЂзЈЪєagentНгШыЁЃ

[ЮяМлЗЩеЧЕФЪБКђ етбљЪЁЧЎЙКЮяКмЫЌ]

ЮоЦРТлВЛаТЮХЃЌЗЂБэвЛЯТФњЕФвтМћАЩ

ВЛЫуПьЃЌЕЋаДДњТыЁЂЕїЪдетаЉШеГЃЙЄзїЭъШЋЙЛгУЁЃ

ИќгавтЫМЕФЪЧЃЌantirezЪЧЖРздвЛШЫЭЈЙ§GPT-5.5ЭъГЩЕФећИіетИіЯюФПЁЃ

РћКУDeepSeek

ИљОнЭтУНБЈЕРЃЌDeepSeekФПЧАе§дкбАЧѓИпДя73.5вкУРдЊЕФШкзЪЃЌСКЮФЗцЯждкОЭДІдкетИіЙиМќЕФзЊелЕуЩЯЃЌгУЩЬвЕа№ЪТШЁДњDeepSeekЙ§ЭљЕФММЪѕа№ЪТЁЃ

ФЧЭЖзЪШЫПДЪВУДЃПВЛжЛЪЧПДФЃаЭХмЗжЃЌВЛжЛЪЧПДAPIЕїгУСПЃЌИќПДЩњЬЌЮЛКЭВЛПЩЬцДњадЁЃ

вЛИіКЃЭтжЊУћПЊЗЂДѓРаЃЌдИвтЮЊФуЕФФЃаЭаДзЈгУв§ЧцЃЌетБОЩэОЭЫЕУїDeepSeekдкКЃЭтгазХвЛЖЈЕФЩњЬЌЕиЮЛЁЃ

Й§ШЅвЛФъЃЌжаЙњПЊдДФЃаЭЕФГіКЃа№ЪТРяЃЌжїСїКтСПБъзМЪЧbenchmarkЃЌMMLUЁЂHumanEvalЁЂSWE-benchЃЌвЛДЎгжвЛДЎЕФЪ§зжЁЃ

ЕЋгаШЫдИвтЮЇШЦФузіЖўДЮЙЄГЬЃЌВХДњБэФуЕФФЃаЭБЛШЯПЩСЫЁЃAnthropicгУЧЇЮЪзіЪЕбщЃЌCursorеєСѓKimiЃЌетжжШЯПЩБШЗжЪ§ИќжЕЧЎЁЃ

antirezВЛЪЧAIШІРяФЧжжЪВУДаТФЃаЭЖМвЊЪдвЛБщЕФВЉжї

ЫћбЁвЛИіФЃаЭЃЌШЛКѓЛЙвЊЛЈМИжмЕФЪБМфШЅаДзЈгУЭЦРэв§ЧцЁЂзіЬижЦСПЛЏЁЂДюHTTPЗўЮёВуЁЂзіagentМЏГЩВтЪдЃЌЯдШЛЪЧЫћШЯЮЊDeepSeekжЕЕУЁЃ

етОЭБфЯрЕШгкЃЌвЛИігааХгўЕФЕкШ§ЗНЃЌдкгУздМКЕФЪБМфКЭУћЩљИјDeepSeek-V4БГЪщЁЃ

ЫЕЕНЙњВњФЃаЭГіКЃЃЌФПЧАЮвФмЯыЕНЕФТЗгаСНЬѕЁЃ

вЛЬѕЪЧAPIБЛЕїгУЁЃФуЬсЙЉЗўЮёЃЌБ№ШЫИЖЗбЪЙгУЃЌФуЪЧservice providerЃЌПЭЛЇЪЧconsumerЁЃ

етЬѕТЗКмжБНгЃЌвВКмЯжЪЕЃЌБ№ШЫПЩвдЫцЪБЧаЛЛЃЌФуЮоЪБЮоПЬЖМЕУЖдПЙФуЕФОКЦЗЃЌДгадФмЕНМлИёЁЃ

СэвЛЬѕЪЧФЃаЭБЛИФдьЁЃгаШЫАбФуЕФШЈжиФУзпЃЌзіСПЛЏЁЂзіеєСѓЁЂзізЈгУruntimeЁЂзіБОЕиВПЪ№ЁЂзіagentЙЄОпСДЁЃдкетЬѕТЗРяЃЌФуЕФФЃаЭГЩСЫВФСЯЁЃ

ВФСЯКЭЗўЮёЕФЧјБ№дкгкЃЌВФСЯЛсБЛЧЖШыЕНБ№ШЫЕФЙЄОпСДРяЃЌШЛКѓОЭКмФбБЛЛЛЕєСЫЁЃ

ОйИіР§згЃЌФГИіПЊЗЂепАбds4МЏГЩЕНздМКЕФcoding agentРяЃЌаДСЫвЛЖбХфжУЮФМўЁЂЕїЪдНХБОЁЂздЖЏЛЏСїГЬЁЃЫћЕФЭХЖгГЩдБвВЖМЯАЙпСЫетЬзЙЄОпЃЌЙЋЫОЕФДњТыПтРяЕНДІЖМЪЧЛљгкDeepSeekБОЕиЭЦРэЕФЕїгУЁЃ

етЪБКђШчЙћвЊЛЛГЩБ№ЕФФЃаЭЃЌОЭВЛЪЧЁАИФИіAPI keyЁБФЧУДМђЕЅСЫЃЌЖјЪЧвЊжиаТЪЪХфв§ЧцЁЂжиаДНХБОЁЂжиаТХрбЕЭХЖгЯАЙпЁЃГЩБОЬЋИпЃЌДѓИХТЪОЭВЛЛЛСЫЁЃ

етОЭЪЧЁАБЛЧЖШыЁБЕФеГадЁЃ

ds4АбDeepSeek V4 FlashЧЖНјСЫMetalдЩњБОЕиЭЦРэетИіГЁОАЁЃНижСЗЂИхЃЌHugging FaceЩЯantirezФЧИіdeepseek-v4-ggufВжПтЃЌОЭвбОга25000ДЮЯТдиСЫЁЃ

УПвЛДЮЯТдиЃЌЖМвтЮЖзХгаШЫдкздМКЕФЛњЦїЩЯХмЦ№СЫDeepSeekЃЌеГадвВОЭетУДвЛЕувЛЕуЕФНЈСЂЦ№РДСЫЁЃ

ИќжЕЕУзЂвтЕФЪЧСЌЫјаЇгІЁЃ

Hacker NewsЩЯгаетбљвЛЬѕИпдоЦРТлЃЌЫћЫЕШчЙћвдКѓеыЖдОЋШЗЕФGPUМгФЃаЭзщКЯЙЙНЈГЌгХЛЏЭЦРэв§ЧцЛсдѕбљЃПGPUдНРДдНЙѓЃЌГщЯѓВуШЅЕєЕУдНЖрЃЌгХЛЏПеМфОЭдНДѓЁЃ

етИіЗНЯђвЛЕЉБЛбщжЄЃЌвтЮЖзХУПвЛДњгаЗжСПЕФПЊдДФЃаЭЗЂВМЪБЃЌЖМЛсгаШЫЬјГіРДИјЫќзізЈЪєв§ЧцЁЂзЈЪєСПЛЏЁЂзЈЪєagentНгШыЁЃ

[ЮяМлЗЩеЧЕФЪБКђ етбљЪЁЧЎЙКЮяКмЫЌ]

| ЗжЯэ: |

| зЂЃК | дкДЫвГдФЖСШЋЮФ |

| бгЩьдФЖС |

ЭЦМі: