[印度] 印度工人頭戴攝像頭 邊打工邊教機器人搶自己飯碗

機器人的數據困境有多誇張呢?有個數字可以感受壹下。目前機器人領域頭部開源數據集 OpenX-Embodiment,匯聚了全球 22 種不同機器人本體、311 個場景下的 100 萬條操作軌跡。聽起來挺壯觀,但大語言模型的訓練數據動輒萬億 token,和 100 萬放在壹起,差了整整六個數量級。

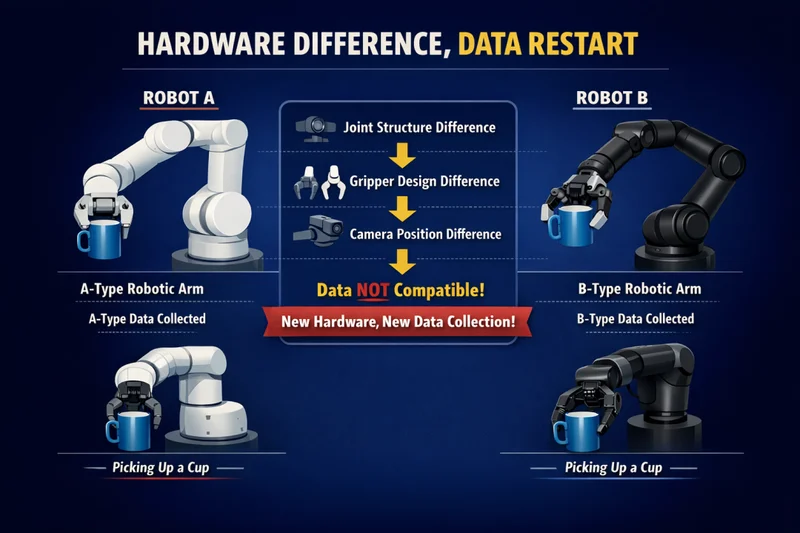

真機遙操還有另外壹個麻煩,數據和硬件強綁定。

過去大多數操作數據,都是用特定型號的機器人采集的。A 型機械臂的數據,很難直接拿去訓練 B 型機械臂。機械臂的關節結構不同、末端夾爪的形狀不同、攝像頭的位置不同,同樣的"拿起杯子"這個動作,在兩種機器人身上對應的運動軌跡可以完全不壹樣。換壹款硬件,數據就得重新采,等於每次升級硬件,都要回到原點重新開始。

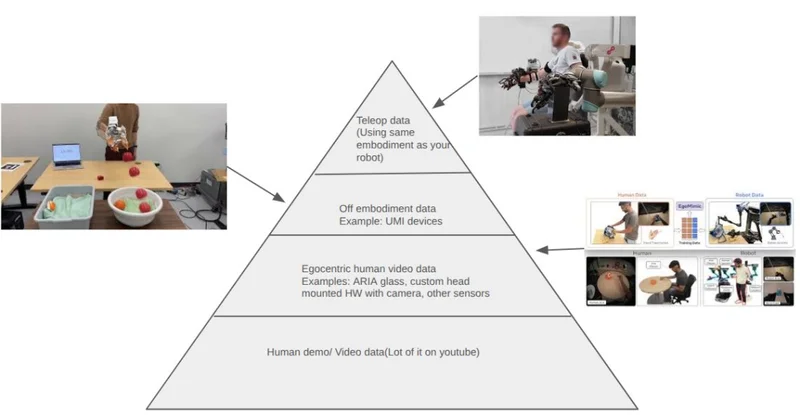

要打破這個僵局,就需要把數據和機器解綁。比如不依賴特定型號的機器人,直接從人身上采集操作數據——無本體數據。

因為人類做“拿起杯子”這個動作,其手部軌跡(位置、姿態)是相對於世界坐標系或自身軀幹的,可以通過運動學映射轉換到不同幾何尺寸和關節配置的機械臂上。數據采壹次,可以反復用在不同硬件上。

更重要的是,這種采集方式成本足夠低,可以輕松覆蓋大量不同的真實場景。研究人員做過測試,同樣數量的數據,分布在 32 個不同環境、每個環境各 50 條,比全部集中在壹個環境的 1600 條,訓練出來的模型泛化能力強得多。

機器人需要見過足夠多"不壹樣的世界",才能在壹個從沒見過的新場景裡不慌不亂。這也是為啥 Ego 數據方案這麼強調要在真實場景裡采集。不同的工廠、不同的操作台、不同的工人,每壹個細微的差異,對模型來說都是養分。

今年4月,Generalist 發布 GEN-1。這款模型用 50 萬小時人類操作視頻訓練而成,效果相當驚人:在折紙箱、手機裝盒等任務上,平均成功率從 64% 直接拉到 99%,速度也比上壹代提升了叁倍。

[物價飛漲的時候 這樣省錢購物很爽]

| 分享: |

| 注: | 在此頁閱讀全文 |

| 延伸閱讀 | 更多... |

推薦: