[印度] 印度工人頭戴攝像頭 邊打工邊教機器人搶自己飯碗

最近,壹段來自印度(专题)南部服裝廠的視頻在國內外社交平台上瘋傳。

畫面裡,流水線上的工人正在低頭縫紉,和普通的工廠場景沒什麼兩樣,除了壹件事——每個人頭上都戴著壹個攝像頭環。

評論區吵成了兩派。壹派說這是老板在監視員工,抓人摸魚的新花樣;另壹派說不對,這是在給機器人喂數據。

兩派說法都很地獄,但後者,才是整件事真正讓人坐立不安的地方。

01.打工人正在被錄像存檔

那個戴著攝像頭環的工人,正在做的事情有個技術名詞,叫采集"Ego 數據",全稱是“第壹人稱視角數據”。

邏輯很簡單:把攝像頭架在頭頂,記錄下工人幹活時的第壹視角,手怎麼抬、怎麼落、怎麼捏住壹根線穿過針眼。每壹幀畫面,都會變成喂給 AI 模型的訓練素材。

工人的雙手,成了機器人的老師。

親手教會機器人取代自己。普通人聽到這種事會感受到壹種生理性的冒犯,但業內對此很興奮,因為這種方式,實在太!便!宜!了!

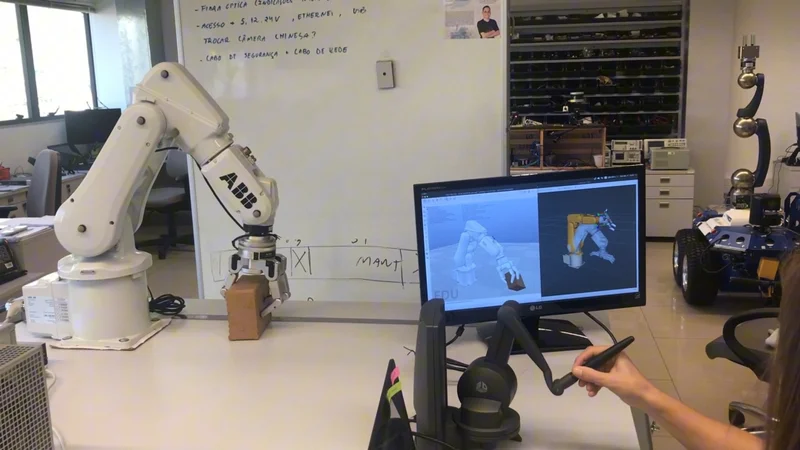

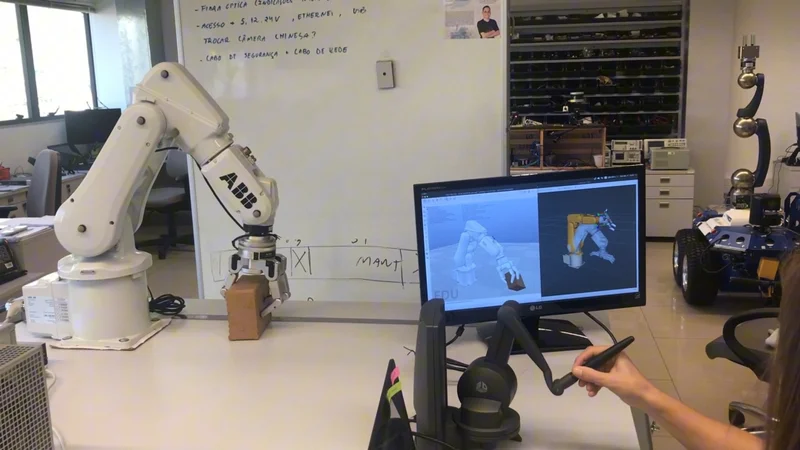

過去,機器人行業訓練模型的主流方式叫"真機遙操",聽上去很科幻,操作起來其實很笨重:壹個工程師戴上 VR 頭顯,眼前的畫面同步到機器人的攝像頭視角,然後他要像遙控玩具壹樣,手把手地控制機器人的每壹個動作——拿起這個杯子,放到那個托盤上,再拿起那塊布,折疊,放好。整個過程壹幀壹幀地被錄下來,這就是訓練數據。

這套方案最大的問題是貴,而且慢。

壹台用於數采的機器人本體,動輒幾拾萬。還得配專職的數采員,培訓上崗,全程盯著。采集壹條高質量的操作數據,可能要耗掉工程師大半天時間,工程師的工資又很高。

Ego 數據方案把這套流程從根上改了:工人戴上頭頂的攝像頭,綁上腕部的追蹤器(有些方案還會配壹副特制手套)。換裝完畢,正常上工就行。

這叁層設備各有分工。頭戴攝像頭負責記錄第壹視角的完整畫面——操作台的布局、物體的位置、手和目標物之間的空間關系;腕部攝像頭對准手部,專門捕捉手在近距離操作時的細節;穿戴手套則完全不依賴視覺,直接用傳感器測量每根手指的關節角度。

叁層疊加,就還原了壹個完整的操作動作——人的眼睛看到了什麼、手在哪裡、手指該怎麼動。通過這些樣本,機器人可以學習從視覺到動作的映射關系,即看到某個畫面時,應該做些什麼。

這裡面有壹個小 bug,機器人學誰,就像誰。

如果被采集的工人是個熟練工,動作幹脆、力道精准,那機器人學出來的就是壹套行雲流水的操作。可萬壹這位工人習慣摸魚,比如擰螺絲前先撓撓頭,放零件時要抖兩下手腕,甚至壹邊幹活壹邊東張西望……那機器人也會把這些多余的動作當成標准流程學進去。

所以視頻裡,整個車間只有壹排工人頭上戴了攝像頭,或許,他們是整個車間選出來的最好的工人。

還有更簡單粗暴的方式,是只篩選數據,不篩選人。美國有壹家叫做 Generalist AI 的公司,他們用眾包的方式,把低成本穿戴設備分發給世界各地的普通人。不管是你在家折衣服、在廚房洗碗,還是在修車鋪擰螺絲,只要戴上設備,人人皆可邊幹活邊采數據。

業內對此充滿了懷疑,普通人在家裡采出來的數據,質量根本沒法和專業數采中心比,怎麼能訓練出高成功率的模型?

答案是大力出奇跡。海量的原始數據進來,系統自動篩選,低質量的直接丟掉,只留下那些叁層數據對得上的高置信度樣本。數據量足夠大,過濾完還剩得夠多,就能用。

所以越來越多的數采方案開始強調"輕量化",設備越做越小,目標就是讓采集完全融入日常工作,對工人的動作幹擾降到零。業內已經有團隊在研究把攝像頭集成進普通眼鏡,手套也在往更輕薄的方向迭代,最終形態可能是壹副眼鏡加壹塊手表,穿上就采,看不出來和普通上班有什麼區別。

這張采集數據網正在全球快速鋪開。硅谷的實驗室、東南亞的代工廠、北美的物流分揀中心、歐洲的家庭廚房裡,成千上萬個傳感器正如同毛細血管般伸向人類的日常。這種生意已經催生出了專門的“數據供應商”。比如許多公司正在推廣的通用移動接口(UMI)方案,它徹底切斷了數據與特定機器人硬件的綁定。有測算顯示,這種脫離了昂貴真機、只靠穿戴設備的采集方式,單條數據的生產成本僅為傳統方案的伍分之壹,效率卻翻了伍倍。

印度工廠那個畫面,只是這張大網上,壹個最先被普通人看見的節點。

而這種近乎掠奪式的大規模采集,背後折射出的是壹個令 AI 巨頭們焦慮的真相:機器人沒“米”下鍋了!

02.機器人也有數據荒

在數字世界裡,AI 是銜著金湯勺出生的。

大語言模型的訓練素材來自整個互聯網。幾拾年來人類隨手丟在網上的文字、代碼、新聞、甚至論壇裡的廢話帖子,對 GPT 們來說都是取之不盡的養分。只要算力足夠,AI 能在幾天內讀完人類幾千年的文明。

但機器人需要的數據完全是另壹回事:每壹次抓取、放置、翻轉,都必須真實發生在物理世界裡,沒辦法從網上下載,更無法批量復制。

這就是為什麼機器人馬拉松比賽中,那些重金打造的頂級人形機器人,還是會在走路時突然摔跟頭,看起來很不聰明的樣子。

那用仿真數據不行嗎?在電腦裡搭壹個虛擬工廠,讓機器人在裡面反復練,不就解決了?

確實有人這麼做,有效果,但有個繞不過去的問題,業內叫"sim-to-real gap"(仿真到現實的鴻溝)。虛擬世界裡的物理規則是被簡化過的,光線是理想的,桌面是平的,物體的摩擦力是預設的;而真實世界裡,同壹塊布料每次堆疊的形態都不壹樣,同壹個零件每次放置的角度都有偏差。在仿真世界裡練了壹萬次的機器人,搬到真實車間,往往還是壹臉懵。

所以真實世界的操作數據,是無論都如何繞不開的。

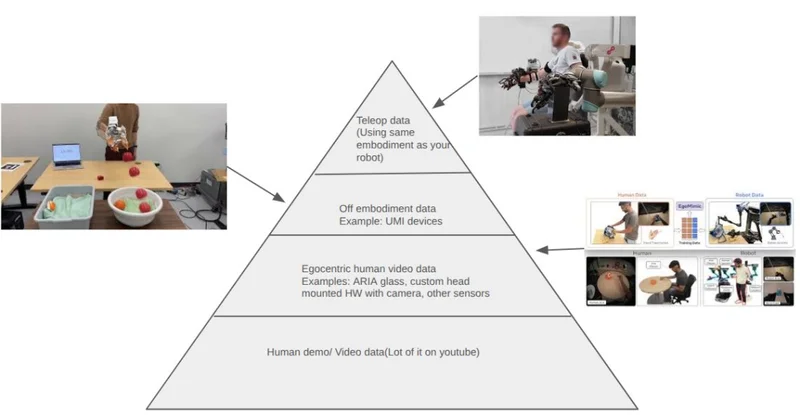

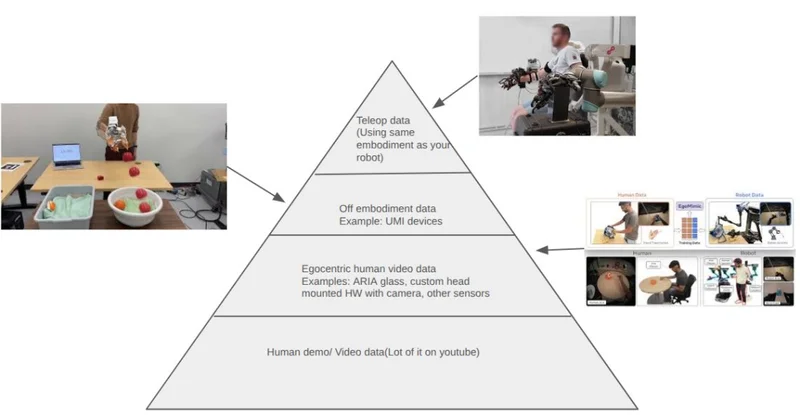

行業裡有壹個著名的數據金字塔。最底層是互聯網上現成的視頻和圖片,量大管夠,但精度太低,機器人看著人類做飯的 YouTube 視頻,頂多學個大概方向。往上壹層是專門采集的人類動作捕捉數據,需要穿戴設備,成本高壹些,質量也好壹些。塔尖是真機遙操數據,精度最高,接近機器人實際執行時的視角,數量最少,采集速度慢得像在手工打字,供給完全跟不上模型的需求。

機器人的數據困境有多誇張呢?有個數字可以感受壹下。目前機器人領域頭部開源數據集 OpenX-Embodiment,匯聚了全球 22 種不同機器人本體、311 個場景下的 100 萬條操作軌跡。聽起來挺壯觀,但大語言模型的訓練數據動輒萬億 token,和 100 萬放在壹起,差了整整六個數量級。

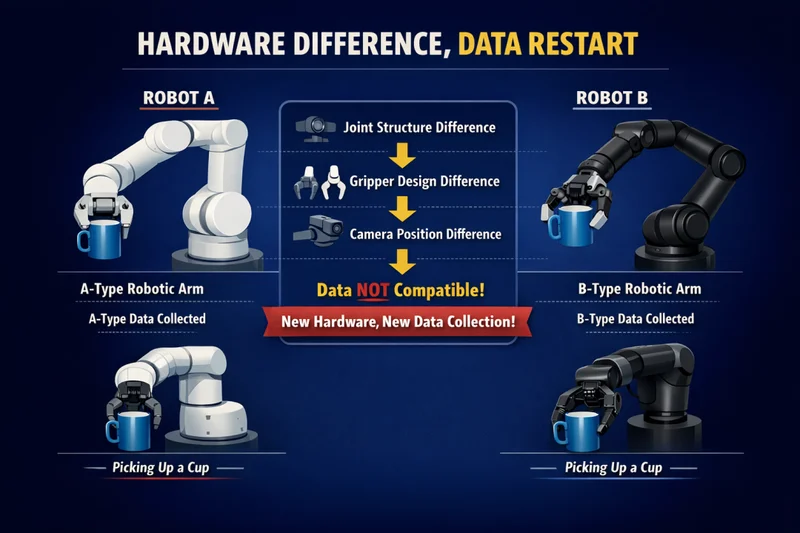

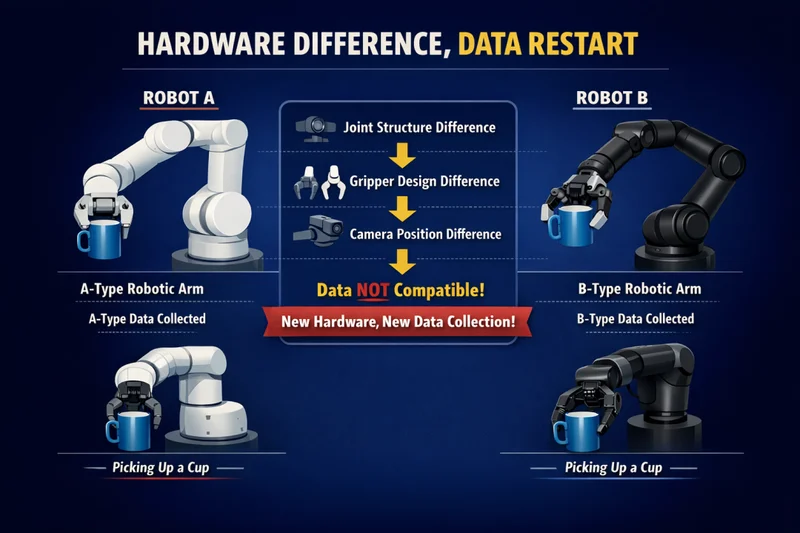

真機遙操還有另外壹個麻煩,數據和硬件強綁定。

過去大多數操作數據,都是用特定型號的機器人采集的。A 型機械臂的數據,很難直接拿去訓練 B 型機械臂。機械臂的關節結構不同、末端夾爪的形狀不同、攝像頭的位置不同,同樣的"拿起杯子"這個動作,在兩種機器人身上對應的運動軌跡可以完全不壹樣。換壹款硬件,數據就得重新采,等於每次升級硬件,都要回到原點重新開始。

要打破這個僵局,就需要把數據和機器解綁。比如不依賴特定型號的機器人,直接從人身上采集操作數據——無本體數據。

因為人類做“拿起杯子”這個動作,其手部軌跡(位置、姿態)是相對於世界坐標系或自身軀幹的,可以通過運動學映射轉換到不同幾何尺寸和關節配置的機械臂上。數據采壹次,可以反復用在不同硬件上。

更重要的是,這種采集方式成本足夠低,可以輕松覆蓋大量不同的真實場景。研究人員做過測試,同樣數量的數據,分布在 32 個不同環境、每個環境各 50 條,比全部集中在壹個環境的 1600 條,訓練出來的模型泛化能力強得多。

機器人需要見過足夠多"不壹樣的世界",才能在壹個從沒見過的新場景裡不慌不亂。這也是為啥 Ego 數據方案這麼強調要在真實場景裡采集。不同的工廠、不同的操作台、不同的工人,每壹個細微的差異,對模型來說都是養分。

今年4月,Generalist 發布 GEN-1。這款模型用 50 萬小時人類操作視頻訓練而成,效果相當驚人:在折紙箱、手機裝盒等任務上,平均成功率從 64% 直接拉到 99%,速度也比上壹代提升了叁倍。

更關鍵的是,新任務只需 1 小時真機數據就能完成遷移。吸收人類數據之後,機器人學習壹個新技能的門檻大幅下降了。

技術進步的速度令人振奮。但我們作為圍觀的打工人,感受大概完全不同——好像在幫未來的自己培養競爭對手?

03.技術進化,還是技能剝離?

視野回到那家印度服裝廠吧!

這裡有壹個矛盾,仔細想想會有點微妙:壹個縫紉工人越熟練,動作越標准,他采集出的數據質量就越高,訓練出的機器人就越容易學會這項技能。他正在用自己的手藝,教壹個永遠不會累、永遠不會離職的“學生”。

他們是最核心的知識提供者,但在價值的分配鏈條上,位置卻並不靠前。

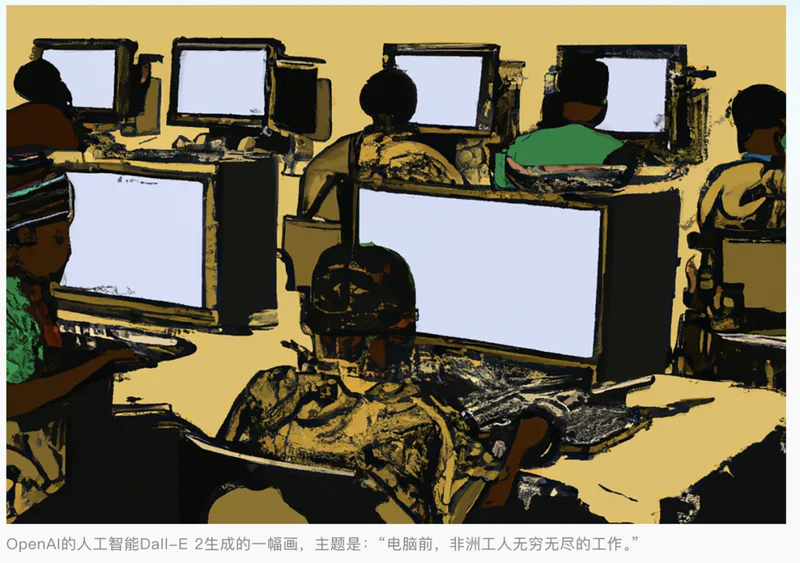

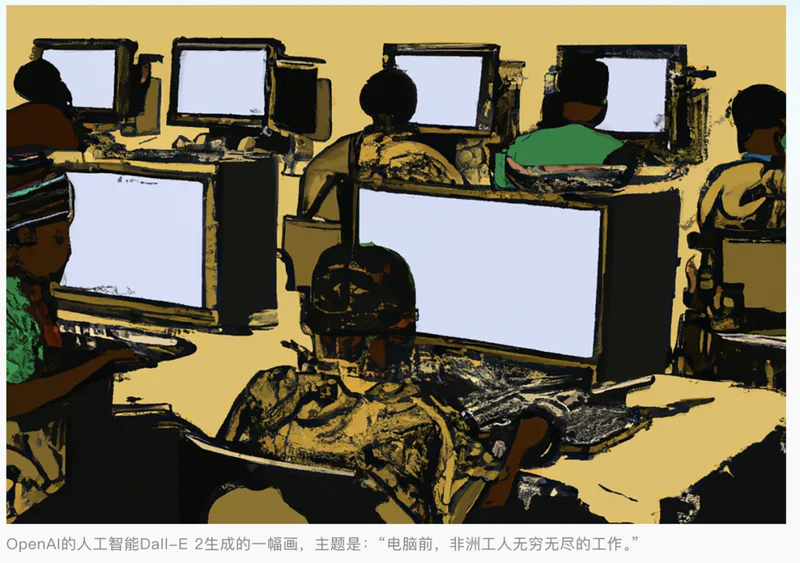

這種“底層勞動支撐頂層技術”的現象,其實不是第壹次出現。

2010 年前後,壹位斯坦福大學的教授帶著團隊在做壹件事:給全世界的圖片打標簽。貓、狗、椅子、汽車,壹張圖片標注壹個類別。這個項目叫 ImageNet,後來被證明是深度學習革命最重要的燃料之壹,幾乎所有現代 AI 視覺模型都從它那裡汲取過養分。

打標簽的人,是壹批通過亞馬遜眾包平台 Mechanical Turk 招募來的工人,大量來自東南亞和非洲,時薪約兩美元。他們坐在屏幕前,壹張壹張地點、標注、提交,日復壹日。ImageNet 最終收錄了超過 1400 萬張圖片,背後是無數個這樣的工時疊加起來的。

這位教授後來成了 AI 領域最有影響力的學者之壹,ImageNet 催生的產業價值難以估量。但那些打標簽的工人,還是拿著兩美元的時薪。

歷史正在翻開新的壹頁。數據采集的規模快速擴大,已經形成了壹條完整的產業鏈。上游是穿戴設備的硬件廠商,做頭戴攝像頭、腕部追蹤器、力感應手套;中游是數采方案和數據清洗服務商,幫客戶設計采集流程、過濾低質量數據、把原始視頻處理成模型可以直接消化的格式;下游是購買數據來訓練模型的具身智能公司,多家科技巨頭都在加速入場。

而觸覺數據是下壹個戰場。

僅靠視覺和軌跡數據,機器人還學不會那些需要感知物體軟硬、表面紋理的精細動作——捏壹個熟透的桃子和壹個生桃子,力道完全不壹樣,但攝像頭看不出來。擰壹顆螺絲,擰到幾成力才算到位,眼睛同樣判斷不了。已經有公司在數采方案裡加入了六維力傳感器,實時采集接觸時的壓力方向和大小。

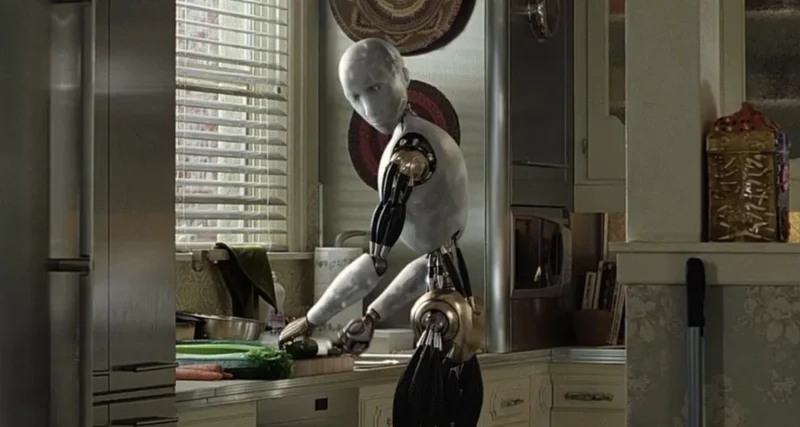

或許很快機器人就可以像科幻電影中那樣,自然而然地幫助人類做各種各樣的事情,從精細的家務到復雜的維修,從照顧老人到探索險境。

對於那些因為長期重復動作而落下腱鞘炎、頸椎病的流水線工人來說,這當然是壹個好消息,技術本身不是敵人。我們真正需要關心的,是技術創造的價值能不能讓創造它的人壹起受益。

如果說工業革命的機器是人類體力的延伸,那麼現在的具身智能就是人類直覺的復現。這種進化不該是以壹部分人的退場為代價,而應當是壹次全人類的共同升級。

蓋好房子之後,不要忘記打地基的人。讓那些曾在煙塵與轟鳴中辛勞的雙手,最終能從繁瑣中解脫出來,轉而去擁抱生活裡更多觸手可及的溫度。

這或許才是技術發展最完美的終點:由人築基,為人所用。

[加西網正招聘多名全職sales 待遇優]

好新聞沒人評論怎麼行,我來說幾句

畫面裡,流水線上的工人正在低頭縫紉,和普通的工廠場景沒什麼兩樣,除了壹件事——每個人頭上都戴著壹個攝像頭環。

評論區吵成了兩派。壹派說這是老板在監視員工,抓人摸魚的新花樣;另壹派說不對,這是在給機器人喂數據。

兩派說法都很地獄,但後者,才是整件事真正讓人坐立不安的地方。

01.打工人正在被錄像存檔

那個戴著攝像頭環的工人,正在做的事情有個技術名詞,叫采集"Ego 數據",全稱是“第壹人稱視角數據”。

邏輯很簡單:把攝像頭架在頭頂,記錄下工人幹活時的第壹視角,手怎麼抬、怎麼落、怎麼捏住壹根線穿過針眼。每壹幀畫面,都會變成喂給 AI 模型的訓練素材。

工人的雙手,成了機器人的老師。

親手教會機器人取代自己。普通人聽到這種事會感受到壹種生理性的冒犯,但業內對此很興奮,因為這種方式,實在太!便!宜!了!

過去,機器人行業訓練模型的主流方式叫"真機遙操",聽上去很科幻,操作起來其實很笨重:壹個工程師戴上 VR 頭顯,眼前的畫面同步到機器人的攝像頭視角,然後他要像遙控玩具壹樣,手把手地控制機器人的每壹個動作——拿起這個杯子,放到那個托盤上,再拿起那塊布,折疊,放好。整個過程壹幀壹幀地被錄下來,這就是訓練數據。

這套方案最大的問題是貴,而且慢。

壹台用於數采的機器人本體,動輒幾拾萬。還得配專職的數采員,培訓上崗,全程盯著。采集壹條高質量的操作數據,可能要耗掉工程師大半天時間,工程師的工資又很高。

Ego 數據方案把這套流程從根上改了:工人戴上頭頂的攝像頭,綁上腕部的追蹤器(有些方案還會配壹副特制手套)。換裝完畢,正常上工就行。

這叁層設備各有分工。頭戴攝像頭負責記錄第壹視角的完整畫面——操作台的布局、物體的位置、手和目標物之間的空間關系;腕部攝像頭對准手部,專門捕捉手在近距離操作時的細節;穿戴手套則完全不依賴視覺,直接用傳感器測量每根手指的關節角度。

叁層疊加,就還原了壹個完整的操作動作——人的眼睛看到了什麼、手在哪裡、手指該怎麼動。通過這些樣本,機器人可以學習從視覺到動作的映射關系,即看到某個畫面時,應該做些什麼。

這裡面有壹個小 bug,機器人學誰,就像誰。

如果被采集的工人是個熟練工,動作幹脆、力道精准,那機器人學出來的就是壹套行雲流水的操作。可萬壹這位工人習慣摸魚,比如擰螺絲前先撓撓頭,放零件時要抖兩下手腕,甚至壹邊幹活壹邊東張西望……那機器人也會把這些多余的動作當成標准流程學進去。

所以視頻裡,整個車間只有壹排工人頭上戴了攝像頭,或許,他們是整個車間選出來的最好的工人。

還有更簡單粗暴的方式,是只篩選數據,不篩選人。美國有壹家叫做 Generalist AI 的公司,他們用眾包的方式,把低成本穿戴設備分發給世界各地的普通人。不管是你在家折衣服、在廚房洗碗,還是在修車鋪擰螺絲,只要戴上設備,人人皆可邊幹活邊采數據。

業內對此充滿了懷疑,普通人在家裡采出來的數據,質量根本沒法和專業數采中心比,怎麼能訓練出高成功率的模型?

答案是大力出奇跡。海量的原始數據進來,系統自動篩選,低質量的直接丟掉,只留下那些叁層數據對得上的高置信度樣本。數據量足夠大,過濾完還剩得夠多,就能用。

所以越來越多的數采方案開始強調"輕量化",設備越做越小,目標就是讓采集完全融入日常工作,對工人的動作幹擾降到零。業內已經有團隊在研究把攝像頭集成進普通眼鏡,手套也在往更輕薄的方向迭代,最終形態可能是壹副眼鏡加壹塊手表,穿上就采,看不出來和普通上班有什麼區別。

這張采集數據網正在全球快速鋪開。硅谷的實驗室、東南亞的代工廠、北美的物流分揀中心、歐洲的家庭廚房裡,成千上萬個傳感器正如同毛細血管般伸向人類的日常。這種生意已經催生出了專門的“數據供應商”。比如許多公司正在推廣的通用移動接口(UMI)方案,它徹底切斷了數據與特定機器人硬件的綁定。有測算顯示,這種脫離了昂貴真機、只靠穿戴設備的采集方式,單條數據的生產成本僅為傳統方案的伍分之壹,效率卻翻了伍倍。

印度工廠那個畫面,只是這張大網上,壹個最先被普通人看見的節點。

而這種近乎掠奪式的大規模采集,背後折射出的是壹個令 AI 巨頭們焦慮的真相:機器人沒“米”下鍋了!

02.機器人也有數據荒

在數字世界裡,AI 是銜著金湯勺出生的。

大語言模型的訓練素材來自整個互聯網。幾拾年來人類隨手丟在網上的文字、代碼、新聞、甚至論壇裡的廢話帖子,對 GPT 們來說都是取之不盡的養分。只要算力足夠,AI 能在幾天內讀完人類幾千年的文明。

但機器人需要的數據完全是另壹回事:每壹次抓取、放置、翻轉,都必須真實發生在物理世界裡,沒辦法從網上下載,更無法批量復制。

這就是為什麼機器人馬拉松比賽中,那些重金打造的頂級人形機器人,還是會在走路時突然摔跟頭,看起來很不聰明的樣子。

那用仿真數據不行嗎?在電腦裡搭壹個虛擬工廠,讓機器人在裡面反復練,不就解決了?

確實有人這麼做,有效果,但有個繞不過去的問題,業內叫"sim-to-real gap"(仿真到現實的鴻溝)。虛擬世界裡的物理規則是被簡化過的,光線是理想的,桌面是平的,物體的摩擦力是預設的;而真實世界裡,同壹塊布料每次堆疊的形態都不壹樣,同壹個零件每次放置的角度都有偏差。在仿真世界裡練了壹萬次的機器人,搬到真實車間,往往還是壹臉懵。

所以真實世界的操作數據,是無論都如何繞不開的。

行業裡有壹個著名的數據金字塔。最底層是互聯網上現成的視頻和圖片,量大管夠,但精度太低,機器人看著人類做飯的 YouTube 視頻,頂多學個大概方向。往上壹層是專門采集的人類動作捕捉數據,需要穿戴設備,成本高壹些,質量也好壹些。塔尖是真機遙操數據,精度最高,接近機器人實際執行時的視角,數量最少,采集速度慢得像在手工打字,供給完全跟不上模型的需求。

機器人的數據困境有多誇張呢?有個數字可以感受壹下。目前機器人領域頭部開源數據集 OpenX-Embodiment,匯聚了全球 22 種不同機器人本體、311 個場景下的 100 萬條操作軌跡。聽起來挺壯觀,但大語言模型的訓練數據動輒萬億 token,和 100 萬放在壹起,差了整整六個數量級。

真機遙操還有另外壹個麻煩,數據和硬件強綁定。

過去大多數操作數據,都是用特定型號的機器人采集的。A 型機械臂的數據,很難直接拿去訓練 B 型機械臂。機械臂的關節結構不同、末端夾爪的形狀不同、攝像頭的位置不同,同樣的"拿起杯子"這個動作,在兩種機器人身上對應的運動軌跡可以完全不壹樣。換壹款硬件,數據就得重新采,等於每次升級硬件,都要回到原點重新開始。

要打破這個僵局,就需要把數據和機器解綁。比如不依賴特定型號的機器人,直接從人身上采集操作數據——無本體數據。

因為人類做“拿起杯子”這個動作,其手部軌跡(位置、姿態)是相對於世界坐標系或自身軀幹的,可以通過運動學映射轉換到不同幾何尺寸和關節配置的機械臂上。數據采壹次,可以反復用在不同硬件上。

更重要的是,這種采集方式成本足夠低,可以輕松覆蓋大量不同的真實場景。研究人員做過測試,同樣數量的數據,分布在 32 個不同環境、每個環境各 50 條,比全部集中在壹個環境的 1600 條,訓練出來的模型泛化能力強得多。

機器人需要見過足夠多"不壹樣的世界",才能在壹個從沒見過的新場景裡不慌不亂。這也是為啥 Ego 數據方案這麼強調要在真實場景裡采集。不同的工廠、不同的操作台、不同的工人,每壹個細微的差異,對模型來說都是養分。

今年4月,Generalist 發布 GEN-1。這款模型用 50 萬小時人類操作視頻訓練而成,效果相當驚人:在折紙箱、手機裝盒等任務上,平均成功率從 64% 直接拉到 99%,速度也比上壹代提升了叁倍。

更關鍵的是,新任務只需 1 小時真機數據就能完成遷移。吸收人類數據之後,機器人學習壹個新技能的門檻大幅下降了。

技術進步的速度令人振奮。但我們作為圍觀的打工人,感受大概完全不同——好像在幫未來的自己培養競爭對手?

03.技術進化,還是技能剝離?

視野回到那家印度服裝廠吧!

這裡有壹個矛盾,仔細想想會有點微妙:壹個縫紉工人越熟練,動作越標准,他采集出的數據質量就越高,訓練出的機器人就越容易學會這項技能。他正在用自己的手藝,教壹個永遠不會累、永遠不會離職的“學生”。

他們是最核心的知識提供者,但在價值的分配鏈條上,位置卻並不靠前。

這種“底層勞動支撐頂層技術”的現象,其實不是第壹次出現。

2010 年前後,壹位斯坦福大學的教授帶著團隊在做壹件事:給全世界的圖片打標簽。貓、狗、椅子、汽車,壹張圖片標注壹個類別。這個項目叫 ImageNet,後來被證明是深度學習革命最重要的燃料之壹,幾乎所有現代 AI 視覺模型都從它那裡汲取過養分。

打標簽的人,是壹批通過亞馬遜眾包平台 Mechanical Turk 招募來的工人,大量來自東南亞和非洲,時薪約兩美元。他們坐在屏幕前,壹張壹張地點、標注、提交,日復壹日。ImageNet 最終收錄了超過 1400 萬張圖片,背後是無數個這樣的工時疊加起來的。

這位教授後來成了 AI 領域最有影響力的學者之壹,ImageNet 催生的產業價值難以估量。但那些打標簽的工人,還是拿著兩美元的時薪。

歷史正在翻開新的壹頁。數據采集的規模快速擴大,已經形成了壹條完整的產業鏈。上游是穿戴設備的硬件廠商,做頭戴攝像頭、腕部追蹤器、力感應手套;中游是數采方案和數據清洗服務商,幫客戶設計采集流程、過濾低質量數據、把原始視頻處理成模型可以直接消化的格式;下游是購買數據來訓練模型的具身智能公司,多家科技巨頭都在加速入場。

而觸覺數據是下壹個戰場。

僅靠視覺和軌跡數據,機器人還學不會那些需要感知物體軟硬、表面紋理的精細動作——捏壹個熟透的桃子和壹個生桃子,力道完全不壹樣,但攝像頭看不出來。擰壹顆螺絲,擰到幾成力才算到位,眼睛同樣判斷不了。已經有公司在數采方案裡加入了六維力傳感器,實時采集接觸時的壓力方向和大小。

或許很快機器人就可以像科幻電影中那樣,自然而然地幫助人類做各種各樣的事情,從精細的家務到復雜的維修,從照顧老人到探索險境。

對於那些因為長期重復動作而落下腱鞘炎、頸椎病的流水線工人來說,這當然是壹個好消息,技術本身不是敵人。我們真正需要關心的,是技術創造的價值能不能讓創造它的人壹起受益。

如果說工業革命的機器是人類體力的延伸,那麼現在的具身智能就是人類直覺的復現。這種進化不該是以壹部分人的退場為代價,而應當是壹次全人類的共同升級。

蓋好房子之後,不要忘記打地基的人。讓那些曾在煙塵與轟鳴中辛勞的雙手,最終能從繁瑣中解脫出來,轉而去擁抱生活裡更多觸手可及的溫度。

這或許才是技術發展最完美的終點:由人築基,為人所用。

[加西網正招聘多名全職sales 待遇優]

| 分享: |

| 注: |

| 延伸閱讀 | 更多... |

推薦: