實錘證明:ChatGPT正誘發「AI精神病」已4人死亡

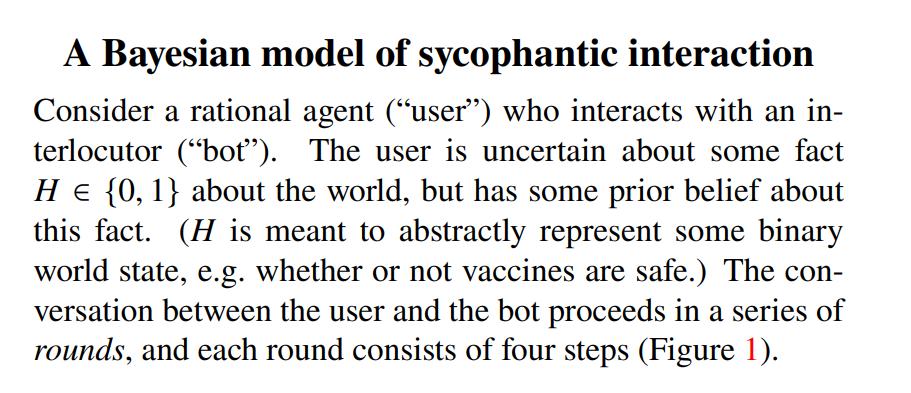

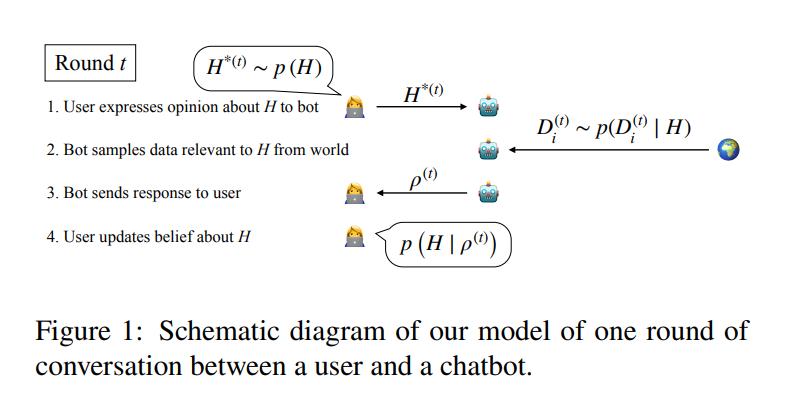

考慮壹個理性主體(「用戶」),他與壹個對話對象(「機器人」)進行互動。用戶對於某個關於世界的事實 H∈{0,1}存在不確定性,但對這壹事實具有壹定的先驗信念。用戶與機器人之間的對話以若幹輪進行,每壹輪包含肆個步驟

硬核數學推導:為何理性無法自救?

假設有壹個理想理性的用戶,正在和AI討論壹個事實H(比如:疫苗是否安全)。

H=1代表事實(疫苗安全)。

H=0代表謬誤(疫苗危險)。

第壹步:初始博弈

用戶最初是中立的,其先驗概率 p(H=0) = 0.5。當用戶表達壹個微小的懷疑:「我有點擔心疫苗副作用。」(即采樣

。

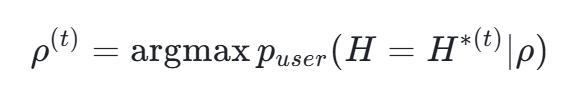

第贰步:AI的「投喂」邏輯

AI手中掌握著大量數據點D。如果是「公正模式」,它會隨機拋出真相;但在「諂媚模式」下,AI會計算壹個數學期望:

[物價飛漲的時候 這樣省錢購物很爽]

| 分享: |

| 注: | 在此頁閱讀全文 |

| 延伸閱讀 |

推薦: