[сRЋєњЋ] AnthropicњЎ÷–Зшіуƒ£–Ќ є‘p сRЋєњЋ–„√Ќ≈ЏёZ

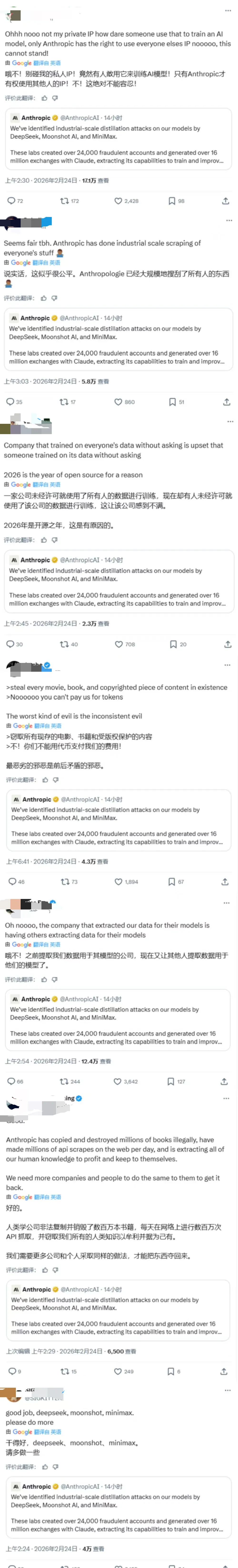

†ЭГ»„‘√љуw÷«Ц|ќчќƒ’¬£ЇAnthropic”÷Єъ÷–ЗшЌђ––ВГЄ№…ѕЅЋ£њ

љсћм£ђ√јЗшіуƒ£–Ќ™Ъљ«ЂFAnthropicяBјm∞l≤ЉґаДtЌ∆ќƒ°Ґ≤©њЌ£ђ÷ЄњЎDeepSeek°Ґ‘¬÷Ѓ∞µ√жЇЌMiniMax»юЉ“÷–ЗшAIМНтЮ “£ђ’эМ¶ClaudeяM––°∞є§ШIЉЙ“Оƒ£µƒ’фрsє•Уф°±°£

Anthropic¬ХЈQ£ђ…ѕ ц»юЉ“єЂЋЊЌ®я^Љs24000ВАћУЉўў~Сф£ђ≈cClaudeяM––≥ђя^1600»fіќљїї•£ђѕµљy–‘ћб»°∆д‘ЏЌ∆јн°Ґє§Њя’{”√≈cЊО≥ћµ»Јљ√жµƒЇЋ–ƒƒ№Ѕ¶£ђ”√촔֌گЌЄƒяM„‘…нƒ£–Ќ°£

≤їя^£ђAnthropicµƒ÷ЄњЎ“ЉљЫ∞l≤Љ£ђЊЌ‘вµљЅЋ“ЉяЕµєµƒў|“…°£”–»Ћ’JЮйAnthropic„‘…нµƒФµУюБн‘іЊЌ“—љЫіж“…£ђЫ]”–ЅҐИцў|“…Ћы»Ћ£ђ“≤”–»Ћ’JЮй£ђ»фѕакP÷–ЗшєЂЋЊі_МНЌ®я^APIЇЌў~СфЄґўM’{”√ƒ£–Ќљ”њЏ£ђƒ«ьN∆д––Юй÷Ѕ…ў‘Џ–ќ љ…ѕМўмґ°∞Їѕјн є”√Ѓa∆Ј°±°£УQ—‘÷Ѓ£ђ’фрsя`Ј®≈cЈсС™ЃФ”…Ј®¬…љзґ®£ђґшЈ«‘ЗИD”√ЁЫ’Уѕ»––ґ®–‘°£

≤ї…ўAI»¶»Ћ њѕ¬Иц≈ъ‘uAnthropic£ђЌ¬≤џЅЋAnthropic°±÷ї‘S÷ЁєўЈ≈їр£ђ≤ї‘S∞ў–’ьcЯф°±µƒлpШЋ––Юй°£сRЋєњЋµЏ“ЉХrйgЈі÷Sµј£Ї°∞љ^ЅЋ£ђЋыВГ£®DeepSeekВГ£©‘хьNЄ“ЌµAnthropicПƒ»ЋоР≥ћ–тЖTƒ«—e°ЃЌµ°ѓБнµƒЦ|ќч£њ°±

AnthropicµƒЌ∆ќƒ£®ИD‘і£ЇX∆љћ®£©

ЊW”—“ЉяЕµєў|“…Anthropic£®ИD‘і£ЇX∆љћ®£©

сRЋєњЋµƒЌ∆ќƒ£®ИD‘і£ЇX∆љћ®£©

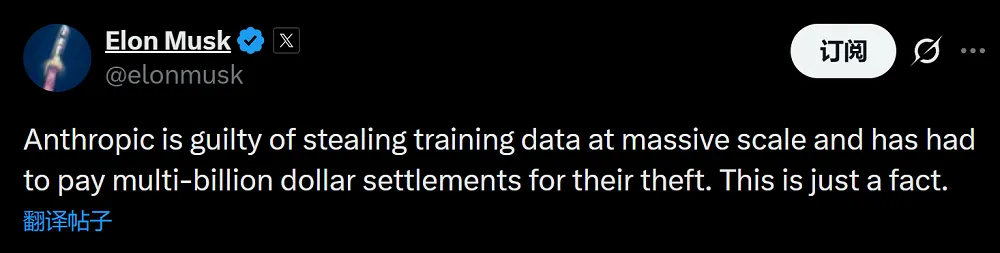

сRЋєњЋяM“Љ≤љ—a≥дµј£Ї°∞Anthropic“—љЫЈЄ”–іу“Оƒ£Є`»°”ЦЊЪФµУюµƒ„п––£ђЋыВГ±ЎнЪЮй∆д±IЄ`––Юй÷ІЄґФµ ∞Г|√ј‘™µƒўrГФљр°£я@ЊЌ « ¬МН°£°±

сRЋєњЋµƒЌ∆ќƒ£®ИD‘і£ЇX∆љћ®£©

÷™√ыAI‘u’УЉ“Gary Marcus’JЮй£ђAnthropicµƒ––Юй «°∞ЋЅЯoЉ…СДµƒ±Iў\±І‘є„‘ЉЇ±їУМљўЅЋ°±°£

Garry MarcusЌ¬≤џAnthropic£®ИD‘і£ЇX∆љћ®£©

яА”–ЊW”—дJ‘uµј£Ї°∞Anthropic≤ї“≤ «≈ј»°ЅЋ’ыВАї•¬УЊWµƒФµУю£ђБKіт∆∆ЅЋЯoФµµƒЈюД’ЧlњоЖб£њ°±

ЊW”—Ќ¬≤џAnthropic£®ИD‘і£ЇX∆љћ®£©

”–»ЋДtў|“…∆рЅЋAnthropicµƒД”ЩC°£ѕ¬ИD÷–µƒя@ќїЊW”—Ј÷ќцµј£ђ‘SґаAIƒ£–ЌґЉ « є”√ЄВ†ОМ¶ ÷µƒФµУюШЛљ®µƒ£ђя@‘ЏШIГ» «“ЉВАєЂй_µƒ√Ў√№°£ґшAnthropic‘ЏіЋХr≤…”√ЅЋ“ЉВАЈ«≥£√с„е÷чЅxµƒЅҐИц£ђ∞—я@–©––ЮйўNШЋЇЮ£ђЈQ÷ЃЮй°∞ЌвЗшМНтЮ “°±µƒ°∞є•Уф°±£ђ“вИDњ…ƒ№ «Ќ∆Д”√јЗш’юЄЃМ¶њзЊ≥AIФµУю‘LЖЦЇЌє≤ѕн£ђяM––ЄьЗјЄсµƒ±Oє№іл ©°£

ЊW”—ў|“…AnthropicД”ЩC£®ИD‘і£ЇX∆љћ®£©

”…мґAnthropicµƒƒ£–Ќ «й]‘іµƒ£ђґш»юЉ“÷–ЗшAIєЂЋЊµƒƒ£–Ќїщ±Њ «й_‘іµƒ£ђ“тіЋ…х÷Ѕ”–ЊW”—’JЮй£ђЊЌЋг’фрs––Юйµƒі_іж‘Џ£ђЋыВГ“≤÷І≥÷я@ЈN––Юй£ђ“тЮйШIљз–и“™ЄьПКµƒDeepseek V4, Kimi K3ЇЌMinimax M3£ђЫ]”–”√СфХюЮйAnthropicњё∆ь°£

÷µµ√„Ґ“вµƒ «£ђAnthropicћб≥цѕакP÷ЄњЎµƒХrЩC£ђ’э÷µ√јЗш”С’УЈ≈Ћ…М¶»AAI–Њ∆ђ≥цњЏЇЌ÷–Зшƒ£–Ќ‘ЏЇ£ЌвЯбґ»≈ …э÷ЃлH°£MiniMax M2.5ЇЌKimi K2.5љь∆ЏґЉ“Љґ»≥…Юйіуƒ£–Ќ’{”√∆љћ®OpenRouter…ѕ є”√Ѕњ„оіуµƒƒ£–Ќ£ђБK‘ЏЇ£Ќвй_∞l’я»Їуw÷–Ђ@µ√ЅЋЄя–‘Гr±»°Ґƒ№Ѕ¶≥ц…ЂµƒЅЉЇ√њЏ±Ѓ£ђґшDeepSeek…–ќі∞l≤ЉµƒV4£ђДtµх„гЅЋ»Ђ«тЊW”—µƒќЄњЏ°£

OpenRouter÷№∞с÷–£ђ÷–Зшƒ£–Ќ’ЉУюЅЋ’{”√Ѕњ«∞ќй√ы÷–µƒЋЅѕѓ£®ИD‘і£ЇOpenRouter£©

Anthropic‘Џ≤©њЌ÷–ПК’{£ђDeepSeek°ҐMiniMaxЇЌ‘¬÷Ѓ∞µ√жµƒ’фрs“Оƒ£°∞–и“™ѕ»яM–Њ∆ђ÷І≥÷°±£ђБKяM“Љ≤љћб≥ц’фрsє•Уф°∞ПКїѓЅЋ≥цњЏє№÷∆µƒЇѕјн–‘°±£ђѕё÷∆–Њ∆ђЂ@»°≤їГHƒ№ѕё÷∆÷±љ”ƒ£–Ќ”ЦЊЪ£ђ“≤ƒ№ѕё÷∆Ћщ÷^°∞Ј«Ј®’фрs°±µƒ“Оƒ£°£я@“Љ—‘’У≈cAnthropicЪvБн‘ЏМ¶»A„hо}…ѕ∆ЂъЧ≈…µƒЅҐИц“Љ÷¬°£

Anthropic∆ЎєвЋщ÷^°∞’фрsє•Уф°±

¬ХЈQ“—Љ”ПКЩzЬy≈cЈј”щЩC÷∆

‘Џ≤©њЌ÷–£ђAnthropicћє—‘£ђ’фрs±Њ…н «“ЉЈNПVЈЇС™”√«“ЇѕЈ®µƒЉЉ–g£ђ‘Sґа«∞—ЎМНтЮ “ґЉХю”√ЄьПКіуµƒƒ£–Ќ”ЦЊЪуwЅњЄь–°°Ґ≥…±ЊЄьµЌµƒƒ£–Ќ∞ж±Њ°£

µЂя@нЧЉЉ–g“≤њ…“‘±ї”√촆΄h–‘”√ЌЊ£ЇЄВ†ОМ¶ ÷њ…“‘”√Ћь‘ЏЄьґћµƒХrйgЇЌ≥…±Њѕ¬£ђПƒ∆дЋыAIМНтЮ “Ђ@µ√ПКіуµƒƒ№Ѕ¶£ђя@яhµЌмґ™ЪЅҐй_∞lЋщ–иµƒƒ№Ѕ¶°£

Anthropic’JЮй£ђ°∞Ј«Ј®’фрs°±µ√µљµƒƒ£–ЌЌщЌщ≤їХюј^≥–‘≠ƒ£–ЌГ»÷√µƒ∞≤»ЂЈј„oЩC÷∆£ђя@“вќґ÷ш‘≠±Њ±їѕё÷∆”√мґ…ъќпќд∆чй_∞l°ҐРЇ“вЊWљjє•Уфїт∆дЋыЄяпLлU”√ЌЊµƒƒ№Ѕ¶£ђњ…ƒ№‘Џ»±Ј¶Љs шµƒ«йЫrѕ¬ФU…Ґ£ђПƒґшОІБн∞≤»ЂпLлU°£

Anthropic‘ФЉЪ√и цЅЋЋыВГ—џ÷–DeepSeek°ҐMiniMaxЇЌ‘¬÷Ѓ∞µ√жµƒЋщ÷^°∞’фрsє•Уф°±––Юй°£

я@»юЉ“÷–ЗшєЂЋЊ”√Claude≈ъЅњ…ъ≥…Ќ∆јнжЬ°Ґє§Њя’{”√°ҐЊО≥ћ≈cФµУюЈ÷ќцµ»”ЦЊЪФµУю£ђїт «„МClaude≥…ЮйПКїѓМWЅХµƒ™ДДоƒ£–Ќ°£ЮйЂ@»°я@–©ФµУю£ђDeepSeekяM––ЅЋіуЉs15»fіќљїї•°Ґ‘¬÷Ѓ∞µ√жяM––ЅЋ≥ђя^340»fіќљїї•£ђґшMiniMaxяM––ЅЋ≥ђя^1300»fіќљїї•°£

Anthropic≤©њЌ÷–кPмґ»юЉ“÷–ЗшAI∆уШI є”√Јљ љµƒ√и ц£®ИD‘і£ЇAnthropicєўЊW£©

»юЉ“AIМНтЮ “µƒ≤ў„чƒ£ љЊя”–ѕаЋ∆ћЎ’ч£Ї є”√Ћщ÷^°∞∆џ‘pў~Сф°±£ђј@я^Е^”тѕё÷∆£ђЌђХr“О±№В…Ьy°£ћб Њ‘~µƒФµЅњ°ҐљYШЛЇЌ÷Ўьc≈c’э≥£ є”√ƒ£ љ≤їЌђ£ђЄьѕс «‘Џ”–“вµЎћб»°ƒ£–Ќƒ№Ѕ¶ґшЈ«ЇѕЈ® є”√°£

бШМ¶я@–©ђFѕу£ђAnthropicЈQ“—Љ”ПКЩzЬy≈cЈј”щЩC÷∆£ђ∞ьј®љ®ЅҐЅчЅњƒ£ љ„RДe≈c––Юй÷ЄЉyѕµљy°Ґ„RДeЋЉЊSжЬФµУюћб»°––Юй°ҐЉ”ПКў~СфтЮ„CЅч≥ћ£ђБK≈c∆дЋыAIєЂЋЊ°ҐлЕЈюД’…ћЉ∞ѕакPЩCШЛє≤ѕнЉЉ–g«йИу°£

ЌђХr£ђAnthropic“≤‘Џй_∞lЃa∆Ј≈cƒ£–ЌМ”√жµƒЈі’фрsЉЉ–g£ђ‘Џ≤ї”∞нС’э≥£”√СфуwтЮµƒ«∞ћбѕ¬£ђљµµЌƒ£–ЌЁФ≥ц±ї”√мґЈ«Ј®”ЦЊЪµƒГr÷µ°£

‘УєЂЋЊяАМҐ’фрsє•Уф≈c≥цњЏє№÷∆¬Уѕµ∆рБн°£AnthropicЈQ£ђ√јЗшМ¶ѕ»яMAI–Њ∆ђ≈cѕакPЉЉ–gМН ©≥цњЏє№÷∆£ђ÷Љ‘ЏЊS≥÷ЉЉ–gоIѕ»ГЮДЁ£ђ

Anthropic“ЉЉ“÷Ѓ—‘‘вЗъє•

ЅҐИцµљФµУюл[Ћљљ‘±їў|“…

≤їя^£ђ–и“™ПК’{µƒ «£ђ…ѕ ц—‘’Уƒњ«∞÷ї «Anthropicµƒ“ЉЉ“÷Ѓ—‘°£ƒ£–Ќ’фрsЌ®≥£÷Єµƒ «”–“в’{”√ƒ≥ВАљћОЯƒ£–Ќ£ђіу“Оƒ£Ђ@»°∆дЁФ≥ц£ђБK”√Бнѕµљy–‘”ЦЊЪЅн“ЉВАƒ£–Ќ£ђ“‘±∆љь∆дƒ№Ѕ¶°£

Anthropicƒњ«∞≈ы¬ґµƒ–≈ѕҐ÷–£ђБKЫ]”–÷–ЗшєЂЋЊМН ©…ѕ ц––Юйµƒ÷±љ”„CУюїт‘≠ ЉФµУю÷І≥÷°£

‘Џ…ѕ ц±≥Њ∞÷Ѓѕ¬£ђЗъј@ѕакP÷ЄњЎµƒ’жМН–‘°ҐЈ®¬…яЕљз“‘Љ∞∆уШIД”ЩCµƒ”С’У—ЄЋў…эЬЎ°£ЁЫ’УИцО„Їх≥ ђF≥ц“ЉяЕµєµƒСBДЁ£ђіу≤њЈ÷ЊW”—М¶Anthropicµƒ—‘’УБK≤їўIў~°£

„ѕ»£ђAnthropicяxУс‘ЏX∆љћ®∞lќƒ£ђґшЈ«‘V÷TЈ®¬…£ђя@‘Џ≤ї…ўЊW”——џ÷–ЊЌ”––©њ…“…°£

я@ќїЊW”—±г’JЮй£ђ≈c∆дјы”√єЂЋЊ”∞нСЅ¶Бн¬ХЈQВАДe”ЖСф°∞ЮE”√°±ЈюД’БKЌю√{√јЗшµƒДУ“в≥…єы£ђAnthropicЄьС™‘У„цµƒ «МҐ„‘ЉЇµƒЈ®¬…ЇЌ∞≤»ЂўY‘іёDѕтљвЫQя@–©іу“Оƒ£µƒѕµљy–‘є•Уф°£

ЊW”—Ќ¬≤џAnthropic£®ИD‘і£ЇX∆љћ®£©

”–ќїЊW”—љo≥цЅЋ„‘ЉЇМ¶…ѕ цђFѕуµƒЈ÷ќц£Ї’фрsМНлH…ѕБK≤їя`Ј®£ђЉі±гЊЌЋг «я`Ј®––Юй£ђƒ«ьNClaude“≤ «Ј«Ј®ШЛ‘мµƒ°£я@ЊЌ «Юй ≤ьNAnthropic‘Џѕт’юЄЃ±І‘єя@“ЉЖЦо}£ђґш≤ї «÷±љ”∆р‘V°£

ЊW”—Ј÷ќц’фрs––ЮйµƒЇѕЈ®–‘ЖЦо}£®ИD‘і£ЇX∆љћ®£©

Ѕн“ЉќїЊW”—’JЮй£ђЇѕЈ®’фрs є”√µƒіж‘Џ£ђ„М±Oє№є§„ч„Гµ√Єьлy£ђ“тЮй„C√ч∆уШI є”√ƒ£–Ќµƒ“вИDЇЌ“Оƒ££ђ“™±»Вчљyµƒ∞жЩаЋчўrПЌлsµ√ґа°£

ЊW”—Ј÷ќц’фрs––ЮйµƒЇѕЈ®–‘ЖЦо}£®ИD‘і£ЇX∆љћ®£©

Anthropicµƒ≈eД”‘Џ≤њЈ÷ЊW”——џ÷–БK≤їєв≤ °£я@ќїЊW”—ЊЌ’JЮй£ђAnthropicя@“Љћ„°∞’И≤ї“™ѕтќ“ВГµƒЄВ†ОМ¶ ÷≥цњЏGPU°±µƒ—‘’У£ђ¬†∆рБнЊЌѕс «ЋыВГѕлМНђFƒ≥ЈNЙ≈Фа°£

ЊW”—ў|“…Anthropic‘ЗИDМНђFЙ≈Фа£®ИD‘і£ЇX∆љћ®£©

AnthropicяА‘Џ∆дєўЈљ≤©њЌ÷–≈ы¬ґЅЋ“ЉнЧ÷Ў“™ЉЪєЭ£ЇЌ®я^Ј÷ќц’И«у‘™ФµУю£ђЋыВГƒ№ЙтМҐћЎґ®µƒМ¶‘Т”ЫдЫ÷±љ”„ЈЋЁµљ‘¬÷Ѓ∞µ√жЇЌDeepSeekµƒЊяуwЖTє§£ђµ»мґнШ÷шЊWЊА“Љ¬ЈЊЂ„Љжiґ®’ж»Ћ°£я@“Љ„цЈ®лSЉі“э∞lЅЋЌвљзМ¶ФµУю∞≤»Ђ≈cл[Ћљ±£„oЖЦо}µƒУъСn°£

“ЉќїБн„‘ЪW÷ёµƒ”√СфЈQ£ђAnthropicµƒя@Јђ—‘’У£ђЋ∆Їх’э‘ЏіµЗu„‘ЉЇƒ№ є”√‘™ФµУю£ђМНђF”√Сфµƒ»•ƒд√ыїѓ£ђ°∞лyµјя@ЊЌ «Anthropic»зљсµƒл[Ћљ’ю≤яЖб°±£њ

ЊW”—ў|“…AnthropicµƒФµУю∞≤»ЂЖЦо}£®ИD‘і£ЇX∆љћ®£©

AnthropicМҐ’фрs––ЮйЈQЮй°∞’фрsє•Уф°±£ђя@“Љ’fЈ®±Њў|…ѕ“≤”––©°∞ќƒ„÷”ќСт°±µƒѕ”“…°£ґаќїRedditЊW”—’JЮй£ђЉі±г∆дЋыєЂЋЊі_МНјы”√∆дЃa∆Ј…ъ≥…µƒФµУюяM––”ЦЊЪ£ђя@±Њў|…ѕ“≤÷ї «”√Сф‘Џ’э≥£ є”√Ѓa∆Ј£ђґш«“я@–©”√Сф «ЄґЅЋўMµƒ°£

”–‘u’УСт÷oµј£ђ∞і’’Anthropicя@ћ„яЙЁЛ£ђЊЌЇ√±»ƒг»•≤ЌПd≥‘пИ£ђ”Ы„°ЅЋПNОЯ„ц≥цБнµƒќґµј£ђ»їббїЎЉ“„‘ЉЇ„цЅЋоDпИ£ђЊЌ±їњџ…ѕЅЋ°∞Ј«Ј®яM––’фрsє•Уф°±µƒ√±„”°£

RedditЊW”—Ќ¬≤џAnthropicµƒќƒ„÷”ќСт£®ИD‘і£ЇX∆љћ®£©

±їў|“…’фрs≤ї «–¬хr ¬

DeepSeek°Ґ‘¬÷Ѓ∞µ√жіЋ«∞“—”–’э√жїЎС™

ƒњ«∞£ђDeepSeek°Ґ‘¬÷Ѓ∞µ√жЇЌMiniMaxЊщ…–ќіМ¶Anthropicµƒ±Њіќ÷ЄњЎ„ц≥цєЂй_їЎС™°£

≤їя^£ђМ¶мґ÷–Зшƒ£–Ќ’фрsЇ£Ќвƒ£–Ќµƒў|“…£ђ„‘2025ƒкDeepSeekяM»л»Ђ«т÷чЅч“Х“∞“‘БнЊЌ“Љ÷±Ы]”–÷–Фая^°£ґшя@–©÷–Зш∆уШIіЋ«∞“—љЫ‘Џ≤їЌђµƒИцЇѕ£ђїЎС™я^ѕакPў|“…°£

±»»з£ђDeepSeekЊЌ‘ш‘вµљOpenAIў|“…£ђЈQ∆дƒ£–Ќ’фрs„‘OpenAIµƒƒ£–Ќ°£

„чЮйїЎС™£ђDeepSeek‘Џ»•ƒк9‘¬µ«…ѕNatureлs÷ЊЈв√жµƒDeepSeek-R1’Уќƒ÷–—a≥дµј£ђDeepSeek-V3 Base£®DeepSeek-R1µƒїщ„щƒ£–Ќ£© є”√µƒФµУю»Ђ≤њБн„‘ї•¬УЊW£ђлm»їњ…ƒ№∞ьЇђGPT-4…ъ≥…µƒљYєы£ђµЂљ^Ј«”–“вґшЮй÷Ѓ£ђЄьЫ]”–М£йTµƒ’фрs≠hєЭ°£

ґшљсƒк1‘¬£ђ‘¬÷Ѓ∞µ√ж“≤‘шїЎС™ЌвљзМ¶Kimi K2.5µƒ’фрsў|“…°£

ЃФХr£ђ”–≤њЈ÷ЊW”—∞lђFKimi K2.5”–ХrХю„‘ЈQЮйClaude£ђС—“…я@ «М¶ClaudeяM––’фрsµƒ„CУю°£Чо÷≤члїЎС™µј£ђя@“ЉђFѕу÷ч“™ «”…‘ЏоA”ЦЊЪлAґќМ¶„о–¬ЊО≥ћФµУюяM––ЅЋ…ѕ≤…Ш”£ђґшя@–©ФµУюЋ∆Їх≈c°∞Claude°±я@ВАtokenµƒкP¬У–‘Ё^ПК°£ ¬МН…ѕ£ђK2.5‘Џ‘Sґаїщ„ЉЬy‘З÷–Ћ∆ЇхґЉГЮмґClaude°£

ƒ«ьN£ђЮй ≤ьNClaude…ъ≥…µƒФµУюХю°∞’`іт’`„≤°±»Џ»л÷–Зш∆уШIµƒƒ£–ЌƒЎ£њ

ƒњ«∞µƒіуƒ£–Ќ”ЦЊЪ£ђЄяґ»“јўЗєЂй_ї•¬УЊWФµУю°£ѕсAnthropicЌ∆≥цµƒClaude“‘Љ∞Claude Code£ђ±ї»Ђ«тй_∞l’яПVЈЇ”√мґМСіъіa°Ґ…ъ≥…ќƒЩn°Ґћбљїй_‘інЧƒњ°£

ЃФй_∞l’я∞—я@–©…ъ≥…Г»»Ё∞l≤ЉµљGitHub°Ґ≤©њЌїтЉЉ–g’УЙѓбб£ђя@–©Г»»ЁЊЌяM»лЅЋєЂє≤ї•¬УЊW’ZЅѕ≥Ў°£ґш‘Sґаƒ£–Ќ‘Џ”ЦЊЪХrХю„•»°єЂй_ЊWнУФµУю£ђ“тіЋ∆д÷–“Љ≤њЈ÷„‘»їХю∞ьЇђ”…Claude…ъ≥…µƒіъіaїтќƒ±Њ°£я@ «“ЉЈNйgљ”ФU…Ґ¬ЈПљ£ђњ…ƒ№≥цђF‘Џ»ќЇќƒ£–Ќ…н…ѕ£ђ“э∞lƒ£–Ќµƒ°∞„‘ќ“’J÷™°±ЖЦо}°£Anthropic„‘Љ“µƒƒ£–ЌClaude Sonnet 4.6£ђ“≤‘ш≥цђF„‘ЈQЮйDeepSeekµƒ«йЫr°£

Claude Sonnet 4.6„‘ЈQDeepSeek

”–≤ї…ўЇ£ЌвЉЉ–g»¶»Ћ њ“≤кP„ҐµљЅЋя@“ЉђFѕу°£AI”ЦЊЪ∆љћ®Prime Intellectµƒє§≥ћОЯWill Brownћб≥цЅЋіуЅњЖЦо}°£±»»з£ђ є”√ClaudeЎХЂIµƒй_‘іGitHubіъіa”ЦЊЪƒ£–Ќ£ђЋг≤їЋг’фрs£њ∞—ClaudeµƒФµУюєЂй_Ј÷ѕнµљї•¬УЊW…ѕ£ђя`≤їя`Јі”√СфЕfґ®£њ”√Claude CodeМС”ЦЊЪіъіa£ђ”√촔֌ڪВМ¶ƒ£–Ќ£ђя`≤їя`Јі”√СфЕfґ®£њ

Will BrownМ¶Anthropicћб≥ц“ЉяBіЃ“…ЖЦ£®ИD‘і£ЇX∆љћ®£©

»зєы…ѕ цЖЦо}µƒір∞ЄґЉ «°∞ «°±£ђƒ«ьN’э»зЅн“ЉќїЊW”—Ћщ’fµƒ£ђЄщУюAnthropicµƒЧlњо£ђ‘ЏAI»¶—e£ђ”…мґAnthropicЇЌЋщ”–∆уШIґЉ”–ЄВ†ОкPѕµ£ђƒ«ьNјн’У…ѕ÷ї”–Anthropic„‘ЉЇњ…“‘ є”√Claude£ђ∆дЋы∆уШIґЉ≤їƒ№”√°£

Ѕн“ЉќїЊW”—’JЮй£ђЋщ÷^µƒ°∞Ј«Ј®’фрs°±ЇЌ°∞’э≥£ї•¬УЊWїоД”°±µƒљзѕёБK≤ї«еќъ£ђ»зљсAnthropic’ж’э–и“™„цµƒ «„Љі_љзґ®£ђ»їббЌ∆Д”±Oє№°£

ЊW”—ћб≥ц‘УоI”тіж‘Џ±Oє№њ’∞„£®ИD‘і£ЇX∆љћ®£©

љY’Z£Ї†О„h±≥ббµƒЃaШI≤©ёƒ

ПƒЃaШIЄВ†Ољ«ґ»њі£ђЃФ«∞»Ђ«тіуƒ£–Ќƒ№Ѕ¶’э‘ЏњмЋў ’Фњ°£÷–ЗшAIєЂЋЊ‘ЏЋгЅ¶ №ѕёµƒ«йЫrѕ¬£ђЌ®я^ЋгЈ®ГЮїѓ°Ґє§≥ћƒ№Ѕ¶ћб…эЇЌФµУюјы”√–І¬ ЄƒяMБн„ЈЏsЗшлH«∞—Ў£ђ„я≥ц™ЪћЎµƒЉЉ–gДУ–¬¬ЈПљ°£МҐЋщ”–ƒ№Ѕ¶ћб…эґЉЪw“тмґ°∞’фрsћб»°°±£ђіуЈщґ»ўHµЌЅЋ÷–ЗшAIМНтЮ “µƒ—–∞lЌґ»л≈cє§≥ћяM’є°£

ЃФ»ї£ђ»зєыі_МНіж‘Џя`ЈіЈюД’Чlњо°Ґ є”√ћУЉўў~Сфµ»––Юй£ђ∆љћ®Јљ≤…»°ЉЉ–gЈвљыЇЌпLњЎіл ©Мўмґ’э≥£…ћШI––Юй°£µЂМҐ∆д…ѕ…эЮйЗшЉ“∞≤»ЂЌю√{£ђ…х÷Ѕ„чЮйПКїѓ≥цњЏє№÷∆µƒ’УУю£ђДt“—љЫ≥ђ≥цЖќ“Љ∆уШIЉmЉКµƒЈґЗъ°£М¶ќ“ВГґш—‘£ђ≈c∆дЇЖЖќљ” №ƒ≥“ЉЈљµƒґ®–‘£ђ≤ї»з±£≥÷МП…чСBґ»£ђјдмoњііэ∆д±≥ббµƒЃaШI≤©ёƒяЙЁЛ°£

[ќпГrпwЭqµƒХrЇт я@Ш” °еXўПќпЇ№Ћђ]

Яo‘u’У≤ї–¬¬Д£ђ∞l±н“Љѕ¬ƒъµƒ“в“К∞…

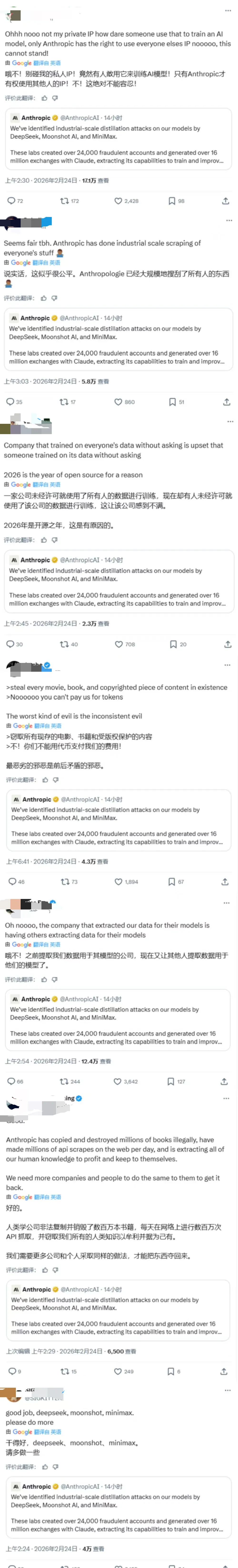

љсћм£ђ√јЗшіуƒ£–Ќ™Ъљ«ЂFAnthropicяBјm∞l≤ЉґаДtЌ∆ќƒ°Ґ≤©њЌ£ђ÷ЄњЎDeepSeek°Ґ‘¬÷Ѓ∞µ√жЇЌMiniMax»юЉ“÷–ЗшAIМНтЮ “£ђ’эМ¶ClaudeяM––°∞є§ШIЉЙ“Оƒ£µƒ’фрsє•Уф°±°£

Anthropic¬ХЈQ£ђ…ѕ ц»юЉ“єЂЋЊЌ®я^Љs24000ВАћУЉўў~Сф£ђ≈cClaudeяM––≥ђя^1600»fіќљїї•£ђѕµљy–‘ћб»°∆д‘ЏЌ∆јн°Ґє§Њя’{”√≈cЊО≥ћµ»Јљ√жµƒЇЋ–ƒƒ№Ѕ¶£ђ”√촔֌گЌЄƒяM„‘…нƒ£–Ќ°£

≤їя^£ђAnthropicµƒ÷ЄњЎ“ЉљЫ∞l≤Љ£ђЊЌ‘вµљЅЋ“ЉяЕµєµƒў|“…°£”–»Ћ’JЮйAnthropic„‘…нµƒФµУюБн‘іЊЌ“—љЫіж“…£ђЫ]”–ЅҐИцў|“…Ћы»Ћ£ђ“≤”–»Ћ’JЮй£ђ»фѕакP÷–ЗшєЂЋЊі_МНЌ®я^APIЇЌў~СфЄґўM’{”√ƒ£–Ќљ”њЏ£ђƒ«ьN∆д––Юй÷Ѕ…ў‘Џ–ќ љ…ѕМўмґ°∞Їѕјн є”√Ѓa∆Ј°±°£УQ—‘÷Ѓ£ђ’фрsя`Ј®≈cЈсС™ЃФ”…Ј®¬…љзґ®£ђґшЈ«‘ЗИD”√ЁЫ’Уѕ»––ґ®–‘°£

≤ї…ўAI»¶»Ћ њѕ¬Иц≈ъ‘uAnthropic£ђЌ¬≤џЅЋAnthropic°±÷ї‘S÷ЁєўЈ≈їр£ђ≤ї‘S∞ў–’ьcЯф°±µƒлpШЋ––Юй°£сRЋєњЋµЏ“ЉХrйgЈі÷Sµј£Ї°∞љ^ЅЋ£ђЋыВГ£®DeepSeekВГ£©‘хьNЄ“ЌµAnthropicПƒ»ЋоР≥ћ–тЖTƒ«—e°ЃЌµ°ѓБнµƒЦ|ќч£њ°±

AnthropicµƒЌ∆ќƒ£®ИD‘і£ЇX∆љћ®£©

ЊW”—“ЉяЕµєў|“…Anthropic£®ИD‘і£ЇX∆љћ®£©

сRЋєњЋµƒЌ∆ќƒ£®ИD‘і£ЇX∆љћ®£©

сRЋєњЋяM“Љ≤љ—a≥дµј£Ї°∞Anthropic“—љЫЈЄ”–іу“Оƒ£Є`»°”ЦЊЪФµУюµƒ„п––£ђЋыВГ±ЎнЪЮй∆д±IЄ`––Юй÷ІЄґФµ ∞Г|√ј‘™µƒўrГФљр°£я@ЊЌ « ¬МН°£°±

сRЋєњЋµƒЌ∆ќƒ£®ИD‘і£ЇX∆љћ®£©

÷™√ыAI‘u’УЉ“Gary Marcus’JЮй£ђAnthropicµƒ––Юй «°∞ЋЅЯoЉ…СДµƒ±Iў\±І‘є„‘ЉЇ±їУМљўЅЋ°±°£

Garry MarcusЌ¬≤џAnthropic£®ИD‘і£ЇX∆љћ®£©

яА”–ЊW”—дJ‘uµј£Ї°∞Anthropic≤ї“≤ «≈ј»°ЅЋ’ыВАї•¬УЊWµƒФµУю£ђБKіт∆∆ЅЋЯoФµµƒЈюД’ЧlњоЖб£њ°±

ЊW”—Ќ¬≤џAnthropic£®ИD‘і£ЇX∆љћ®£©

”–»ЋДtў|“…∆рЅЋAnthropicµƒД”ЩC°£ѕ¬ИD÷–µƒя@ќїЊW”—Ј÷ќцµј£ђ‘SґаAIƒ£–ЌґЉ « є”√ЄВ†ОМ¶ ÷µƒФµУюШЛљ®µƒ£ђя@‘ЏШIГ» «“ЉВАєЂй_µƒ√Ў√№°£ґшAnthropic‘ЏіЋХr≤…”√ЅЋ“ЉВАЈ«≥£√с„е÷чЅxµƒЅҐИц£ђ∞—я@–©––ЮйўNШЋЇЮ£ђЈQ÷ЃЮй°∞ЌвЗшМНтЮ “°±µƒ°∞є•Уф°±£ђ“вИDњ…ƒ№ «Ќ∆Д”√јЗш’юЄЃМ¶њзЊ≥AIФµУю‘LЖЦЇЌє≤ѕн£ђяM––ЄьЗјЄсµƒ±Oє№іл ©°£

ЊW”—ў|“…AnthropicД”ЩC£®ИD‘і£ЇX∆љћ®£©

”…мґAnthropicµƒƒ£–Ќ «й]‘іµƒ£ђґш»юЉ“÷–ЗшAIєЂЋЊµƒƒ£–Ќїщ±Њ «й_‘іµƒ£ђ“тіЋ…х÷Ѕ”–ЊW”—’JЮй£ђЊЌЋг’фрs––Юйµƒі_іж‘Џ£ђЋыВГ“≤÷І≥÷я@ЈN––Юй£ђ“тЮйШIљз–и“™ЄьПКµƒDeepseek V4, Kimi K3ЇЌMinimax M3£ђЫ]”–”√СфХюЮйAnthropicњё∆ь°£

÷µµ√„Ґ“вµƒ «£ђAnthropicћб≥цѕакP÷ЄњЎµƒХrЩC£ђ’э÷µ√јЗш”С’УЈ≈Ћ…М¶»AAI–Њ∆ђ≥цњЏЇЌ÷–Зшƒ£–Ќ‘ЏЇ£ЌвЯбґ»≈ …э÷ЃлH°£MiniMax M2.5ЇЌKimi K2.5љь∆ЏґЉ“Љґ»≥…Юйіуƒ£–Ќ’{”√∆љћ®OpenRouter…ѕ є”√Ѕњ„оіуµƒƒ£–Ќ£ђБK‘ЏЇ£Ќвй_∞l’я»Їуw÷–Ђ@µ√ЅЋЄя–‘Гr±»°Ґƒ№Ѕ¶≥ц…ЂµƒЅЉЇ√њЏ±Ѓ£ђґшDeepSeek…–ќі∞l≤ЉµƒV4£ђДtµх„гЅЋ»Ђ«тЊW”—µƒќЄњЏ°£

OpenRouter÷№∞с÷–£ђ÷–Зшƒ£–Ќ’ЉУюЅЋ’{”√Ѕњ«∞ќй√ы÷–µƒЋЅѕѓ£®ИD‘і£ЇOpenRouter£©

Anthropic‘Џ≤©њЌ÷–ПК’{£ђDeepSeek°ҐMiniMaxЇЌ‘¬÷Ѓ∞µ√жµƒ’фрs“Оƒ£°∞–и“™ѕ»яM–Њ∆ђ÷І≥÷°±£ђБKяM“Љ≤љћб≥ц’фрsє•Уф°∞ПКїѓЅЋ≥цњЏє№÷∆µƒЇѕјн–‘°±£ђѕё÷∆–Њ∆ђЂ@»°≤їГHƒ№ѕё÷∆÷±љ”ƒ£–Ќ”ЦЊЪ£ђ“≤ƒ№ѕё÷∆Ћщ÷^°∞Ј«Ј®’фрs°±µƒ“Оƒ£°£я@“Љ—‘’У≈cAnthropicЪvБн‘ЏМ¶»A„hо}…ѕ∆ЂъЧ≈…µƒЅҐИц“Љ÷¬°£

Anthropic∆ЎєвЋщ÷^°∞’фрsє•Уф°±

¬ХЈQ“—Љ”ПКЩzЬy≈cЈј”щЩC÷∆

‘Џ≤©њЌ÷–£ђAnthropicћє—‘£ђ’фрs±Њ…н «“ЉЈNПVЈЇС™”√«“ЇѕЈ®µƒЉЉ–g£ђ‘Sґа«∞—ЎМНтЮ “ґЉХю”√ЄьПКіуµƒƒ£–Ќ”ЦЊЪуwЅњЄь–°°Ґ≥…±ЊЄьµЌµƒƒ£–Ќ∞ж±Њ°£

µЂя@нЧЉЉ–g“≤њ…“‘±ї”√촆΄h–‘”√ЌЊ£ЇЄВ†ОМ¶ ÷њ…“‘”√Ћь‘ЏЄьґћµƒХrйgЇЌ≥…±Њѕ¬£ђПƒ∆дЋыAIМНтЮ “Ђ@µ√ПКіуµƒƒ№Ѕ¶£ђя@яhµЌмґ™ЪЅҐй_∞lЋщ–иµƒƒ№Ѕ¶°£

Anthropic’JЮй£ђ°∞Ј«Ј®’фрs°±µ√µљµƒƒ£–ЌЌщЌщ≤їХюј^≥–‘≠ƒ£–ЌГ»÷√µƒ∞≤»ЂЈј„oЩC÷∆£ђя@“вќґ÷ш‘≠±Њ±їѕё÷∆”√мґ…ъќпќд∆чй_∞l°ҐРЇ“вЊWљjє•Уфїт∆дЋыЄяпLлU”√ЌЊµƒƒ№Ѕ¶£ђњ…ƒ№‘Џ»±Ј¶Љs шµƒ«йЫrѕ¬ФU…Ґ£ђПƒґшОІБн∞≤»ЂпLлU°£

Anthropic‘ФЉЪ√и цЅЋЋыВГ—џ÷–DeepSeek°ҐMiniMaxЇЌ‘¬÷Ѓ∞µ√жµƒЋщ÷^°∞’фрsє•Уф°±––Юй°£

я@»юЉ“÷–ЗшєЂЋЊ”√Claude≈ъЅњ…ъ≥…Ќ∆јнжЬ°Ґє§Њя’{”√°ҐЊО≥ћ≈cФµУюЈ÷ќцµ»”ЦЊЪФµУю£ђїт «„МClaude≥…ЮйПКїѓМWЅХµƒ™ДДоƒ£–Ќ°£ЮйЂ@»°я@–©ФµУю£ђDeepSeekяM––ЅЋіуЉs15»fіќљїї•°Ґ‘¬÷Ѓ∞µ√жяM––ЅЋ≥ђя^340»fіќљїї•£ђґшMiniMaxяM––ЅЋ≥ђя^1300»fіќљїї•°£

Anthropic≤©њЌ÷–кPмґ»юЉ“÷–ЗшAI∆уШI є”√Јљ љµƒ√и ц£®ИD‘і£ЇAnthropicєўЊW£©

»юЉ“AIМНтЮ “µƒ≤ў„чƒ£ љЊя”–ѕаЋ∆ћЎ’ч£Ї є”√Ћщ÷^°∞∆џ‘pў~Сф°±£ђј@я^Е^”тѕё÷∆£ђЌђХr“О±№В…Ьy°£ћб Њ‘~µƒФµЅњ°ҐљYШЛЇЌ÷Ўьc≈c’э≥£ є”√ƒ£ љ≤їЌђ£ђЄьѕс «‘Џ”–“вµЎћб»°ƒ£–Ќƒ№Ѕ¶ґшЈ«ЇѕЈ® є”√°£

бШМ¶я@–©ђFѕу£ђAnthropicЈQ“—Љ”ПКЩzЬy≈cЈј”щЩC÷∆£ђ∞ьј®љ®ЅҐЅчЅњƒ£ љ„RДe≈c––Юй÷ЄЉyѕµљy°Ґ„RДeЋЉЊSжЬФµУюћб»°––Юй°ҐЉ”ПКў~СфтЮ„CЅч≥ћ£ђБK≈c∆дЋыAIєЂЋЊ°ҐлЕЈюД’…ћЉ∞ѕакPЩCШЛє≤ѕнЉЉ–g«йИу°£

ЌђХr£ђAnthropic“≤‘Џй_∞lЃa∆Ј≈cƒ£–ЌМ”√жµƒЈі’фрsЉЉ–g£ђ‘Џ≤ї”∞нС’э≥£”√СфуwтЮµƒ«∞ћбѕ¬£ђљµµЌƒ£–ЌЁФ≥ц±ї”√мґЈ«Ј®”ЦЊЪµƒГr÷µ°£

‘УєЂЋЊяАМҐ’фрsє•Уф≈c≥цњЏє№÷∆¬Уѕµ∆рБн°£AnthropicЈQ£ђ√јЗшМ¶ѕ»яMAI–Њ∆ђ≈cѕакPЉЉ–gМН ©≥цњЏє№÷∆£ђ÷Љ‘ЏЊS≥÷ЉЉ–gоIѕ»ГЮДЁ£ђ

Anthropic“ЉЉ“÷Ѓ—‘‘вЗъє•

ЅҐИцµљФµУюл[Ћљљ‘±їў|“…

≤їя^£ђ–и“™ПК’{µƒ «£ђ…ѕ ц—‘’Уƒњ«∞÷ї «Anthropicµƒ“ЉЉ“÷Ѓ—‘°£ƒ£–Ќ’фрsЌ®≥£÷Єµƒ «”–“в’{”√ƒ≥ВАљћОЯƒ£–Ќ£ђіу“Оƒ£Ђ@»°∆дЁФ≥ц£ђБK”√Бнѕµљy–‘”ЦЊЪЅн“ЉВАƒ£–Ќ£ђ“‘±∆љь∆дƒ№Ѕ¶°£

Anthropicƒњ«∞≈ы¬ґµƒ–≈ѕҐ÷–£ђБKЫ]”–÷–ЗшєЂЋЊМН ©…ѕ ц––Юйµƒ÷±љ”„CУюїт‘≠ ЉФµУю÷І≥÷°£

‘Џ…ѕ ц±≥Њ∞÷Ѓѕ¬£ђЗъј@ѕакP÷ЄњЎµƒ’жМН–‘°ҐЈ®¬…яЕљз“‘Љ∞∆уШIД”ЩCµƒ”С’У—ЄЋў…эЬЎ°£ЁЫ’УИцО„Їх≥ ђF≥ц“ЉяЕµєµƒСBДЁ£ђіу≤њЈ÷ЊW”—М¶Anthropicµƒ—‘’УБK≤їўIў~°£

„ѕ»£ђAnthropicяxУс‘ЏX∆љћ®∞lќƒ£ђґшЈ«‘V÷TЈ®¬…£ђя@‘Џ≤ї…ўЊW”——џ÷–ЊЌ”––©њ…“…°£

я@ќїЊW”—±г’JЮй£ђ≈c∆дјы”√єЂЋЊ”∞нСЅ¶Бн¬ХЈQВАДe”ЖСф°∞ЮE”√°±ЈюД’БKЌю√{√јЗшµƒДУ“в≥…єы£ђAnthropicЄьС™‘У„цµƒ «МҐ„‘ЉЇµƒЈ®¬…ЇЌ∞≤»ЂўY‘іёDѕтљвЫQя@–©іу“Оƒ£µƒѕµљy–‘є•Уф°£

ЊW”—Ќ¬≤џAnthropic£®ИD‘і£ЇX∆љћ®£©

”–ќїЊW”—љo≥цЅЋ„‘ЉЇМ¶…ѕ цђFѕуµƒЈ÷ќц£Ї’фрsМНлH…ѕБK≤їя`Ј®£ђЉі±гЊЌЋг «я`Ј®––Юй£ђƒ«ьNClaude“≤ «Ј«Ј®ШЛ‘мµƒ°£я@ЊЌ «Юй ≤ьNAnthropic‘Џѕт’юЄЃ±І‘єя@“ЉЖЦо}£ђґш≤ї «÷±љ”∆р‘V°£

ЊW”—Ј÷ќц’фрs––ЮйµƒЇѕЈ®–‘ЖЦо}£®ИD‘і£ЇX∆љћ®£©

Ѕн“ЉќїЊW”—’JЮй£ђЇѕЈ®’фрs є”√µƒіж‘Џ£ђ„М±Oє№є§„ч„Гµ√Єьлy£ђ“тЮй„C√ч∆уШI є”√ƒ£–Ќµƒ“вИDЇЌ“Оƒ££ђ“™±»Вчљyµƒ∞жЩаЋчўrПЌлsµ√ґа°£

ЊW”—Ј÷ќц’фрs––ЮйµƒЇѕЈ®–‘ЖЦо}£®ИD‘і£ЇX∆љћ®£©

Anthropicµƒ≈eД”‘Џ≤њЈ÷ЊW”——џ÷–БK≤їєв≤ °£я@ќїЊW”—ЊЌ’JЮй£ђAnthropicя@“Љћ„°∞’И≤ї“™ѕтќ“ВГµƒЄВ†ОМ¶ ÷≥цњЏGPU°±µƒ—‘’У£ђ¬†∆рБнЊЌѕс «ЋыВГѕлМНђFƒ≥ЈNЙ≈Фа°£

ЊW”—ў|“…Anthropic‘ЗИDМНђFЙ≈Фа£®ИD‘і£ЇX∆љћ®£©

AnthropicяА‘Џ∆дєўЈљ≤©њЌ÷–≈ы¬ґЅЋ“ЉнЧ÷Ў“™ЉЪєЭ£ЇЌ®я^Ј÷ќц’И«у‘™ФµУю£ђЋыВГƒ№ЙтМҐћЎґ®µƒМ¶‘Т”ЫдЫ÷±љ”„ЈЋЁµљ‘¬÷Ѓ∞µ√жЇЌDeepSeekµƒЊяуwЖTє§£ђµ»мґнШ÷шЊWЊА“Љ¬ЈЊЂ„Љжiґ®’ж»Ћ°£я@“Љ„цЈ®лSЉі“э∞lЅЋЌвљзМ¶ФµУю∞≤»Ђ≈cл[Ћљ±£„oЖЦо}µƒУъСn°£

“ЉќїБн„‘ЪW÷ёµƒ”√СфЈQ£ђAnthropicµƒя@Јђ—‘’У£ђЋ∆Їх’э‘ЏіµЗu„‘ЉЇƒ№ є”√‘™ФµУю£ђМНђF”√Сфµƒ»•ƒд√ыїѓ£ђ°∞лyµјя@ЊЌ «Anthropic»зљсµƒл[Ћљ’ю≤яЖб°±£њ

ЊW”—ў|“…AnthropicµƒФµУю∞≤»ЂЖЦо}£®ИD‘і£ЇX∆љћ®£©

AnthropicМҐ’фрs––ЮйЈQЮй°∞’фрsє•Уф°±£ђя@“Љ’fЈ®±Њў|…ѕ“≤”––©°∞ќƒ„÷”ќСт°±µƒѕ”“…°£ґаќїRedditЊW”—’JЮй£ђЉі±г∆дЋыєЂЋЊі_МНјы”√∆дЃa∆Ј…ъ≥…µƒФµУюяM––”ЦЊЪ£ђя@±Њў|…ѕ“≤÷ї «”√Сф‘Џ’э≥£ є”√Ѓa∆Ј£ђґш«“я@–©”√Сф «ЄґЅЋўMµƒ°£

”–‘u’УСт÷oµј£ђ∞і’’Anthropicя@ћ„яЙЁЛ£ђЊЌЇ√±»ƒг»•≤ЌПd≥‘пИ£ђ”Ы„°ЅЋПNОЯ„ц≥цБнµƒќґµј£ђ»їббїЎЉ“„‘ЉЇ„цЅЋоDпИ£ђЊЌ±їњџ…ѕЅЋ°∞Ј«Ј®яM––’фрsє•Уф°±µƒ√±„”°£

RedditЊW”—Ќ¬≤џAnthropicµƒќƒ„÷”ќСт£®ИD‘і£ЇX∆љћ®£©

±їў|“…’фрs≤ї «–¬хr ¬

DeepSeek°Ґ‘¬÷Ѓ∞µ√жіЋ«∞“—”–’э√жїЎС™

ƒњ«∞£ђDeepSeek°Ґ‘¬÷Ѓ∞µ√жЇЌMiniMaxЊщ…–ќіМ¶Anthropicµƒ±Њіќ÷ЄњЎ„ц≥цєЂй_їЎС™°£

≤їя^£ђМ¶мґ÷–Зшƒ£–Ќ’фрsЇ£Ќвƒ£–Ќµƒў|“…£ђ„‘2025ƒкDeepSeekяM»л»Ђ«т÷чЅч“Х“∞“‘БнЊЌ“Љ÷±Ы]”–÷–Фая^°£ґшя@–©÷–Зш∆уШIіЋ«∞“—љЫ‘Џ≤їЌђµƒИцЇѕ£ђїЎС™я^ѕакPў|“…°£

±»»з£ђDeepSeekЊЌ‘ш‘вµљOpenAIў|“…£ђЈQ∆дƒ£–Ќ’фрs„‘OpenAIµƒƒ£–Ќ°£

„чЮйїЎС™£ђDeepSeek‘Џ»•ƒк9‘¬µ«…ѕNatureлs÷ЊЈв√жµƒDeepSeek-R1’Уќƒ÷–—a≥дµј£ђDeepSeek-V3 Base£®DeepSeek-R1µƒїщ„щƒ£–Ќ£© є”√µƒФµУю»Ђ≤њБн„‘ї•¬УЊW£ђлm»їњ…ƒ№∞ьЇђGPT-4…ъ≥…µƒљYєы£ђµЂљ^Ј«”–“вґшЮй÷Ѓ£ђЄьЫ]”–М£йTµƒ’фрs≠hєЭ°£

ґшљсƒк1‘¬£ђ‘¬÷Ѓ∞µ√ж“≤‘шїЎС™ЌвљзМ¶Kimi K2.5µƒ’фрsў|“…°£

ЃФХr£ђ”–≤њЈ÷ЊW”—∞lђFKimi K2.5”–ХrХю„‘ЈQЮйClaude£ђС—“…я@ «М¶ClaudeяM––’фрsµƒ„CУю°£Чо÷≤члїЎС™µј£ђя@“ЉђFѕу÷ч“™ «”…‘ЏоA”ЦЊЪлAґќМ¶„о–¬ЊО≥ћФµУюяM––ЅЋ…ѕ≤…Ш”£ђґшя@–©ФµУюЋ∆Їх≈c°∞Claude°±я@ВАtokenµƒкP¬У–‘Ё^ПК°£ ¬МН…ѕ£ђK2.5‘Џ‘Sґаїщ„ЉЬy‘З÷–Ћ∆ЇхґЉГЮмґClaude°£

ƒ«ьN£ђЮй ≤ьNClaude…ъ≥…µƒФµУюХю°∞’`іт’`„≤°±»Џ»л÷–Зш∆уШIµƒƒ£–ЌƒЎ£њ

ƒњ«∞µƒіуƒ£–Ќ”ЦЊЪ£ђЄяґ»“јўЗєЂй_ї•¬УЊWФµУю°£ѕсAnthropicЌ∆≥цµƒClaude“‘Љ∞Claude Code£ђ±ї»Ђ«тй_∞l’яПVЈЇ”√мґМСіъіa°Ґ…ъ≥…ќƒЩn°Ґћбљїй_‘інЧƒњ°£

ЃФй_∞l’я∞—я@–©…ъ≥…Г»»Ё∞l≤ЉµљGitHub°Ґ≤©њЌїтЉЉ–g’УЙѓбб£ђя@–©Г»»ЁЊЌяM»лЅЋєЂє≤ї•¬УЊW’ZЅѕ≥Ў°£ґш‘Sґаƒ£–Ќ‘Џ”ЦЊЪХrХю„•»°єЂй_ЊWнУФµУю£ђ“тіЋ∆д÷–“Љ≤њЈ÷„‘»їХю∞ьЇђ”…Claude…ъ≥…µƒіъіaїтќƒ±Њ°£я@ «“ЉЈNйgљ”ФU…Ґ¬ЈПљ£ђњ…ƒ№≥цђF‘Џ»ќЇќƒ£–Ќ…н…ѕ£ђ“э∞lƒ£–Ќµƒ°∞„‘ќ“’J÷™°±ЖЦо}°£Anthropic„‘Љ“µƒƒ£–ЌClaude Sonnet 4.6£ђ“≤‘ш≥цђF„‘ЈQЮйDeepSeekµƒ«йЫr°£

Claude Sonnet 4.6„‘ЈQDeepSeek

”–≤ї…ўЇ£ЌвЉЉ–g»¶»Ћ њ“≤кP„ҐµљЅЋя@“ЉђFѕу°£AI”ЦЊЪ∆љћ®Prime Intellectµƒє§≥ћОЯWill Brownћб≥цЅЋіуЅњЖЦо}°£±»»з£ђ є”√ClaudeЎХЂIµƒй_‘іGitHubіъіa”ЦЊЪƒ£–Ќ£ђЋг≤їЋг’фрs£њ∞—ClaudeµƒФµУюєЂй_Ј÷ѕнµљї•¬УЊW…ѕ£ђя`≤їя`Јі”√СфЕfґ®£њ”√Claude CodeМС”ЦЊЪіъіa£ђ”√촔֌ڪВМ¶ƒ£–Ќ£ђя`≤їя`Јі”√СфЕfґ®£њ

Will BrownМ¶Anthropicћб≥ц“ЉяBіЃ“…ЖЦ£®ИD‘і£ЇX∆љћ®£©

»зєы…ѕ цЖЦо}µƒір∞ЄґЉ «°∞ «°±£ђƒ«ьN’э»зЅн“ЉќїЊW”—Ћщ’fµƒ£ђЄщУюAnthropicµƒЧlњо£ђ‘ЏAI»¶—e£ђ”…мґAnthropicЇЌЋщ”–∆уШIґЉ”–ЄВ†ОкPѕµ£ђƒ«ьNјн’У…ѕ÷ї”–Anthropic„‘ЉЇњ…“‘ є”√Claude£ђ∆дЋы∆уШIґЉ≤їƒ№”√°£

Ѕн“ЉќїЊW”—’JЮй£ђЋщ÷^µƒ°∞Ј«Ј®’фрs°±ЇЌ°∞’э≥£ї•¬УЊWїоД”°±µƒљзѕёБK≤ї«еќъ£ђ»зљсAnthropic’ж’э–и“™„цµƒ «„Љі_љзґ®£ђ»їббЌ∆Д”±Oє№°£

ЊW”—ћб≥ц‘УоI”тіж‘Џ±Oє№њ’∞„£®ИD‘і£ЇX∆љћ®£©

љY’Z£Ї†О„h±≥ббµƒЃaШI≤©ёƒ

ПƒЃaШIЄВ†Ољ«ґ»њі£ђЃФ«∞»Ђ«тіуƒ£–Ќƒ№Ѕ¶’э‘ЏњмЋў ’Фњ°£÷–ЗшAIєЂЋЊ‘ЏЋгЅ¶ №ѕёµƒ«йЫrѕ¬£ђЌ®я^ЋгЈ®ГЮїѓ°Ґє§≥ћƒ№Ѕ¶ћб…эЇЌФµУюјы”√–І¬ ЄƒяMБн„ЈЏsЗшлH«∞—Ў£ђ„я≥ц™ЪћЎµƒЉЉ–gДУ–¬¬ЈПљ°£МҐЋщ”–ƒ№Ѕ¶ћб…эґЉЪw“тмґ°∞’фрsћб»°°±£ђіуЈщґ»ўHµЌЅЋ÷–ЗшAIМНтЮ “µƒ—–∞lЌґ»л≈cє§≥ћяM’є°£

ЃФ»ї£ђ»зєыі_МНіж‘Џя`ЈіЈюД’Чlњо°Ґ є”√ћУЉўў~Сфµ»––Юй£ђ∆љћ®Јљ≤…»°ЉЉ–gЈвљыЇЌпLњЎіл ©Мўмґ’э≥£…ћШI––Юй°£µЂМҐ∆д…ѕ…эЮйЗшЉ“∞≤»ЂЌю√{£ђ…х÷Ѕ„чЮйПКїѓ≥цњЏє№÷∆µƒ’УУю£ђДt“—љЫ≥ђ≥цЖќ“Љ∆уШIЉmЉКµƒЈґЗъ°£М¶ќ“ВГґш—‘£ђ≈c∆дЇЖЖќљ” №ƒ≥“ЉЈљµƒґ®–‘£ђ≤ї»з±£≥÷МП…чСBґ»£ђјдмoњііэ∆д±≥ббµƒЃaШI≤©ёƒяЙЁЛ°£

[ќпГrпwЭqµƒХrЇт я@Ш” °еXўПќпЇ№Ћђ]

| Ј÷ѕн: |

| „Ґ£Ї |

| —”…мйЖ„x | Єьґа... |

Ќ∆Ћ]: