英偉達發布會:黃仁勳曬”AI核彈“

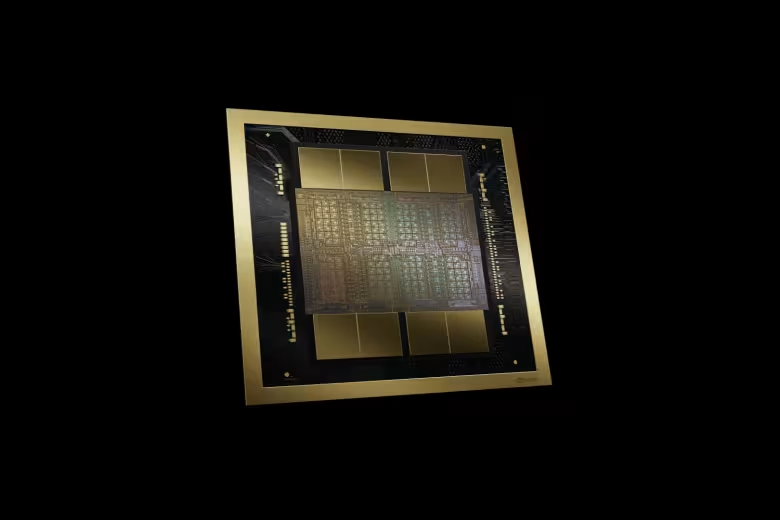

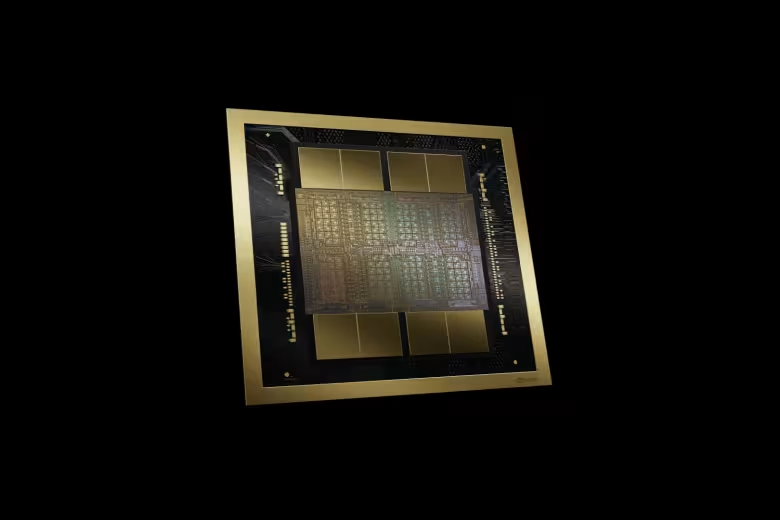

黃仁勳展示Blackwell和Hopper架構GPU對比,左邊為Blackwell架構的B200芯片

在新壹代的GPU正式亮相之前,關於架構、雙芯片設計等已經有不少傳聞,關注點在於,黃仁勳會把手中的“AI核彈”性能提升到多少?

現在,官方的答案給出來了——基於Blackwell架構的B200采用雙芯片設計,基於台積電4nm工藝,晶體管數量達到2080億個,上壹代Hopper架構的H100同樣是4nm工藝,但由於沒有上雙芯片設計,晶體管數量只有800億。

B200搭配8顆HBM3e內存(比Hopper架構的H200多了2顆),內存達到192GB,基於第伍代NVLink,帶寬達到1.8TB/s,相比Hopper架構和Ampere架構,有了巨幅提升,最大可支持10萬億參數的模型的訓練。

作為對比,OpenAI的GPT-3由1750億個參數組成,GPT-4參數為1.8萬億。

B200官方圖

黃仁勳還介紹稱,B200平台可以向下兼容,支持與上壹代Hopper架構的H100/H200HGX系統硬件適配。

此前,被稱之為OpenAI勁敵的InflectionAI,官宣建立了壹套22000顆英偉達H100GPU的世界最大人工智能數據中心集群,接下來要看看OpenAI,能不能借助B200反超了。

這裡再插壹句英偉達的NVLink和NVLinkSwitch技術。

其中NVLink是英偉達開發的CPU和GPU之間高速互聯通道,在內存牆無法突破的情況下,最大化提升CPU和GPU之間通信的效率,於2016年在基於Pascal架構的GP100芯片和P100運算卡上率先采用,當時的帶寬為160GB/s,到H100采用的第肆代NVLink,其帶寬已經達到900GB/s,而B200采用的第伍代NVLink帶寬已經突破1.8TB/s。

NVLinkSwitch支持與多個NVLink連接,實現NVLink在單節點、節點之間互聯,進而創建更高帶寬的GPU集群,基於最新的NVLinkSwitch芯片(台積電4nm工藝,500億個晶體管),可實現576顆GPU組成計算集群,上壹代產品僅支持到256個GPU。

根據官方公布的數據,B200支持第贰代Transformer引擎,Tensor核支持FP4、FP6精度計算,單顆B200GPU的AI性能達20PFLOPs(即每秒2億億次)。

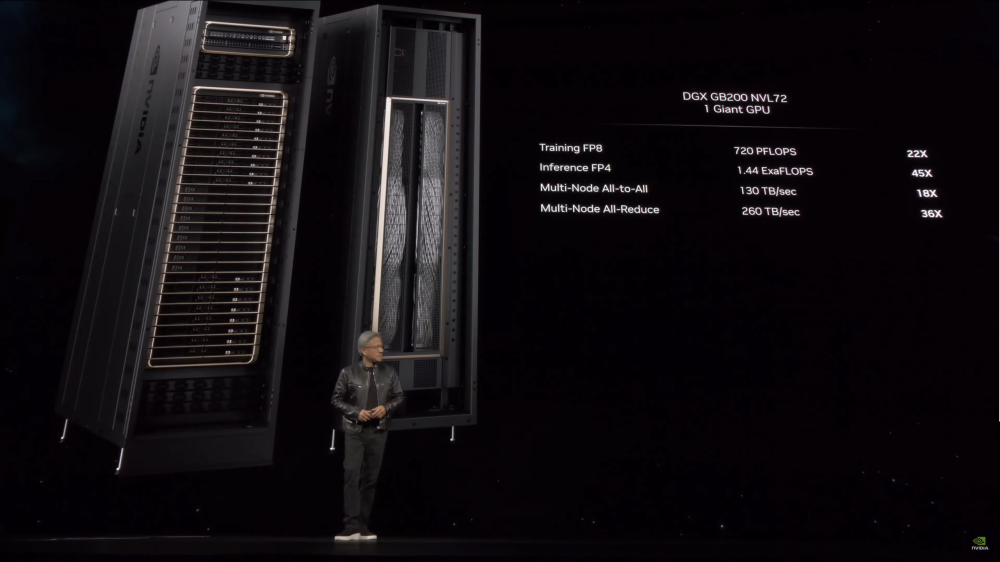

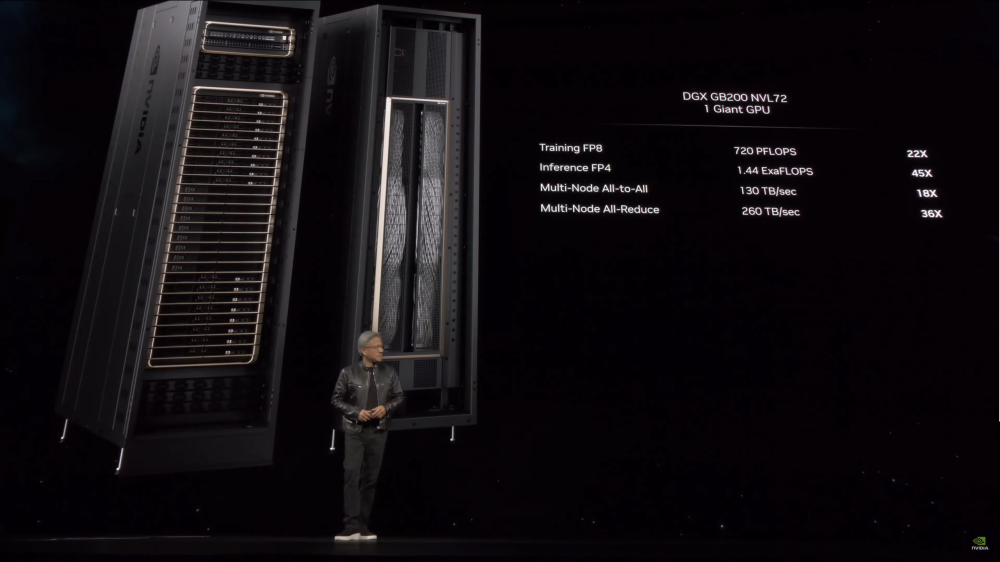

DGX版GB200NVL72

另外,英偉達還在主題演講中展示了全新的加速計算平台DGXGB200NVL72,擁有9個機架,總共搭載18個GB200加速卡,即36顆GRACECPU和72顆Blackwell架構GPU(英偉達也提供了HGXB200版本,簡單來說就是用Intel的XeonCPU,替換了GraceCPU)。

黃仁勳說,壹套DGX版GB200NVL72總共內置了5000條NVLink銅制線纜,總長度達到2公裡,可以減少20kW的計算能耗。

[加西網正招聘多名全職sales 待遇優]

這條新聞還沒有人評論喔,等著您的高見呢

在新壹代的GPU正式亮相之前,關於架構、雙芯片設計等已經有不少傳聞,關注點在於,黃仁勳會把手中的“AI核彈”性能提升到多少?

現在,官方的答案給出來了——基於Blackwell架構的B200采用雙芯片設計,基於台積電4nm工藝,晶體管數量達到2080億個,上壹代Hopper架構的H100同樣是4nm工藝,但由於沒有上雙芯片設計,晶體管數量只有800億。

B200搭配8顆HBM3e內存(比Hopper架構的H200多了2顆),內存達到192GB,基於第伍代NVLink,帶寬達到1.8TB/s,相比Hopper架構和Ampere架構,有了巨幅提升,最大可支持10萬億參數的模型的訓練。

作為對比,OpenAI的GPT-3由1750億個參數組成,GPT-4參數為1.8萬億。

B200官方圖

黃仁勳還介紹稱,B200平台可以向下兼容,支持與上壹代Hopper架構的H100/H200HGX系統硬件適配。

此前,被稱之為OpenAI勁敵的InflectionAI,官宣建立了壹套22000顆英偉達H100GPU的世界最大人工智能數據中心集群,接下來要看看OpenAI,能不能借助B200反超了。

這裡再插壹句英偉達的NVLink和NVLinkSwitch技術。

其中NVLink是英偉達開發的CPU和GPU之間高速互聯通道,在內存牆無法突破的情況下,最大化提升CPU和GPU之間通信的效率,於2016年在基於Pascal架構的GP100芯片和P100運算卡上率先采用,當時的帶寬為160GB/s,到H100采用的第肆代NVLink,其帶寬已經達到900GB/s,而B200采用的第伍代NVLink帶寬已經突破1.8TB/s。

NVLinkSwitch支持與多個NVLink連接,實現NVLink在單節點、節點之間互聯,進而創建更高帶寬的GPU集群,基於最新的NVLinkSwitch芯片(台積電4nm工藝,500億個晶體管),可實現576顆GPU組成計算集群,上壹代產品僅支持到256個GPU。

根據官方公布的數據,B200支持第贰代Transformer引擎,Tensor核支持FP4、FP6精度計算,單顆B200GPU的AI性能達20PFLOPs(即每秒2億億次)。

DGX版GB200NVL72

另外,英偉達還在主題演講中展示了全新的加速計算平台DGXGB200NVL72,擁有9個機架,總共搭載18個GB200加速卡,即36顆GRACECPU和72顆Blackwell架構GPU(英偉達也提供了HGXB200版本,簡單來說就是用Intel的XeonCPU,替換了GraceCPU)。

黃仁勳說,壹套DGX版GB200NVL72總共內置了5000條NVLink銅制線纜,總長度達到2公裡,可以減少20kW的計算能耗。

[加西網正招聘多名全職sales 待遇優]

| 分享: |

| 注: | 在此頁閱讀全文 |

推薦:

英偉達發布會:黃仁勳曬”AI核彈“

英偉達發布會:黃仁勳曬”AI核彈“