[腾讯] 腾讯推出0.4G离线翻译模型 比谷歌翻译得好

4月29日,腾讯混元推出并开源极致量化压缩版本翻译模型 Hy-MT1.5-1.8B-1.25bit,把支持 33 种语言的翻译大模型压缩至 440MB,无需联网,下载即可直接在手机本地运行,翻译质量优于谷歌翻译。

翻译质量及速度演示(设备:高通骁龙 865 8GB 内存)

这一离线翻译模型基于混元翻译大模型Hy-mt1.5打造 。Hy-mt1.5 是腾讯混元团队打造的专业翻译大模型,原生支持 33 种语言、5 种方言/民汉及 1056 个翻译方向。从常见的中英互译,到法语、日语、阿拉伯语、俄语,甚至藏语、蒙古语等少数民族语言,它都能游刃有余地处理。

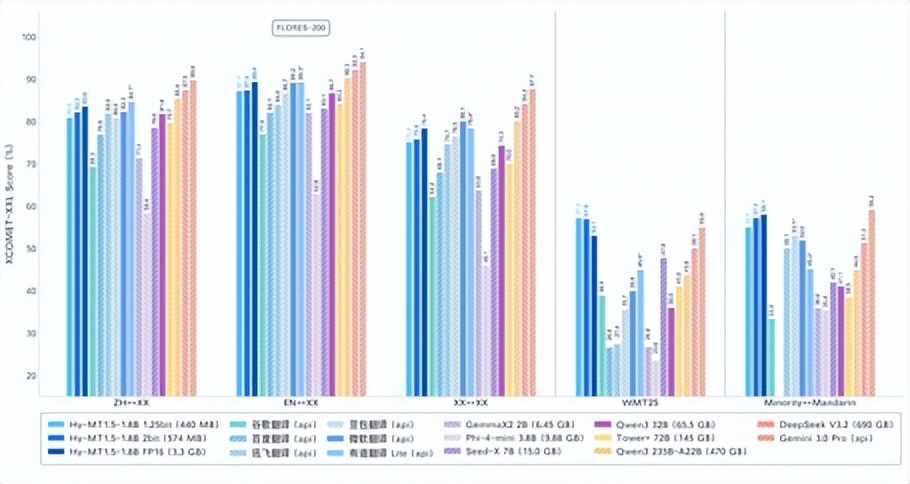

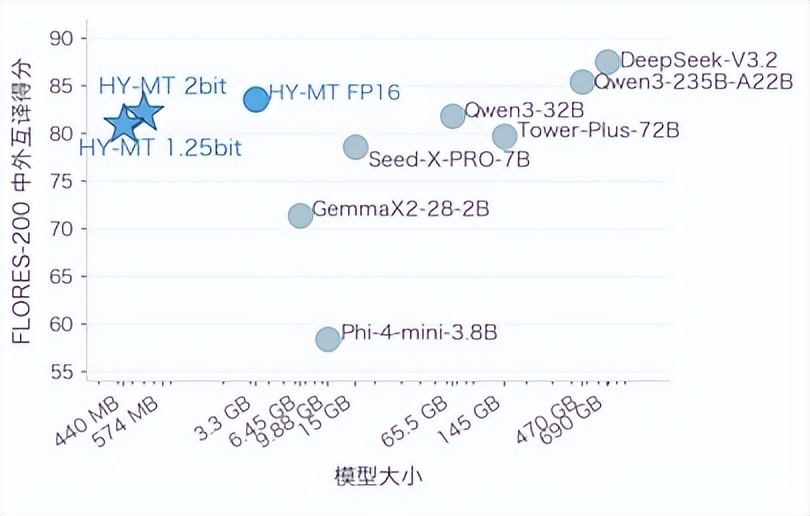

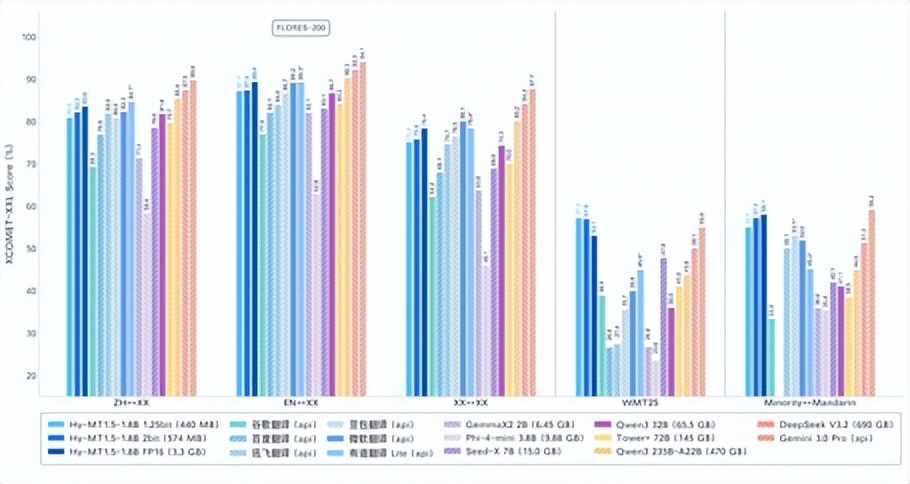

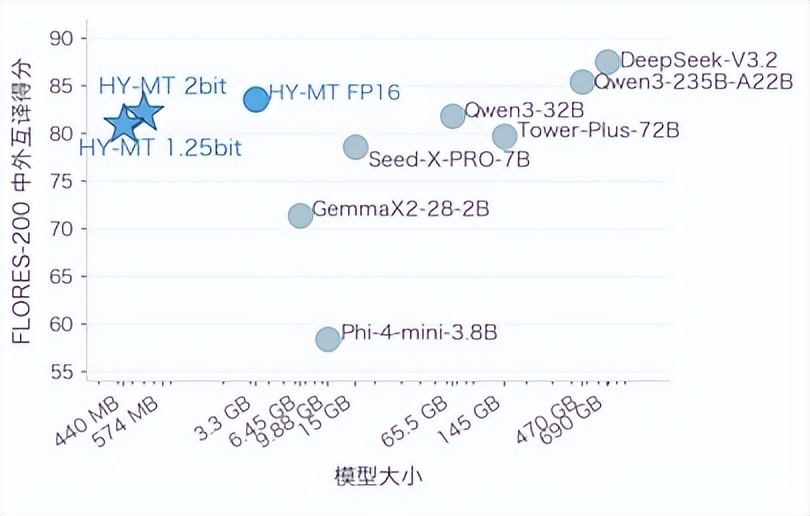

值得注意到是,仅以 1.8B 参数量,Hy-mt1.5 实现了比肩商业翻译 API 和 235B 级大模型的翻译效果 。在严格的评测基准中,其翻译质量不仅超越了 Google 翻译等主流系统,更证明了在高效优化下,轻量级模型能够展现出亮眼的翻译能力。

在实际业务场景中,混元团队发现,原始的 1.8B 模型即使在 FP16 精度下,依然占用 3.3GB 内存,对于手机上金子般珍贵的内存来说,依然太大、太慢,所以需要量化压缩。

所谓的量化压缩,就是通过把模型里原本用16位数字(16-bit)表示的参数转用更低位数字储存,这就像把一幅高清照片压缩成缩略图,文件小了很多,但你还是能看清楚里面的内容。 针对不同的手机用户, 腾讯特别推出了2-bit 与 1.25-bit 两种极致的量化压缩方案。

2-bit模型在 SME2 及 Neon 内核的速度对比演示。

[物价飞涨的时候 这样省钱购物很爽]

无评论不新闻,发表一下您的意见吧

翻译质量及速度演示(设备:高通骁龙 865 8GB 内存)

这一离线翻译模型基于混元翻译大模型Hy-mt1.5打造 。Hy-mt1.5 是腾讯混元团队打造的专业翻译大模型,原生支持 33 种语言、5 种方言/民汉及 1056 个翻译方向。从常见的中英互译,到法语、日语、阿拉伯语、俄语,甚至藏语、蒙古语等少数民族语言,它都能游刃有余地处理。

值得注意到是,仅以 1.8B 参数量,Hy-mt1.5 实现了比肩商业翻译 API 和 235B 级大模型的翻译效果 。在严格的评测基准中,其翻译质量不仅超越了 Google 翻译等主流系统,更证明了在高效优化下,轻量级模型能够展现出亮眼的翻译能力。

在实际业务场景中,混元团队发现,原始的 1.8B 模型即使在 FP16 精度下,依然占用 3.3GB 内存,对于手机上金子般珍贵的内存来说,依然太大、太慢,所以需要量化压缩。

所谓的量化压缩,就是通过把模型里原本用16位数字(16-bit)表示的参数转用更低位数字储存,这就像把一幅高清照片压缩成缩略图,文件小了很多,但你还是能看清楚里面的内容。 针对不同的手机用户, 腾讯特别推出了2-bit 与 1.25-bit 两种极致的量化压缩方案。

2-bit模型在 SME2 及 Neon 内核的速度对比演示。

[物价飞涨的时候 这样省钱购物很爽]

| 分享: |

| 注: | 在此页阅读全文 |

| 延伸阅读 | 更多... |

推荐: