[腾讯] 腾讯推出0.4G离线翻译模型 比谷歌翻译得好

4月29日,腾讯混元推出并开源极致量化压缩版本翻译模型 Hy-MT1.5-1.8B-1.25bit,把支持 33 种语言的翻译大模型压缩至 440MB,无需联网,下载即可直接在手机本地运行,翻译质量优于谷歌翻译。

翻译质量及速度演示(设备:高通骁龙 865 8GB 内存)

这一离线翻译模型基于混元翻译大模型Hy-mt1.5打造 。Hy-mt1.5 是腾讯混元团队打造的专业翻译大模型,原生支持 33 种语言、5 种方言/民汉及 1056 个翻译方向。从常见的中英互译,到法语、日语、阿拉伯语、俄语,甚至藏语、蒙古语等少数民族语言,它都能游刃有余地处理。

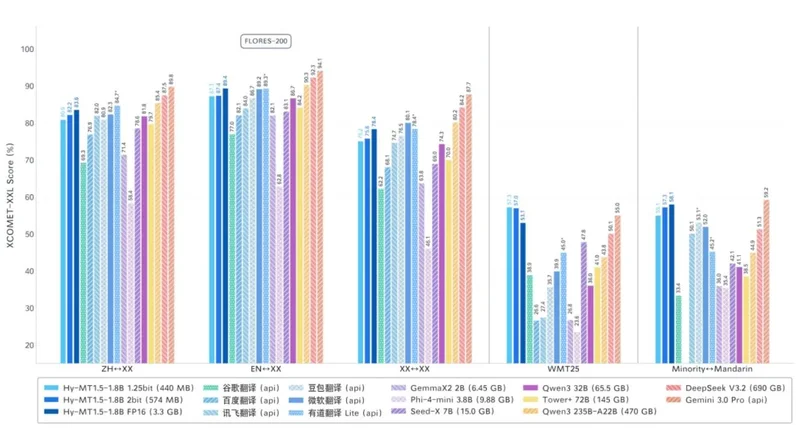

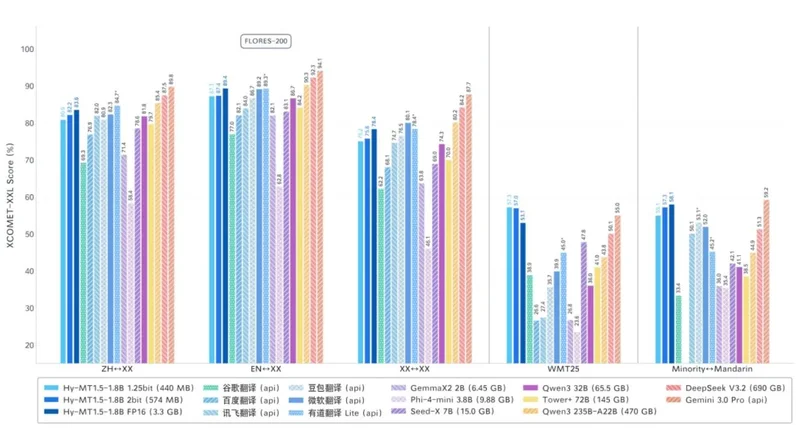

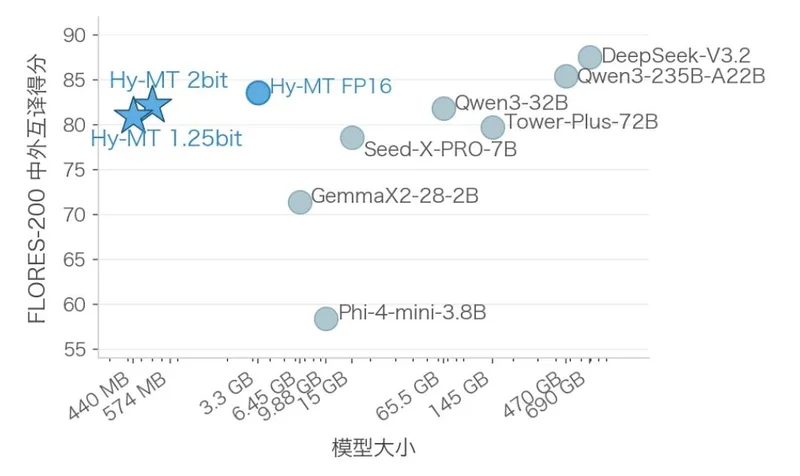

值得注意到是,仅以 1.8B 参数量,Hy-mt1.5 实现了比肩商业翻译 API 和 235B 级大模型的翻译效果 。在严格的评测基准中,其翻译质量不仅超越了 Google 翻译等主流系统,更证明了在高效优化下,轻量级模型能够展现出亮眼的翻译能力。

在实际业务场景中,混元团队发现,原始的 1.8B 模型即使在 FP16 精度下,依然占用 3.3GB 内存,对于手机上金子般珍贵的内存来说,依然太大、太慢,所以需要量化压缩。

所谓的量化压缩,就是通过把模型里原本用16位数字(16-bit)表示的参数转用更低位数字储存,这就像把一幅高清照片压缩成缩略图,文件小了很多,但你还是能看清楚里面的内容。 针对不同的手机用户, 腾讯特别推出了2-bit 与 1.25-bit 两种极致的量化压缩方案。

2-bit模型在 SME2 及 Neon 内核的速度对比演示。

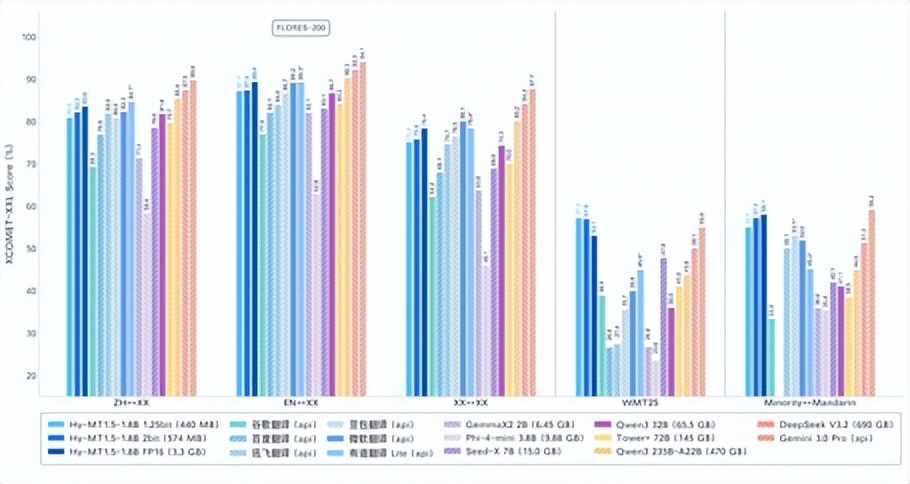

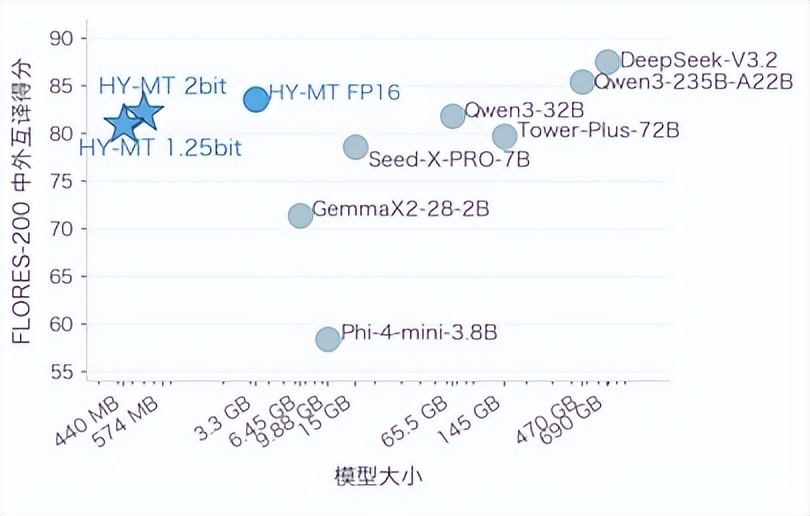

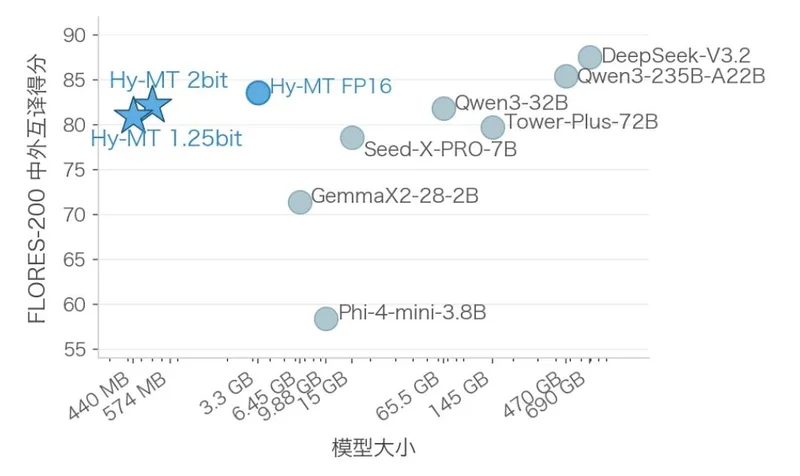

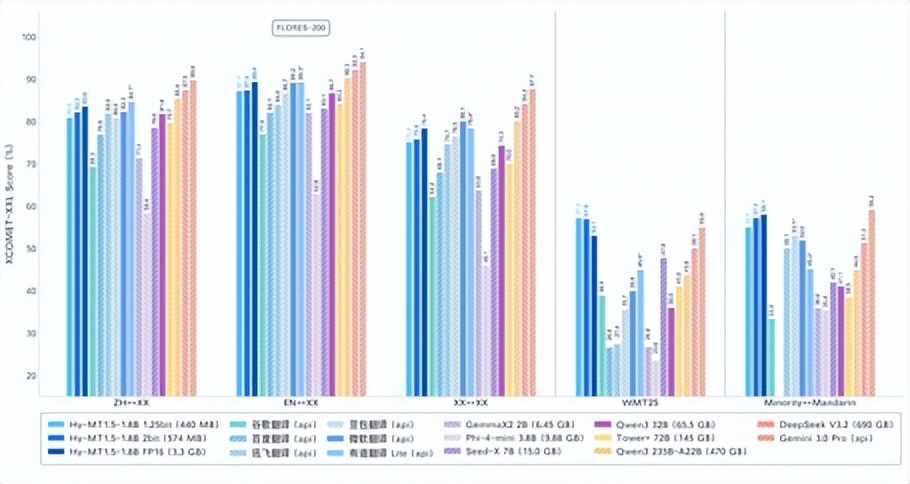

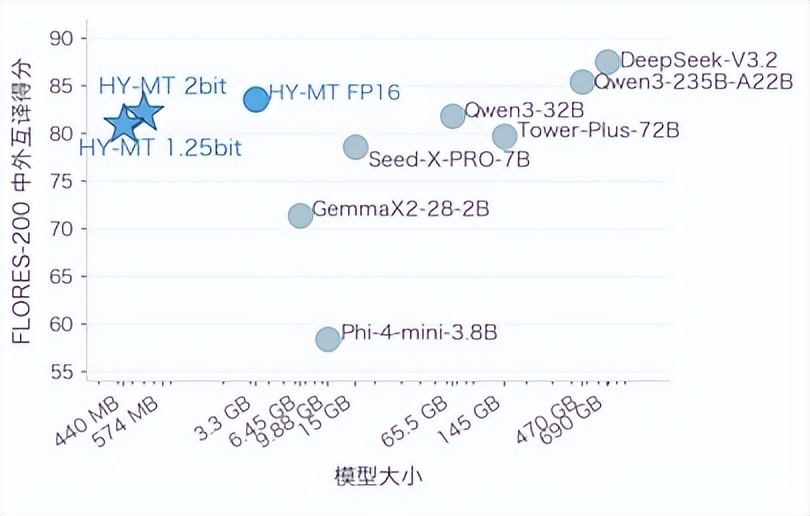

不同大小的模型在 FLORES-200 中外互译的效果评分

除了模型权重开源,腾讯混元也推出了一个实际可用的「腾讯混元翻译Demo版」,特别适配了“后台取词模式”。无论是在本地查看邮件还是浏览网页,混元翻译都能随叫随到。无需网络,无需订阅,完全本地处理、不涉及个人信息的采集和上传,一次下载永久使用。

后台取词模式演示。演示设备:高通骁龙7+ gen 2, 16GB 内存

腾讯混元翻译模型能力出色,此前不仅在国际机器翻译比赛拿下30个第1名,也已经在腾讯内部多个业务场景落地应用,包括元宝、腾讯会议、企业微信、QQ浏览器、客服翻译等。

相关报道:

0.4G、离线也能跑的翻译模型,开源了!智东西4月29日报道,今日,腾讯混元开源翻译模型Hy-MT1.5-1.8B-1.25bit。该模型仅0.4G,就实现了33种语言高质量互译,且下载后可直接在手机本地离线运行,翻译表现优于谷歌翻译。这一原始模型的参数规模为1.8B,为降低用户手机内存压力,腾讯混元团队通过量化压缩推出了适配中高性能手机的2-bit、全系列手机的1.25-bit两种方案,模型体积分别被压缩至574MB、440MB。

开源项目主页

此次开源,腾讯混元团队还制作了一个实际可用的腾讯混元翻译Demo版,并适配“后台取词模式”。用户在本地查看邮件、浏览网页时,都能随时调用混元翻译,且无需网络、订阅,翻译过程都在本地处理、不涉及个人信息的采集和上传,一次下载永久免费使用。该Demo暂时只支持安卓体验, 后续正式版会添加对IOS等平台的支持。

演示设备:高通骁龙7+gen2,16GB内存

Hy-MT1.5是腾讯混元团队打造的专业翻译大模型,原生支持33种语言、5种方言及1056个翻译方向,包含中英互译以及对法语、日语、阿拉伯语、俄语,甚至藏语、蒙古语等各种语言的翻译。

翻译模型演示,设备:高通骁龙865,8GB内存

腾讯混元的基准测试结果显示,Hy-MT1.5的翻译效果可比肩商业翻译API和235B级大模型的翻译效果,且翻译质量在基准测试中超过了谷歌翻译等主流系统。

原始1.8B模型在FP16精度下会占用3.3GB内存,为了不占用手机内存,研究人员进行了量化压缩。

其将模型里原本用16位数字(16-bit)表示的参数转用更低位数字储存。这就像把一幅高清照片压缩成缩略图,虽然文件小但还是能看清楚内容。

此外,针对不同的手机用户,腾讯还推出了2-bit与1.25-bit两种量化压缩方案。其实测显示,量化压缩后的两款模型表现效果远超同体积或更大体积大模型的翻译效果。

2-bit适用的中高端机型,模型体积压缩至574MB。

根据官方介绍,2-bit模型采用拉伸弹性量化(SEQ),将模型参数量化至{-1.5,-0.5,0.5,1.5},并结合量化感知蒸馏,在将模型体积压缩至574MB的同时,实现了几乎无损翻译质量,效果超越上百GB的大模型。在支持Arm SME2技术的移动设备上,2-bit模型能够实现更快速、更高效的推理。

1.25-bit模型适用全系机型,模型体积为440MB。

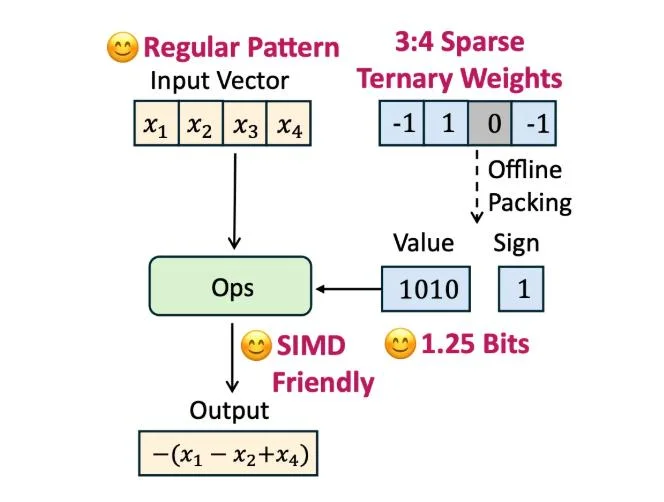

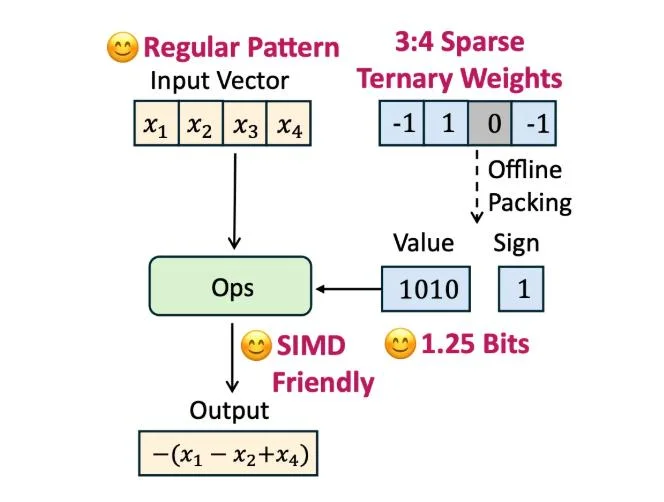

这一模型基于Sherry(稀疏高效三值量化)技术,其核心逻辑在于“细粒度稀疏”策略:每4个模型参数,3个最重要的用1-bit储存,1个用0储存,平均每个参数仅需1.25-bit。

此外,其还搭载了腾讯为手机CPU设计的STQ内核,适配SIMD指令集。这使得该模型能长时间在后台停留。Sherry技术方案已经被NLP顶级学术会议ACL 2026录用。

结语:腾讯混元拉低离线翻译普及门槛AI翻译已成为手机、输入法、浏览器、会议、客服工具等各种工具的标配功能,但大多工具仍是联网调用云端API,离线能力弱、体验差、隐私风险高。

腾讯混元此次开源轻量化翻译模型,用几百MB级的体积实现了媲美云端大模型的翻译质量,或直接把高端离线翻译从云端特权拉到手机可普及的门槛。

[物价飞涨的时候 这样省钱购物很爽]

这条新闻还没有人评论喔,等着您的高见呢

翻译质量及速度演示(设备:高通骁龙 865 8GB 内存)

这一离线翻译模型基于混元翻译大模型Hy-mt1.5打造 。Hy-mt1.5 是腾讯混元团队打造的专业翻译大模型,原生支持 33 种语言、5 种方言/民汉及 1056 个翻译方向。从常见的中英互译,到法语、日语、阿拉伯语、俄语,甚至藏语、蒙古语等少数民族语言,它都能游刃有余地处理。

值得注意到是,仅以 1.8B 参数量,Hy-mt1.5 实现了比肩商业翻译 API 和 235B 级大模型的翻译效果 。在严格的评测基准中,其翻译质量不仅超越了 Google 翻译等主流系统,更证明了在高效优化下,轻量级模型能够展现出亮眼的翻译能力。

在实际业务场景中,混元团队发现,原始的 1.8B 模型即使在 FP16 精度下,依然占用 3.3GB 内存,对于手机上金子般珍贵的内存来说,依然太大、太慢,所以需要量化压缩。

所谓的量化压缩,就是通过把模型里原本用16位数字(16-bit)表示的参数转用更低位数字储存,这就像把一幅高清照片压缩成缩略图,文件小了很多,但你还是能看清楚里面的内容。 针对不同的手机用户, 腾讯特别推出了2-bit 与 1.25-bit 两种极致的量化压缩方案。

2-bit模型在 SME2 及 Neon 内核的速度对比演示。

不同大小的模型在 FLORES-200 中外互译的效果评分

除了模型权重开源,腾讯混元也推出了一个实际可用的「腾讯混元翻译Demo版」,特别适配了“后台取词模式”。无论是在本地查看邮件还是浏览网页,混元翻译都能随叫随到。无需网络,无需订阅,完全本地处理、不涉及个人信息的采集和上传,一次下载永久使用。

后台取词模式演示。演示设备:高通骁龙7+ gen 2, 16GB 内存

腾讯混元翻译模型能力出色,此前不仅在国际机器翻译比赛拿下30个第1名,也已经在腾讯内部多个业务场景落地应用,包括元宝、腾讯会议、企业微信、QQ浏览器、客服翻译等。

相关报道:

0.4G、离线也能跑的翻译模型,开源了!智东西4月29日报道,今日,腾讯混元开源翻译模型Hy-MT1.5-1.8B-1.25bit。该模型仅0.4G,就实现了33种语言高质量互译,且下载后可直接在手机本地离线运行,翻译表现优于谷歌翻译。这一原始模型的参数规模为1.8B,为降低用户手机内存压力,腾讯混元团队通过量化压缩推出了适配中高性能手机的2-bit、全系列手机的1.25-bit两种方案,模型体积分别被压缩至574MB、440MB。

开源项目主页

此次开源,腾讯混元团队还制作了一个实际可用的腾讯混元翻译Demo版,并适配“后台取词模式”。用户在本地查看邮件、浏览网页时,都能随时调用混元翻译,且无需网络、订阅,翻译过程都在本地处理、不涉及个人信息的采集和上传,一次下载永久免费使用。该Demo暂时只支持安卓体验, 后续正式版会添加对IOS等平台的支持。

演示设备:高通骁龙7+gen2,16GB内存

Hy-MT1.5是腾讯混元团队打造的专业翻译大模型,原生支持33种语言、5种方言及1056个翻译方向,包含中英互译以及对法语、日语、阿拉伯语、俄语,甚至藏语、蒙古语等各种语言的翻译。

翻译模型演示,设备:高通骁龙865,8GB内存

腾讯混元的基准测试结果显示,Hy-MT1.5的翻译效果可比肩商业翻译API和235B级大模型的翻译效果,且翻译质量在基准测试中超过了谷歌翻译等主流系统。

原始1.8B模型在FP16精度下会占用3.3GB内存,为了不占用手机内存,研究人员进行了量化压缩。

其将模型里原本用16位数字(16-bit)表示的参数转用更低位数字储存。这就像把一幅高清照片压缩成缩略图,虽然文件小但还是能看清楚内容。

此外,针对不同的手机用户,腾讯还推出了2-bit与1.25-bit两种量化压缩方案。其实测显示,量化压缩后的两款模型表现效果远超同体积或更大体积大模型的翻译效果。

2-bit适用的中高端机型,模型体积压缩至574MB。

根据官方介绍,2-bit模型采用拉伸弹性量化(SEQ),将模型参数量化至{-1.5,-0.5,0.5,1.5},并结合量化感知蒸馏,在将模型体积压缩至574MB的同时,实现了几乎无损翻译质量,效果超越上百GB的大模型。在支持Arm SME2技术的移动设备上,2-bit模型能够实现更快速、更高效的推理。

1.25-bit模型适用全系机型,模型体积为440MB。

这一模型基于Sherry(稀疏高效三值量化)技术,其核心逻辑在于“细粒度稀疏”策略:每4个模型参数,3个最重要的用1-bit储存,1个用0储存,平均每个参数仅需1.25-bit。

此外,其还搭载了腾讯为手机CPU设计的STQ内核,适配SIMD指令集。这使得该模型能长时间在后台停留。Sherry技术方案已经被NLP顶级学术会议ACL 2026录用。

结语:腾讯混元拉低离线翻译普及门槛AI翻译已成为手机、输入法、浏览器、会议、客服工具等各种工具的标配功能,但大多工具仍是联网调用云端API,离线能力弱、体验差、隐私风险高。

腾讯混元此次开源轻量化翻译模型,用几百MB级的体积实现了媲美云端大模型的翻译质量,或直接把高端离线翻译从云端特权拉到手机可普及的门槛。

[物价飞涨的时候 这样省钱购物很爽]

| 分享: |

| 注: |

| 延伸阅读 | 更多... |

推荐: