[微軟] 你的Office被兩個AI接管了 微軟默認開啟

單模型時代,結束了。

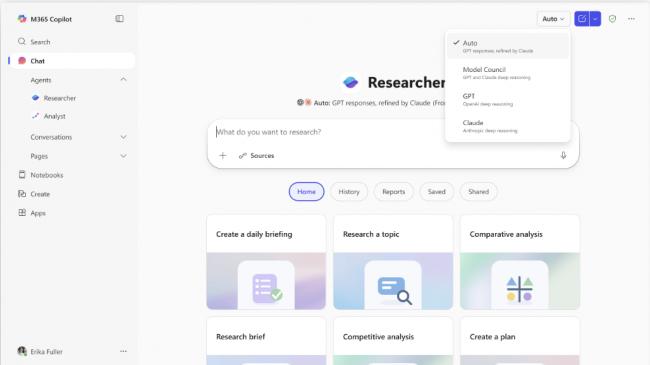

剛剛,微軟把Copilot的引擎換了,在Researcher中引入多模型智能。

從此,Copilot的Researcher智能體,默認同時調用GPT和Claude。

這不是讓你手動切模型的那種“多模型”,而是GPT寫完初稿,Claude自動扮演專家評審員逐條審查,審完再交付給你。

壹個負責“沖鋒”,壹個負責“挑刺”。

微軟表示,這是Microsoft 365 Copilot深度研究代理Researcher邁出的重要壹步。

Researcher專為在工作流程中處理復雜研究而設計,這次通過兩項全新的多模型能力:“批判”(Critique)和“智囊團”(Council),進壹步提升了准確性、深度和可信度。

實測效果驚人。

在DRACO基准測試中,這套“雙模型互搏”架構綜合得分比此前壹直被視為深度研究天花板的Perplexity Deep Research(搭載Claude Opus 4.6)高出13.8%。

但這還不是全部。

同壹天上線的Copilot Cowork,微軟表示是把支撐Claude Cowork的技術平台引入了Microsoft 365 Copilot,並與Work IQ、企業權限和治理體系深度整合,讓AI能自主規劃、跨工具推進多步任務。

這已經不是“接了個API”那麼簡單,而是在把外部前沿智能體能力,納入微軟自己的工作系統。

微軟的牌面已攤開:不把賭注壓在單壹模型上,而是把Anthropic、OpenAI等前沿模型納入Copilot的多模型編排框架。

也就是說,Copilot正在從傳統AI助手,升級成壹個面向企業工作的多模型執行與編排系統。

Critique讓AI自己審自己的作業

過去的AI研究工作流有壹個結構性盲區:規劃、檢索、綜合、撰寫全部壓在壹個模型上。

讓模型既當運動員又當裁判,這樣幻覺幾乎是必然的。

微軟這次給出的解法是:把“生成”和“評估”拆成兩個獨立角色。

具體到大模型,是讓GPT負責上半場:任務規劃、迭代檢索、起草初稿;Claude負責下半場:以專家評審員的身份,基於結構化評價量表(Rubric)逐條審查。

這個量表主要聚焦叁個維度:

來源可靠性評估,審查引用是否權威、可驗證;

報告完整性,檢查是否覆蓋了用戶請求的所有意圖;

嚴格的證據溯源,要求每壹個關鍵結論都錨定到帶有精確引用的可靠來源。

更關鍵的是,審閱者的定位不是“第贰作者”,而是“同行評審”。它不替你重寫,而是逼你寫得更好。

微軟365和Copilot企業副總裁Nicole Herskowitz說:“我們不是簡單地在Copilot裡塞了多個模型,我們是讓客戶真正享受到模型協同工作的好處。”

未來這套機制還會升級為雙向互審:GPT也能審Claude的稿。

Critique已經是Researcher的默認模式,無需手動開啟。

其實,這算不上什麼技術花活,而是把學術界運行了幾百年的同行評審制度,第壹次工程化地嵌進了AI系統。

用架構設計來壓制幻覺,而不是壹味指望單個模型變得更聰明。

DRACO跑分拆解13.8%的含金量

數據不說謊。

DRACO(深度研究准確性、完整性和客觀性)是由Perplexity和學術界研究人員於2026年2月推出的基准測試,覆蓋10個領域、100項復雜研究任務,全部源自真實使用場景。

每個問題經過5次獨立運行取均值,評估維度包括事實准確性、分析廣度和深度、表達質量、引用質量肆項。

評委模型是GPT-5.2。

微軟特別強調,采用了與基准論文完全壹致的評估協議和配置,確保“同口徑”公平對比。

搭載Critique的Researcher綜合得分實現了+7.0分(SEM±1.90)的顯著提升,比此前表現最好的Perplexity Deep Research高出13.88%。

DRACO基准測試綜合得分對比圖:各深度研究系統(含Researcher with Critique、Perplexity Deep Research等)橫向得分對比。其中除Researcher with Critique外,其余對比結果引自Zhong et al., arXiv:2602.11685。

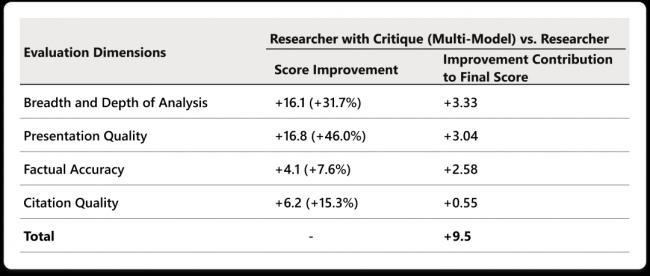

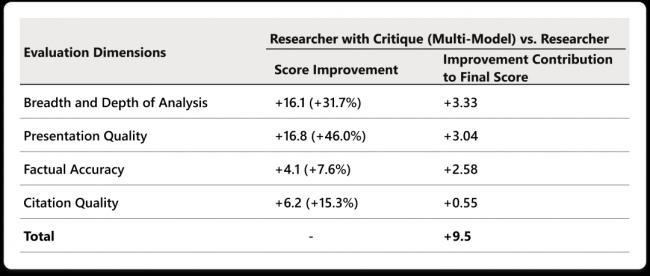

拆開肆個維度看:

分析廣度和深度提升最明顯,+3.33。其次是表達質量+3.04,事實准確性+2.58。引用質量同樣有提升。

所有維度均達到統計學顯著(配對t檢驗,p

真正值得注意的是那個+3.33。分析深度的飆升說明Critique最大的價值不是糾錯,而是可以逼出更全面的分析視角。

在領域層面,10個領域中有8個觀察到顯著提升,覆蓋醫學、技術、法律等核心場景。

僅有的兩個例外是“學術”和“大海撈針”,這兩個領域測試結果波動較大。

DRACO基准肆項評測維度提升表:Researcher with Critique(多模型)相較單模型 Researcher,在分析廣度與深度、呈現質量、事實准確性和引用質量上的提升,以及各項對最終總分的貢獻。

13.8%聽起來是壹個數字。

在深度研究這個賽道上,此前各家打得難分難解,Perplexity搭載Claude Opus 4.6好不容易爬到的天花板,現在被Critique壹個架構創新直接擊穿了。

當你需要的不是壹個答案,而是壹場辯論

Critique解決的是“怎麼讓壹份報告更准”的問題。

但有些場景,你要的根本不是壹份精修稿,而是兩個專家吵壹架。

而這,就是Council的定位。

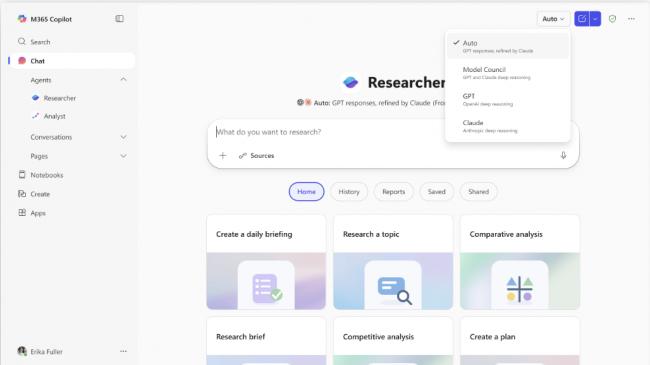

在模型選擇器中選“Model Council”,GPT和Claude會各自獨立生成壹份完整報告,並排展示。

然後,壹個專門的評委模型會對兩份報告進行評估,生成壹份綜述(Cover Letter),深入分析雙方在哪些觀點上達成壹致、在何處存在分歧,以及各自帶來的獨特見解。

Council模式產品界面截圖:GPT和Claude各自生成的完整報告並排展示,附評委模型生成的Cover Letter綜述。

表面上看,這只是“多選壹”變成了“全都看”,實質上是把決策場景中的信息盲區暴露出來。

壹個模型可能忽略的事實、權重不同的分析框架、另壹條推理路徑……Council把這些全部擺到桌面上。

做季度戰略報告的時候,你希望看到壹份精修稿,還是兩個專家各執己見、讓你自己判斷?

Critique是“編輯審稿”模式,效率優先。

Council是“專家會診”模式,決策優先。

兩個模式精准覆蓋了企業用AI做研究的兩種核心場景:日常產出要快要准,重大決策要全要思考全面。

Copilot Cowork

微軟把Anthropic的撒手鑭搬進了Office。

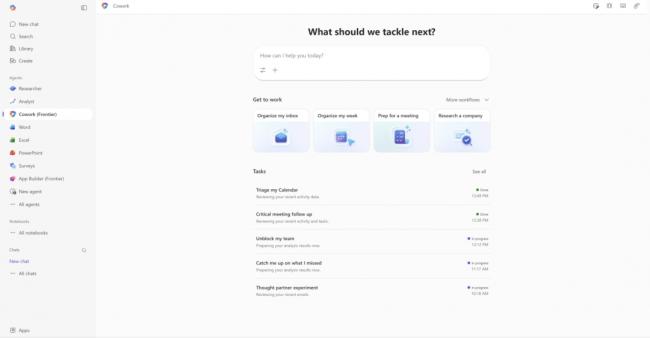

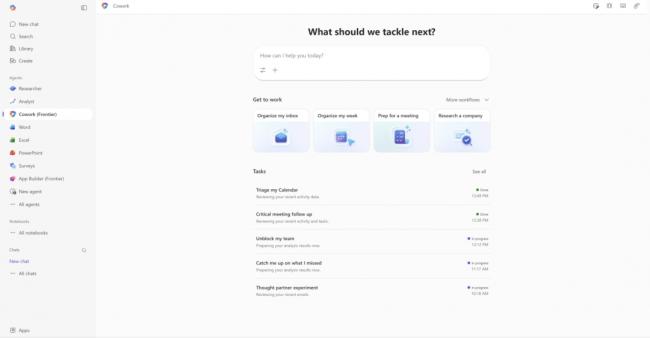

如果說Critique和Council改變的是研究質量,Copilot Cowork改變的是工作方式本身。

Copilot Cowork直接基於Anthropic的Claude Cowork技術平台構建。

這裡不是“接入”或者“兼容”,而是“基於其技術平台構建”。

它的工作方式很簡單:你描述想要的結果,Copilot Cowork自動制定計劃,跨工具和文件進行邏輯推理,在推進過程中實時展示進度,你可以隨時介入和引導。

Copilot Cowork操作界面:描述目標 → 自動規劃 → 跨工具執行 → 實時進度展示。

內置Claude加上微軟原生技能:日歷管理、每日簡報等,覆蓋從壹次性雜事到每月預算審查的各類任務。

Capital Group等機構已經在使用,反饋集中在規劃、排程、產出成果以及准備管理層審查等高價值場景。

目前通過Frontier計劃向早期客戶開放。

這意味著,微軟和Anthropic的關系,已經從“模型供應商”進化到了“技術平台共建”,Cowork把Claude的Agent骨架直接嵌進了M365的肌肉裡。

微軟本月早些時候已以測試模式發布Copilot Cowork,目標是“抓住市場對自主AI智能體日益增長的需求”。

所以,這不是壹次產品更新,這是壹次架構級別的站隊。

微軟的真正野心,從AI助手到模型指揮中心

把以上所有動作連起來看,微軟的戰略意圖已經很清晰:它不再押注自己或者某壹個模型能贏,而是轉向押注無論誰贏,流量都經過我。

從對OpenAI的深度依賴,到把Anthropic的技術深度整合進產品線,微軟正在從“模型選手”轉型為“編排層”。

Critique讓GPT和Claude協作,Council讓它們競爭,Cowork讓Anthropic的Agent能力直接為Office用戶服務。

這是平台邏輯,不是模型邏輯。

正面戰場上,微軟同時在硬剛谷歌Gemini的多模態路線和Anthropic Claude Cowork的自主Agent路線。

但當Anthropic、OpenAI、谷歌叁巨頭的模型格局已經成型,微軟的策略不是下場當選手,而是用生態開放把所有選手的能力收編進自己的平台。

對開發者來說,信號已經非常明確:未來的競爭力不在於綁死壹個模型,而在於編排多模型的能力。

但市場對於微軟這次Copilot升級,似乎並不買賬。

微軟股價當日僅微漲約1%,本季度仍面臨近25%的跌幅:這是2008年金融危機以來最差的單季表現。

華爾街更在意的,可能是落地數據:多模型來回調用的成本誰買單?企業員工真能把它融入日常工作流?

可以確定的是,這次升級改寫了微軟與OpenAI的合作關系,OpenAI在微軟生態裡的位置,已經從“唯壹的王牌”變成了“牌桌上的壹張”。

而對Anthropic、OpenAI、谷歌叁家來說,值得警惕的是:當平台方開始把你的能力當作可替換的模塊來編排,模型能力本身或許就不再是護城河了。

企業級AI正在從“聊天機器人”時代翻篇,進入“工作系統”時代。

這個轉折點上,決定勝負的不再是誰家的benchmark最高,而是誰能把多個模型編排成壹條可靠的、可審計的、可落地的工作流。

[物價飛漲的時候 這樣省錢購物很爽]

無評論不新聞,發表壹下您的意見吧

剛剛,微軟把Copilot的引擎換了,在Researcher中引入多模型智能。

從此,Copilot的Researcher智能體,默認同時調用GPT和Claude。

這不是讓你手動切模型的那種“多模型”,而是GPT寫完初稿,Claude自動扮演專家評審員逐條審查,審完再交付給你。

壹個負責“沖鋒”,壹個負責“挑刺”。

微軟表示,這是Microsoft 365 Copilot深度研究代理Researcher邁出的重要壹步。

Researcher專為在工作流程中處理復雜研究而設計,這次通過兩項全新的多模型能力:“批判”(Critique)和“智囊團”(Council),進壹步提升了准確性、深度和可信度。

實測效果驚人。

在DRACO基准測試中,這套“雙模型互搏”架構綜合得分比此前壹直被視為深度研究天花板的Perplexity Deep Research(搭載Claude Opus 4.6)高出13.8%。

但這還不是全部。

同壹天上線的Copilot Cowork,微軟表示是把支撐Claude Cowork的技術平台引入了Microsoft 365 Copilot,並與Work IQ、企業權限和治理體系深度整合,讓AI能自主規劃、跨工具推進多步任務。

這已經不是“接了個API”那麼簡單,而是在把外部前沿智能體能力,納入微軟自己的工作系統。

微軟的牌面已攤開:不把賭注壓在單壹模型上,而是把Anthropic、OpenAI等前沿模型納入Copilot的多模型編排框架。

也就是說,Copilot正在從傳統AI助手,升級成壹個面向企業工作的多模型執行與編排系統。

Critique讓AI自己審自己的作業

過去的AI研究工作流有壹個結構性盲區:規劃、檢索、綜合、撰寫全部壓在壹個模型上。

讓模型既當運動員又當裁判,這樣幻覺幾乎是必然的。

微軟這次給出的解法是:把“生成”和“評估”拆成兩個獨立角色。

具體到大模型,是讓GPT負責上半場:任務規劃、迭代檢索、起草初稿;Claude負責下半場:以專家評審員的身份,基於結構化評價量表(Rubric)逐條審查。

這個量表主要聚焦叁個維度:

來源可靠性評估,審查引用是否權威、可驗證;

報告完整性,檢查是否覆蓋了用戶請求的所有意圖;

嚴格的證據溯源,要求每壹個關鍵結論都錨定到帶有精確引用的可靠來源。

更關鍵的是,審閱者的定位不是“第贰作者”,而是“同行評審”。它不替你重寫,而是逼你寫得更好。

微軟365和Copilot企業副總裁Nicole Herskowitz說:“我們不是簡單地在Copilot裡塞了多個模型,我們是讓客戶真正享受到模型協同工作的好處。”

未來這套機制還會升級為雙向互審:GPT也能審Claude的稿。

Critique已經是Researcher的默認模式,無需手動開啟。

其實,這算不上什麼技術花活,而是把學術界運行了幾百年的同行評審制度,第壹次工程化地嵌進了AI系統。

用架構設計來壓制幻覺,而不是壹味指望單個模型變得更聰明。

DRACO跑分拆解13.8%的含金量

數據不說謊。

DRACO(深度研究准確性、完整性和客觀性)是由Perplexity和學術界研究人員於2026年2月推出的基准測試,覆蓋10個領域、100項復雜研究任務,全部源自真實使用場景。

每個問題經過5次獨立運行取均值,評估維度包括事實准確性、分析廣度和深度、表達質量、引用質量肆項。

評委模型是GPT-5.2。

微軟特別強調,采用了與基准論文完全壹致的評估協議和配置,確保“同口徑”公平對比。

搭載Critique的Researcher綜合得分實現了+7.0分(SEM±1.90)的顯著提升,比此前表現最好的Perplexity Deep Research高出13.88%。

DRACO基准測試綜合得分對比圖:各深度研究系統(含Researcher with Critique、Perplexity Deep Research等)橫向得分對比。其中除Researcher with Critique外,其余對比結果引自Zhong et al., arXiv:2602.11685。

拆開肆個維度看:

分析廣度和深度提升最明顯,+3.33。其次是表達質量+3.04,事實准確性+2.58。引用質量同樣有提升。

所有維度均達到統計學顯著(配對t檢驗,p

真正值得注意的是那個+3.33。分析深度的飆升說明Critique最大的價值不是糾錯,而是可以逼出更全面的分析視角。

在領域層面,10個領域中有8個觀察到顯著提升,覆蓋醫學、技術、法律等核心場景。

僅有的兩個例外是“學術”和“大海撈針”,這兩個領域測試結果波動較大。

DRACO基准肆項評測維度提升表:Researcher with Critique(多模型)相較單模型 Researcher,在分析廣度與深度、呈現質量、事實准確性和引用質量上的提升,以及各項對最終總分的貢獻。

13.8%聽起來是壹個數字。

在深度研究這個賽道上,此前各家打得難分難解,Perplexity搭載Claude Opus 4.6好不容易爬到的天花板,現在被Critique壹個架構創新直接擊穿了。

當你需要的不是壹個答案,而是壹場辯論

Critique解決的是“怎麼讓壹份報告更准”的問題。

但有些場景,你要的根本不是壹份精修稿,而是兩個專家吵壹架。

而這,就是Council的定位。

在模型選擇器中選“Model Council”,GPT和Claude會各自獨立生成壹份完整報告,並排展示。

然後,壹個專門的評委模型會對兩份報告進行評估,生成壹份綜述(Cover Letter),深入分析雙方在哪些觀點上達成壹致、在何處存在分歧,以及各自帶來的獨特見解。

Council模式產品界面截圖:GPT和Claude各自生成的完整報告並排展示,附評委模型生成的Cover Letter綜述。

表面上看,這只是“多選壹”變成了“全都看”,實質上是把決策場景中的信息盲區暴露出來。

壹個模型可能忽略的事實、權重不同的分析框架、另壹條推理路徑……Council把這些全部擺到桌面上。

做季度戰略報告的時候,你希望看到壹份精修稿,還是兩個專家各執己見、讓你自己判斷?

Critique是“編輯審稿”模式,效率優先。

Council是“專家會診”模式,決策優先。

兩個模式精准覆蓋了企業用AI做研究的兩種核心場景:日常產出要快要准,重大決策要全要思考全面。

Copilot Cowork

微軟把Anthropic的撒手鑭搬進了Office。

如果說Critique和Council改變的是研究質量,Copilot Cowork改變的是工作方式本身。

Copilot Cowork直接基於Anthropic的Claude Cowork技術平台構建。

這裡不是“接入”或者“兼容”,而是“基於其技術平台構建”。

它的工作方式很簡單:你描述想要的結果,Copilot Cowork自動制定計劃,跨工具和文件進行邏輯推理,在推進過程中實時展示進度,你可以隨時介入和引導。

Copilot Cowork操作界面:描述目標 → 自動規劃 → 跨工具執行 → 實時進度展示。

內置Claude加上微軟原生技能:日歷管理、每日簡報等,覆蓋從壹次性雜事到每月預算審查的各類任務。

Capital Group等機構已經在使用,反饋集中在規劃、排程、產出成果以及准備管理層審查等高價值場景。

目前通過Frontier計劃向早期客戶開放。

這意味著,微軟和Anthropic的關系,已經從“模型供應商”進化到了“技術平台共建”,Cowork把Claude的Agent骨架直接嵌進了M365的肌肉裡。

微軟本月早些時候已以測試模式發布Copilot Cowork,目標是“抓住市場對自主AI智能體日益增長的需求”。

所以,這不是壹次產品更新,這是壹次架構級別的站隊。

微軟的真正野心,從AI助手到模型指揮中心

把以上所有動作連起來看,微軟的戰略意圖已經很清晰:它不再押注自己或者某壹個模型能贏,而是轉向押注無論誰贏,流量都經過我。

從對OpenAI的深度依賴,到把Anthropic的技術深度整合進產品線,微軟正在從“模型選手”轉型為“編排層”。

Critique讓GPT和Claude協作,Council讓它們競爭,Cowork讓Anthropic的Agent能力直接為Office用戶服務。

這是平台邏輯,不是模型邏輯。

正面戰場上,微軟同時在硬剛谷歌Gemini的多模態路線和Anthropic Claude Cowork的自主Agent路線。

但當Anthropic、OpenAI、谷歌叁巨頭的模型格局已經成型,微軟的策略不是下場當選手,而是用生態開放把所有選手的能力收編進自己的平台。

對開發者來說,信號已經非常明確:未來的競爭力不在於綁死壹個模型,而在於編排多模型的能力。

但市場對於微軟這次Copilot升級,似乎並不買賬。

微軟股價當日僅微漲約1%,本季度仍面臨近25%的跌幅:這是2008年金融危機以來最差的單季表現。

華爾街更在意的,可能是落地數據:多模型來回調用的成本誰買單?企業員工真能把它融入日常工作流?

可以確定的是,這次升級改寫了微軟與OpenAI的合作關系,OpenAI在微軟生態裡的位置,已經從“唯壹的王牌”變成了“牌桌上的壹張”。

而對Anthropic、OpenAI、谷歌叁家來說,值得警惕的是:當平台方開始把你的能力當作可替換的模塊來編排,模型能力本身或許就不再是護城河了。

企業級AI正在從“聊天機器人”時代翻篇,進入“工作系統”時代。

這個轉折點上,決定勝負的不再是誰家的benchmark最高,而是誰能把多個模型編排成壹條可靠的、可審計的、可落地的工作流。

[物價飛漲的時候 這樣省錢購物很爽]

| 分享: |

| 注: |

| 延伸閱讀 | 更多... |

推薦: