过了年发现 MIT教授的最新警告成真了

康奈尔大学信息科学教授阿迪亚・瓦希斯塔,对于AI导致的同质化打了一个比方:

「AI就像一个老师,每次我写作时都坐在我身后说,‘这是更好的版本’。通过这种日复一日的接触,你失去了你的身份,失去了真实性,也失去了对写作的信心,变成了和AI一模一样的人」。

上文提到的MIT的SAT写作实验也发现了同样的趋势。

当被问及「我们的成就必须有益于他人才能让我们真正快乐吗?」时,使用AI的参与者答案高度趋同,都集中在「职业和个人成功」上。

而面对关于慈善的提问,AI组的观点惊人地一致,全部支持,而其他组则出现了对慈善的批判性思考。

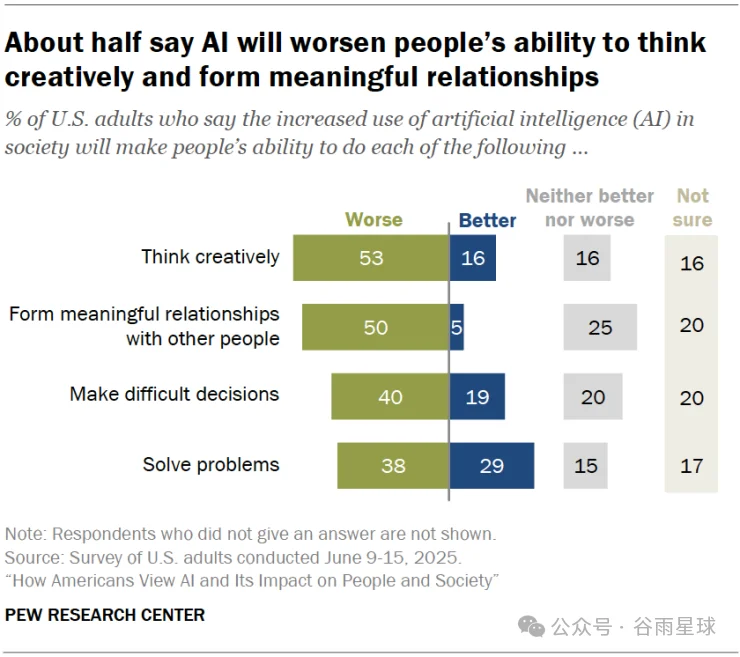

就像有人很早就预测过的,AI正在将我们拉向「思想的平均值」,它磨平了棱角,也抹去了个性。

更深层的风险在于,AI给的这些迅速的、全面的,甚至令人的答案,会让我们对此上瘾。

OpenAI与MIT媒体实验室的研究发现,ChatGPT的重度用户表现出明显的过度依赖症状,包括精神专注、戒断反应、失控和情绪波动。

这些重度用户往往更孤独,也更容易在情感上依赖AI。

■越来越多孩子把AI当做亲密的聊天伙伴,今年9月,美国联邦贸易委员会要求包括OpenAI、Alphabet和Meta在内的七家公司解释他们的人工智能聊天机器人可能如何影响儿童和青少年,监管可能很快会跟上

把主动权抢回来

那么,我们该如何避免被AI「吃掉」大脑?

答案或许很简单:永远不要在思考的起点就求助于AI。

无论是写一封邮件、构思一个方案,还是解决一个问题,先把你的第一版想法写下来,哪怕只是一个很粗糙的初步构想。、

完成这个「从0到1」的「富有成效的奋斗」之后,再把AI请进来。

在之后的合作中,把它当作一个不知疲倦的「陪练」或「审稿人」,不停问它:「我的逻辑链条有漏洞吗?」「还有哪些我没想到的角度?」「你能用更简洁的语言表达我的第三段吗?」

这样,你既完成了对大脑的锻炼,又利用了AI的效率。你依然是思考的主人,AI只是你手中的利器,你的大脑依然安全。

[物价飞涨的时候 这样省钱购物很爽]

| 分享: |

| 注: | 在此页阅读全文 |

推荐:

过了年发现 MIT教授的最新警告成真了

过了年发现 MIT教授的最新警告成真了