DeepSeek之后,又一中国大模型登Nature

Emu3与其他视频扩散模型对比情况

Emu3可以通过预测未来帧来扩展视频。以视频扩展的定性为例,将2秒、24帧/秒的视频token化为离散视觉token作为上下文。Emu3以同样的离散视觉token形式预测后续2秒的内容,这些token可以被解token化以生成预测的未来视频。

不同于Sora等模型的以噪声为起点的扩散式视频生成模型,Emu3通过自回归方式逐token预测视频序列,实现基于因果的视频生成与延展,展现出对物理世界中环境、人类与动物行为的初步模拟能力。

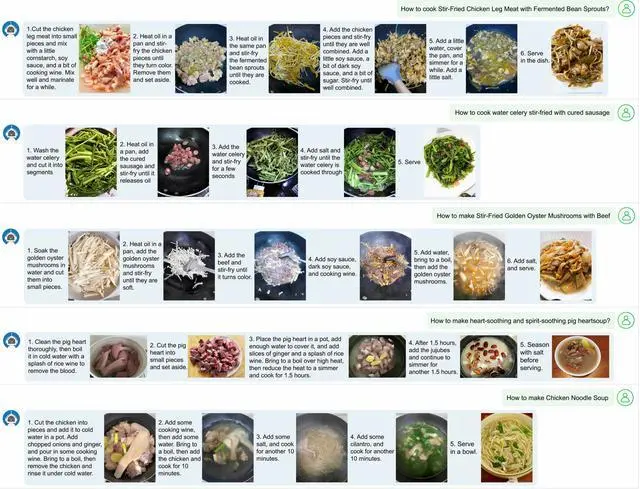

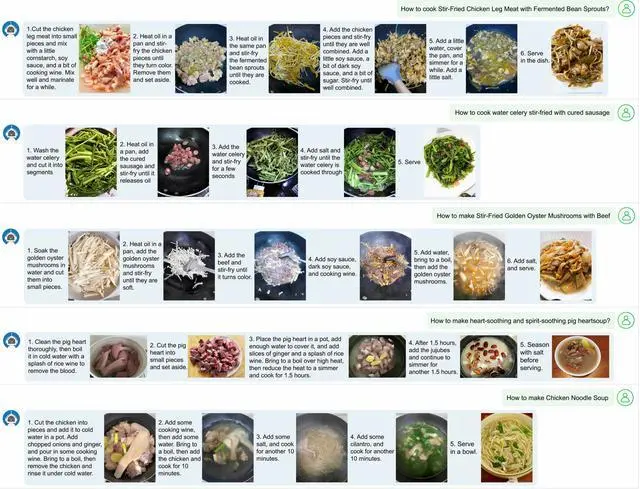

Emu3还可拓展至视觉语言交错生成,例如图文并茂的菜谱生成。

交错图文生成结果的可视化

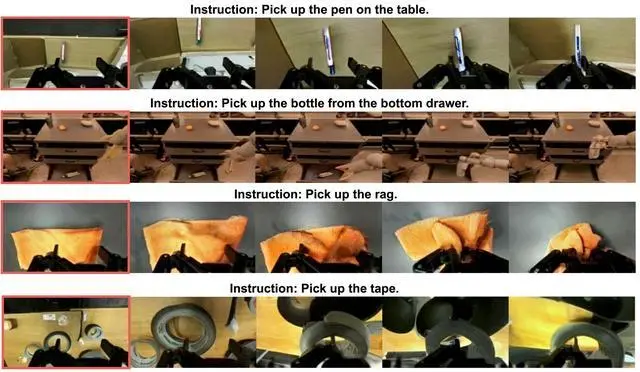

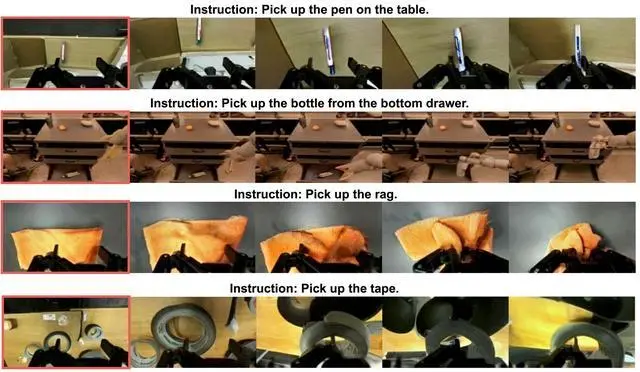

其也可拓展至视觉语言动作建模,如机器人操作VLA等,进一步体现了“预测下一个token”的通用性。

Droid数据集上视觉预测的可视化

事实上,在Nature论文之外,智源研究院于2025年10月30日发布了Emu3的后续版本Emu3.5,其在多种多模态任务上继续展现出令人惊艳的效果以及SOTA的结果,对比Emu3有了全方位、大幅度的性能提升,开启多模态世界大模型新纪元。

“悟界・Emu”系列在架构理念和实际效果上都达到了产品级,这才使它不仅在学术界获得了《自然》期刊的高度认可,而且在业界引起了广泛关注。Emu3及后续版本的成果具有重大产业应用前景,可能改写整个多模态大模型格局,为中国在下一代大模型下的原创科研成果树立了典范。

三、扩散模型已死?技术角度揭秘Emu3框架

Emu3及后续版本的发布,一度在开发者社区引起讨论和关注,甚至产生了“扩散模型已死”的说法。

对此,王仲远坦言,目前对于扩散模型的研究趋势尚不能定论。虽然有一些成果如Emu3.5提供了世界模型的可行路径,但并非唯一路径。未来可能会有更多技术路径实现“预测下一个状态”,且扩散模型也在与其他技术结合改进。因此,不能断言扩散模型会消失,而是需要持续观察和学习交流。

尽管不能断言自回归路线已经一统天下,但Emu3已经为产业提供了一条新的康庄大道。

回到Emu3模型架构来看,其保留了Llama-2等成熟大语言模型的架构框架,主要修改在于扩展了嵌入层以容纳离散的视觉标记。这是一个统一的、仅含解码器的框架,该框架将语言、图像和视频建模为单一的离散标记序列,并通过下一个标记预测目标进行端到端训练。

下图展示了该框架,其方法包含五个紧密集成的组件:

[物价飞涨的时候 这样省钱购物很爽]

这条新闻还没有人评论喔,等着您的高见呢

Emu3可以通过预测未来帧来扩展视频。以视频扩展的定性为例,将2秒、24帧/秒的视频token化为离散视觉token作为上下文。Emu3以同样的离散视觉token形式预测后续2秒的内容,这些token可以被解token化以生成预测的未来视频。

不同于Sora等模型的以噪声为起点的扩散式视频生成模型,Emu3通过自回归方式逐token预测视频序列,实现基于因果的视频生成与延展,展现出对物理世界中环境、人类与动物行为的初步模拟能力。

Emu3还可拓展至视觉语言交错生成,例如图文并茂的菜谱生成。

交错图文生成结果的可视化

其也可拓展至视觉语言动作建模,如机器人操作VLA等,进一步体现了“预测下一个token”的通用性。

Droid数据集上视觉预测的可视化

事实上,在Nature论文之外,智源研究院于2025年10月30日发布了Emu3的后续版本Emu3.5,其在多种多模态任务上继续展现出令人惊艳的效果以及SOTA的结果,对比Emu3有了全方位、大幅度的性能提升,开启多模态世界大模型新纪元。

“悟界・Emu”系列在架构理念和实际效果上都达到了产品级,这才使它不仅在学术界获得了《自然》期刊的高度认可,而且在业界引起了广泛关注。Emu3及后续版本的成果具有重大产业应用前景,可能改写整个多模态大模型格局,为中国在下一代大模型下的原创科研成果树立了典范。

三、扩散模型已死?技术角度揭秘Emu3框架

Emu3及后续版本的发布,一度在开发者社区引起讨论和关注,甚至产生了“扩散模型已死”的说法。

对此,王仲远坦言,目前对于扩散模型的研究趋势尚不能定论。虽然有一些成果如Emu3.5提供了世界模型的可行路径,但并非唯一路径。未来可能会有更多技术路径实现“预测下一个状态”,且扩散模型也在与其他技术结合改进。因此,不能断言扩散模型会消失,而是需要持续观察和学习交流。

尽管不能断言自回归路线已经一统天下,但Emu3已经为产业提供了一条新的康庄大道。

回到Emu3模型架构来看,其保留了Llama-2等成熟大语言模型的架构框架,主要修改在于扩展了嵌入层以容纳离散的视觉标记。这是一个统一的、仅含解码器的框架,该框架将语言、图像和视频建模为单一的离散标记序列,并通过下一个标记预测目标进行端到端训练。

下图展示了该框架,其方法包含五个紧密集成的组件:

[物价飞涨的时候 这样省钱购物很爽]

| 分享: |

| 注: | 在此页阅读全文 |

| 延伸阅读 |

推荐:

DeepSeek之后,又一中国大模型登Nature

DeepSeek之后,又一中国大模型登Nature